隨著大語言模型(LLM)的普及,許多開發團隊紛紛將日常任務交由 AI 處理。然而,我們常會發現:與 AI 的協作往往缺乏穩定性,產出品質時好時壞,過程難以追蹤,導致作業過程宛如一個難以解析的「黑盒子」。

為了解決這類對話紀錄碎片化與缺乏管理的痛點,我們提出了AI 原生任務治理模型 (AI Native Task Governance Model) 的概念。

這篇文章將探討這個模型的核心機制,以及它如何重塑未來的軟體工程協作模式。

傳統的專案管理工具(如 Jira、Trello 等),其設計初衷是為人類讀者服務的。

一張任務卡片上可能僅有簡短的描述,例如:「實作忘記密碼功能」。人類工程師具備領域知識與上下文脈絡,只需簡短提示便能自行理解、查閱資料並進行開發。

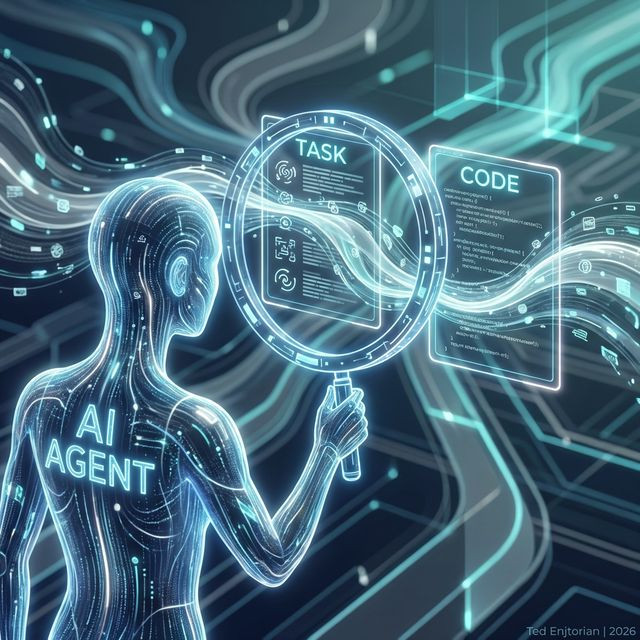

然而,當我們試圖將 AI Agent 視為開發流程中的「一等公民」時,舊有系統的缺陷便顯露無遺。AI 缺乏人類的隱性知識與專案背景,無法快速且精準地解析充滿人類自然語言模糊性的任務看板。

為此,我們需要一套同時具備人機可讀性、且能使機器明確解讀的新型溝通框架。這正是「AI 原生任務治理模型」誕生的核心背景。

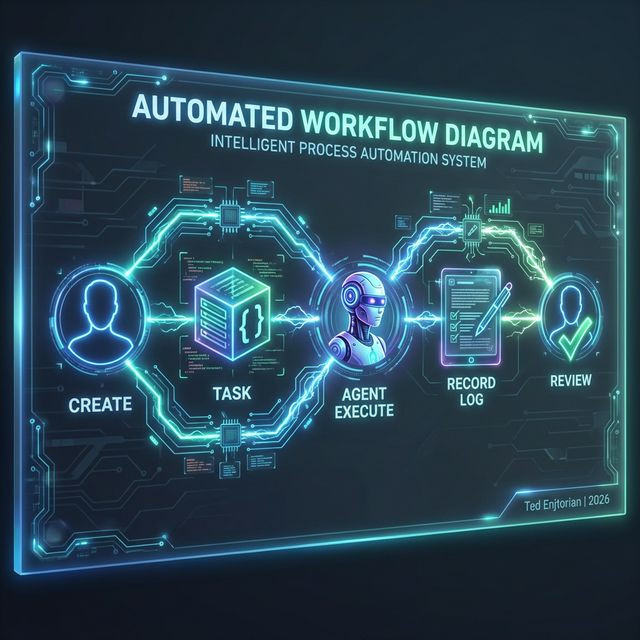

為了讓 AI 能穩定、可靠地參與專案開發,AI 原生任務治理模型屏棄了傳統鬆散的任務卡片,並將軟體工程中的嚴謹性引入 AI 協作中,建立起兩大支柱:

在這個治理框架下,任務不再是介面上的幾行自由格式文字,而是如同原始碼一樣被對待的實體檔案。

模型強調提示詞(Prompt)不應是分散在個人視窗裡的臨時對話,而應該是具備生命週期管理的軟體資產。

傳統的人機協作往往只關注 AI 的最終產出,卻忽略了其邏輯推演過程。AI 原生任務治理模型要求透過實體檔案(如 Record.md),將 AI 解決問題的思考邏輯、參考背景與決策依據,完整且系統性地記錄下來。

過去消失在臨時對話視窗中的脈絡,現在皆轉化為可透過系統偵測、隨時供團隊調閱與除錯的核心資產。

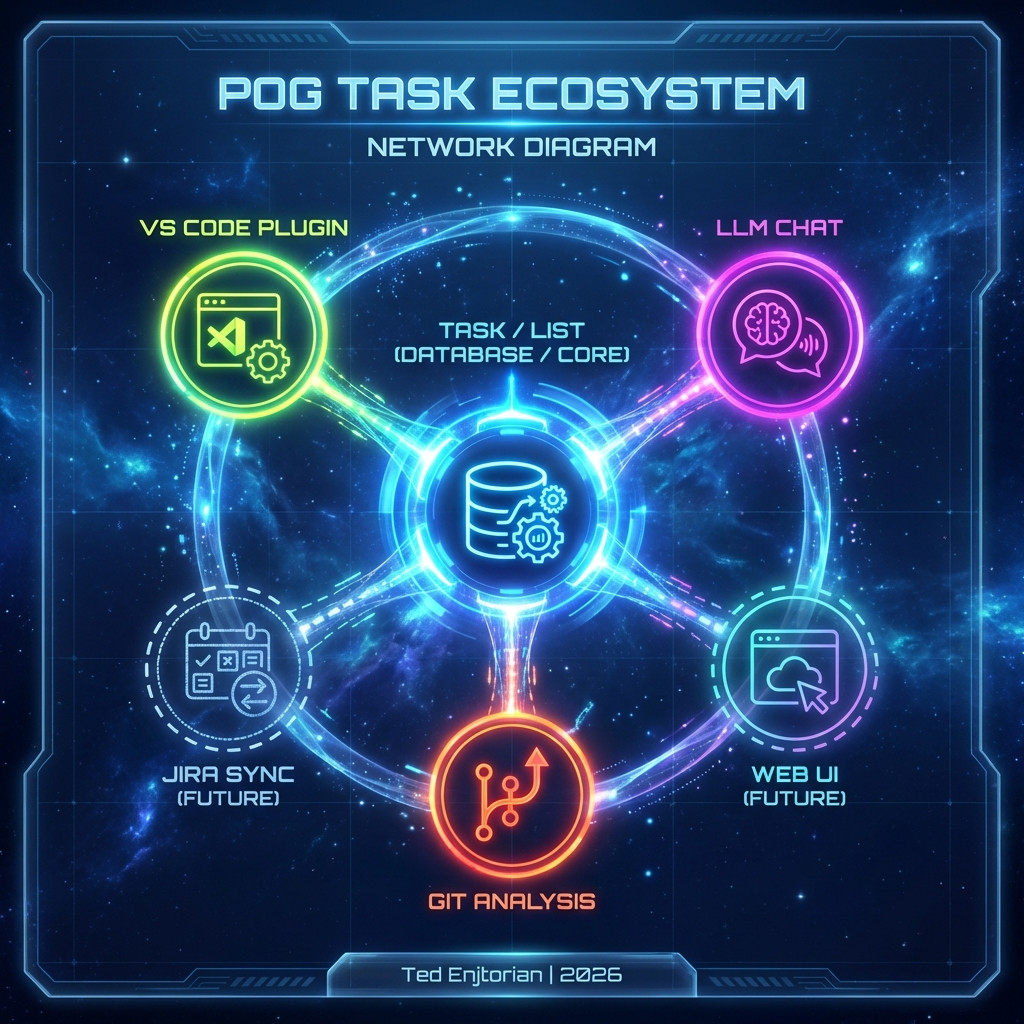

總結來說,AI 原生任務治理模型(例如 POG Task 框架)的核心使命,在於為導入 AI 的開發團隊建立一套具備紀律與標準的工作協議。

導入這套模型後,開發團隊不再是依賴反覆嘗試的 Prompt 去碰運氣,而是進行「結構化任務的發包作業」。這意味著從「對話式協作」走向「程式化任務治理」,將 AI Agent 從隨性的數位助理,升級為遵守標準作業程序(SOP)的專業開發協作者。

我們正歷經從「文件只為人類而寫」的舊時代,跨越至「人機共享標準任務協議」的新紀元。透過 Treat Task/Prompt as Code 的實踐,我們不僅能提升 AI 協作的精準性,更讓團隊的經驗得以透過實體化的「代碼」永續累積。

迎向 AI 原生的協作時代,建立制度化的任務治理框架,將是企業提升研發效能不可或缺的關鍵。

實現方式 : https://ithelp.ithome.com.tw/articles/10399704

完整文章 : https://enjtorian.github.io/pog-task/zh-tw/

整合工具 : https://marketplace.visualstudio.com/items?itemName=enjtorian.pog-task-manager