Logistic regression就跟其他的回歸分析一樣,都是預測的分析,不一樣的是他預測的結果會用二進位來顯示。

所用的Error Function是cross-entropy,大多用於二進位output或是一個/多個屬性的output。

注意:雖然它名字有 regression 但是它是屬於 classification 噢... :D

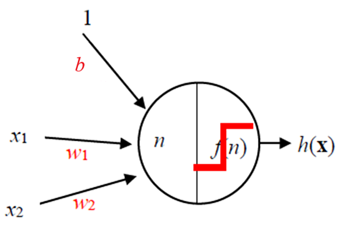

Binary Classification (sign function)

前面的PLA就是用來計算這個的演算法

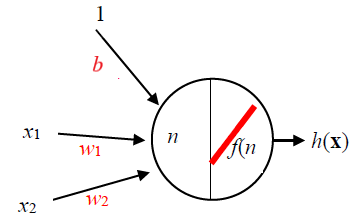

Linear Regression (linear function)

用gradient descent(梯度下降)計算

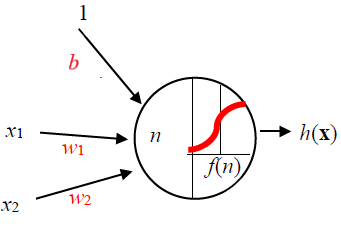

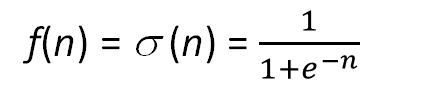

Logistic Regression (sigmoid function)

用gradient descent(梯度下降)計算

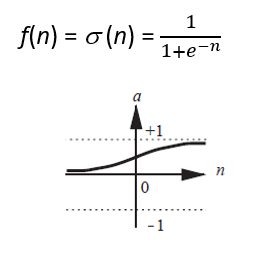

前面介紹線性函數的時候有提到過,這邊順便做簡單的數學推導:

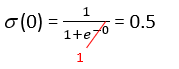

當n=0:

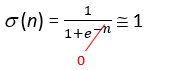

當n趨近於無限大:

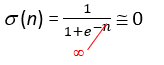

當n趨近於負無限大:

可以看到它是一個連續的函數在(0,1)之間,也可以被稱為機率值。

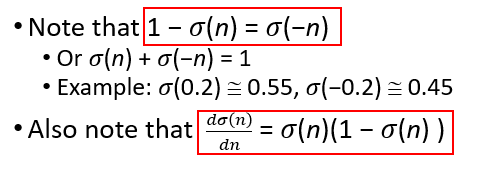

重點筆記

總之先記起來...