了解計算的公式後要來學習如何校正logistic regression:

首先複習一下前一篇的最後結論:y-hat = p(y=1|x) 在x中y=1發生的機率

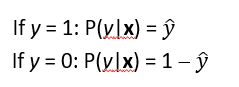

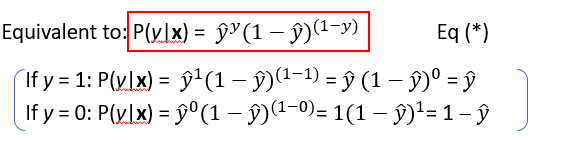

=> 當y=1 時 p(y|x) = y-hat ; 當y=0 時 p(y|x) = 1-(y-bar)

整理後可以得到:

不懂就...先記起來

總之我們想要盡量的逼近我們的目標,也就是求出Max(p(y|x)),

於是想要使用單調遞增的ln()函數去盡量逼近,得出Max(ln(p(y|x)))。就是高中學的natural log,ln(x)微分後會是1/x

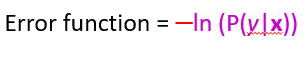

同時也想要盡量減少誤差,於是這邊使用的Error Function 一樣使用ln()去計算的話 => min(ln(p(y|x)))

由此可得

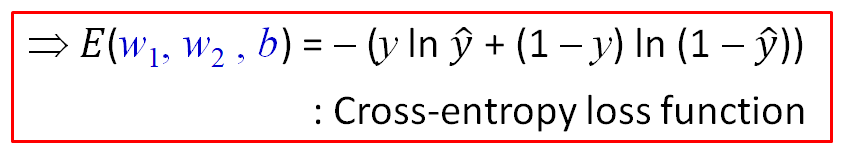

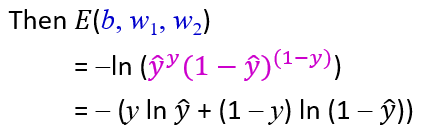

套用進一開始假設的E(w1,w2,b) = -ln(p(y|x)),

p(y|x)則用剛剛整理好的公式帶入 =>

就可以得到Logistic Regression的 Error Function,也就是Cross-entropy loss function