今天將繼續講解貝式推理中著名的演算法,馬可夫鏈與迴歸分析,讓我們繼續看下去~

馬可夫鏈(Markov Chains)指一個序列性的事件中,每一個事件的發生概率不是隨機獨立,而會與前面緊鄰的一個事件有關,但與其他更前面的事件並無關聯。馬可夫鏈假設「過去所有的序列訊息都被保存在這個最緊鄰的事件狀態下」。

首先,我們可以先了解何謂序列關係(Sequential Relationship),拿我們最常見的例子就是字與字之間的關係,

例如英文中,子音之後大部分為母音。這種字與字、句與句之間的關係,便經常使用序列關係來做為判定。

而馬可夫鏈能透過演算,計算出字與字之間關係的最大可能。例如:以「滑」字為例,「鼠」出現在「滑」之後的可能性就比其他(眼、狗、貓)大得多。而現在也有發展出一個字的出現與前面多個字的出現的公式集合,例如:「天、氣、很」三個字的出現會讓「好」與他們有關聯,這種在我們手機上常出現的選字功能,便是所謂的N-gram演算法。

隱藏馬可夫鏈(Hidden Markov Model,HMM)指透過一種可觀序列事件(Observed Event)的現象,去預測一個無法觀察到序列事件(Hidden Event)的一種統計預測模式。它包含了兩個事件的概率:一個序列為觀察的到的行為,另一個序列為觀察不到的,HMM指出隱藏序列內的事件決定於兩個事件,一是其之前的State1;另一個為觀察到的序列Observe。

拿語音助理來舉例,它經過數千萬次訓練後會出現三種的序列關係:

1.音節間序列的先後關係:當語音助理聽到「今」時,判斷後面音節很可能為「天」的聲音。

2.音節與文字的對應關係:再由音波去對應到文字,判斷很可能為「天」。

3.文字間先後的序列關係:「今」的文字相對應中,「天」的可能性更大。

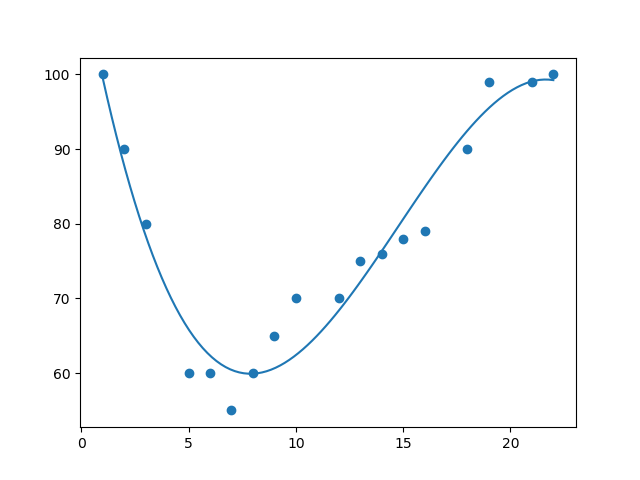

迴歸分析(Regression Analysis)指一種預測的建模技術,利用訓練樣本來分析自變數(Independent Variable)X與因變數(Dependent Variable)Y之間的關係「方向」與「強度」,其方法是透過最小化誤差的平方來找出一條最能代表所有觀測值X的函數,並用此函數來代表X與Y之間的關係,如果其之間的關係是線性的,則稱為線性迴歸分析(Linear Regression)

當X的冪大於1,不是一次方線性函數時,就需使用多項式迴歸來表示X與Y的關係。

邏輯迴歸(Logistic Regression)指將事情發生的概率透過對數函數(Logarithmic Function)的轉換產生一個介於0~1的值,並進行二次分類的一種迴歸分類模型,邏輯迴歸主要用於對或錯、是或否等,二分類模型。他對於輸出的結果大多會設一個閥值來對物件做分類。

參考資料

人工智慧-概念應用與管理 林東清著

https://baike.baidu.hk/item/%E5%B0%8D%E6%95%B8%E5%87%BD%E6%95%B8/6013318