上圖是2023, ChatGPT火紅以來, 最大的資安問題, 也因為爆出這個資料隱私議題, 引起大眾對於使用LLM的疑慮, 所以這一篇就來看一下微軟如何處理資料隱私的部分? 主要可以分成三個使用情境如下:

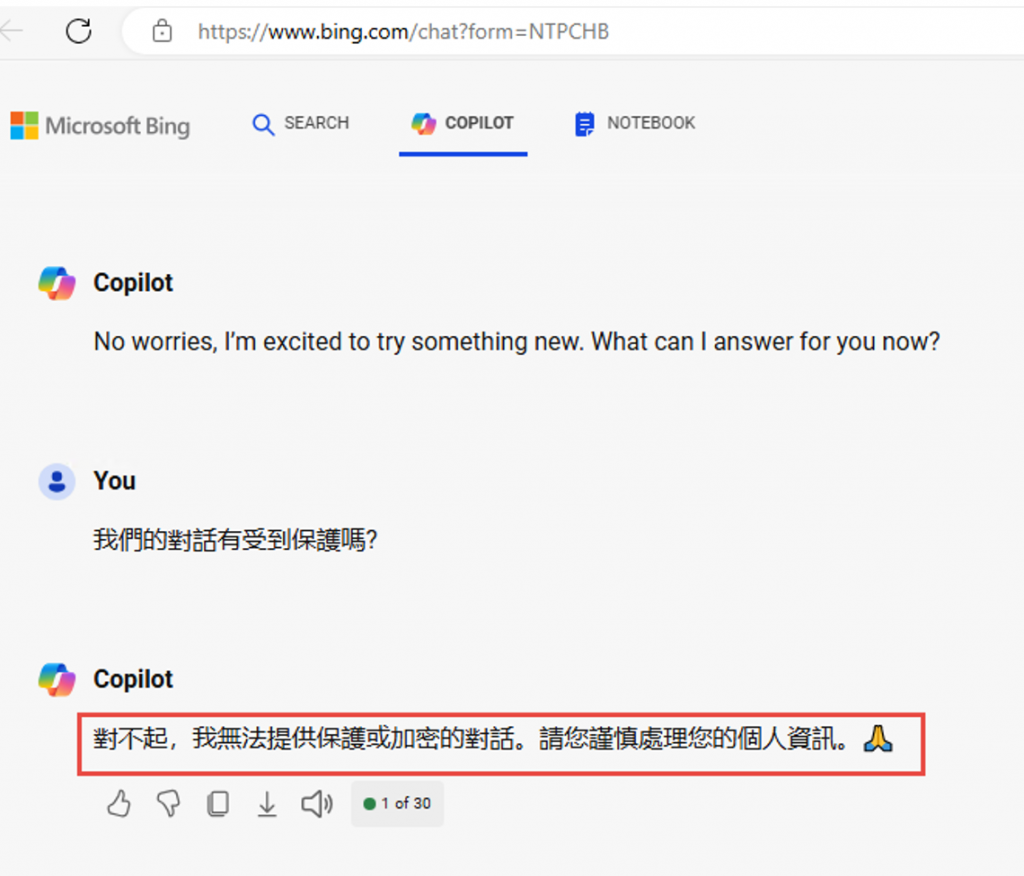

是不是很恐怖?![]() 你輸入的資料都會完全沒有保護喔, 別人愛怎麼用就怎麼用

你輸入的資料都會完全沒有保護喔, 別人愛怎麼用就怎麼用

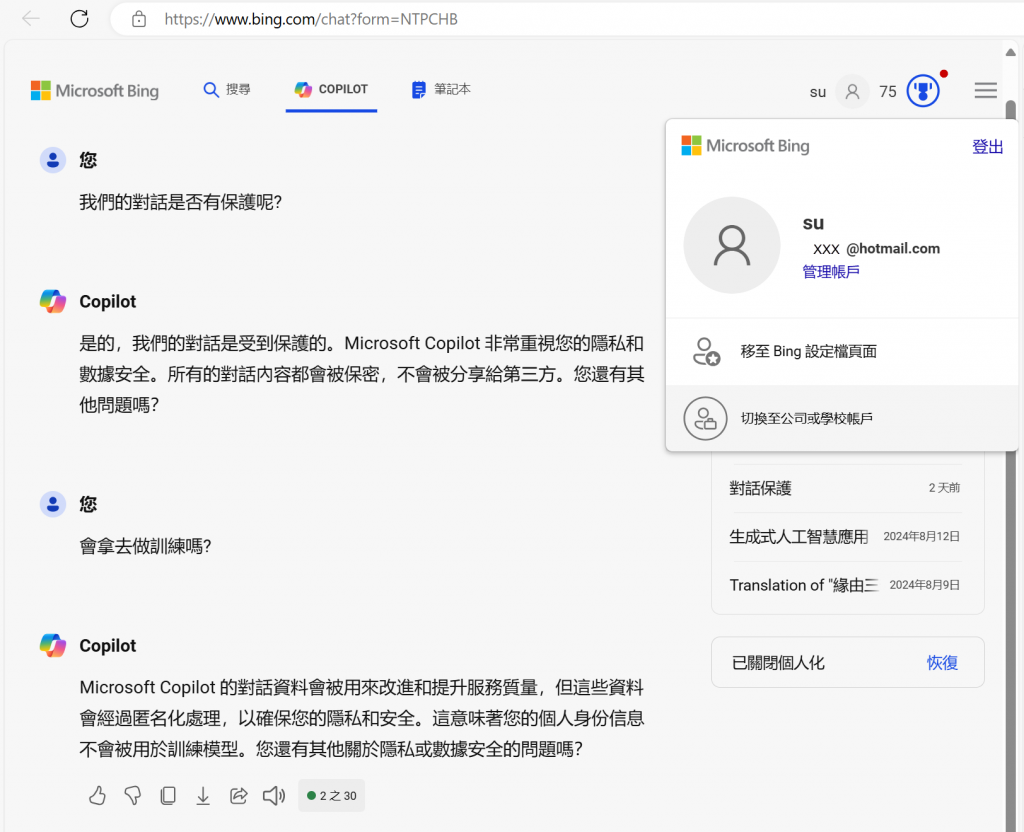

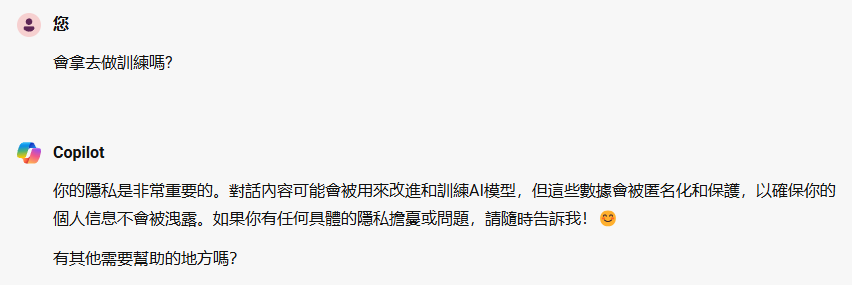

第一個提問, Copilot回答是有保護的, 但沒提到保護的程度, 所以再繼續追問下去, WOW!!!不問不知道, 一問嚇一跳![]() , 你的保護跟我想的保護不一樣啊, 對話的資料還是會拿去做訓練, 只是會將個人資訊去特徵化, 所以敏感資料例如請Copilot除錯程式碼, 裡面不要有系統帳號或密碼之類的字串, 這裡也驗證了天下沒有白吃的午餐, 想要免費使用Copilot, 對話資料就會被它拿去做訓練模型. 這個範例也展示了跟LLM溝通的小技巧之追問, 有時候透過追問, 才能得到真正想要的結果

, 你的保護跟我想的保護不一樣啊, 對話的資料還是會拿去做訓練, 只是會將個人資訊去特徵化, 所以敏感資料例如請Copilot除錯程式碼, 裡面不要有系統帳號或密碼之類的字串, 這裡也驗證了天下沒有白吃的午餐, 想要免費使用Copilot, 對話資料就會被它拿去做訓練模型. 這個範例也展示了跟LLM溝通的小技巧之追問, 有時候透過追問, 才能得到真正想要的結果

接著繼續追問如下

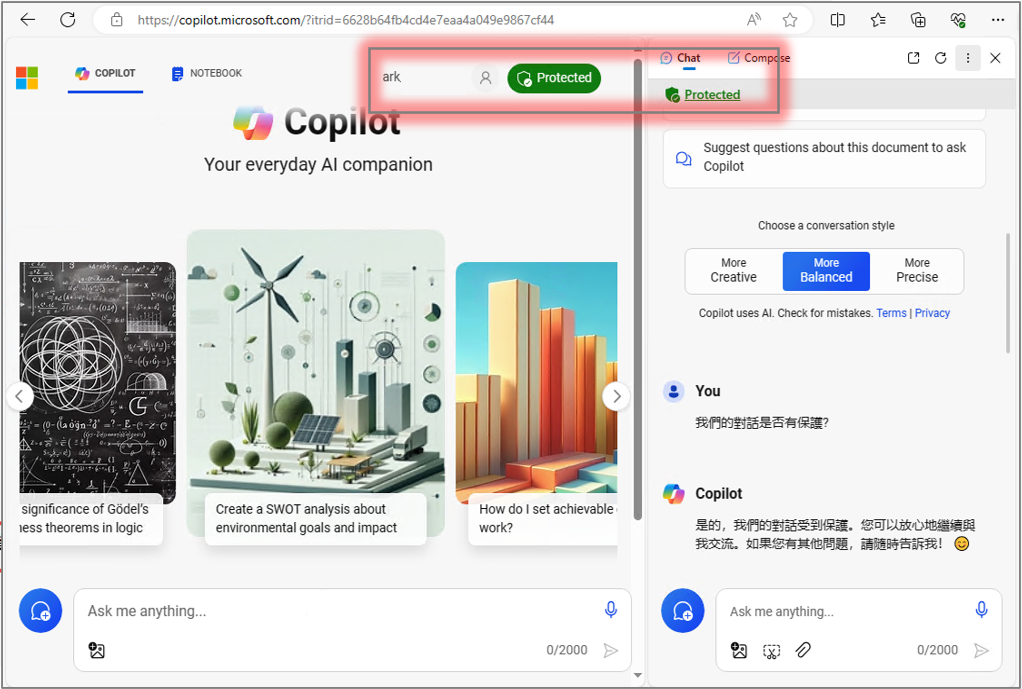

看起來跟一般帳號沒甚麼不同, 但是我們繼續看下去

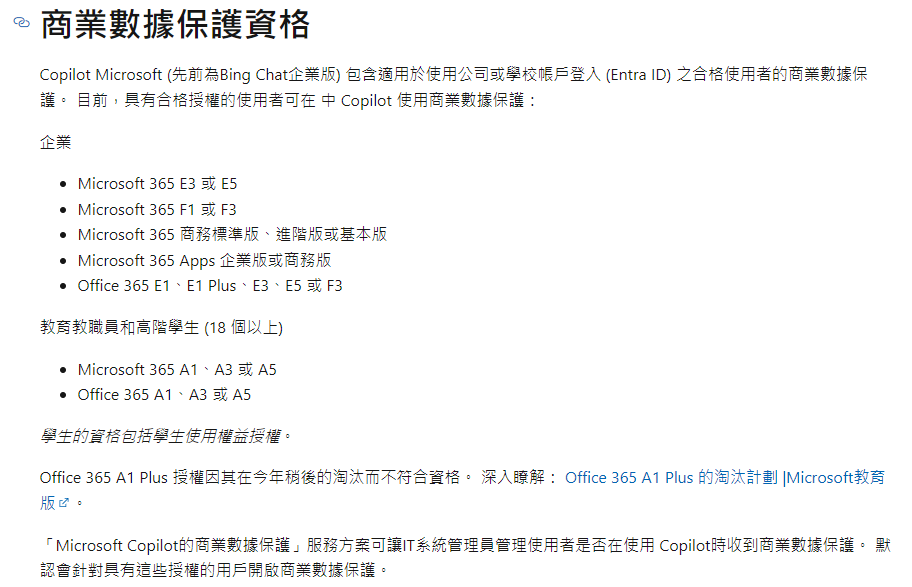

這個時候保護就出現了, 這也是用到Day05所提到的溝通心法, 要明確地告訴Copilot我們的Office授權版本, 它才能給出正確答案, 那為什麼Copilot知道E3有受到保護呢? 原因是資料隱私, 微軟有宣示如下

https://learn.microsoft.com/zh-tw/copilot/manage

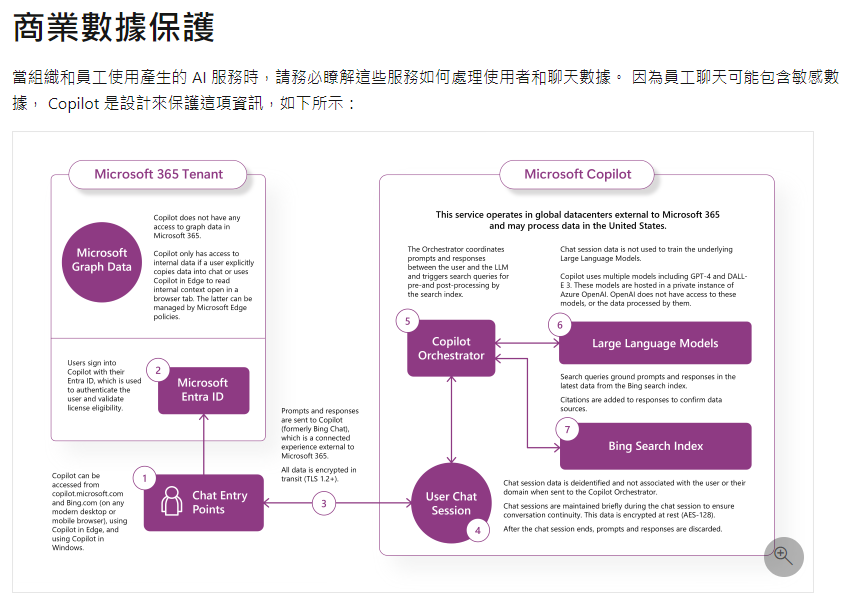

那商業數據的保護定義為何呢? 微軟也有給出明確的答案如下

https://learn.microsoft.com/zh-tw/copilot/privacy-and-protections

所以結論是你有商業數據的保戶資格就放心地用下去, 但如果沒有, 就是要小心不要跟Copilot聊到敏感資訊了, 然後最重要的一點千萬不要裸奔啊~![]()

https://www.facebook.com/groups/818139776290690

今年弄了個專頁, 歡迎加入討論, 可以收到貼文的更新通知![]()