隨著多模態模型進入成熟期,AI影片生成(Text-to-Video)在2026年出現明顯分歧:一派強調「生成品質」,另一派則專注於「製作流程與控制能力」。近期最具代表性的兩個模型——Seedance 2.0與Happy Horse 1.0——正好體現這種分化。表面上,Happy Horse 1.0在多項排行榜中領先,但在實際應用中,Seedance 2.0卻仍被許多開發者與內容團隊採用。這背後的原因,並不是單純的模型強弱,而是兩者在架構設計與優化目標上的根本差異。

本文將從模型能力、測評數據、生成效果、工程可用性四個層面,進行系統性拆解。深度對比這兩款模型的能力邊界。同時,我們也會探討目前台灣使用者與一般非技術背景的創作者(小白)在實際應用時遇到的痛點,並提供落地的解決方案。

在目前AI影片生成模型的發展脈絡中,Seedance 2.0之所以仍被視為「主流解法」,並不是因為它在單次生成畫質上領先,而是它在「可控性」這件事上,提供了目前最接近實務製作流程的解答。相較於多數模型將重點放在「生成結果」,Seedance 2.0的設計邏輯更接近傳統影像製作:先確定結構,再補齊內容。這種思路,使它在需要分鏡、運鏡與連續敘事的場景中,具備明顯優勢。

Seedance 2.0 作為老牌勁旅的升級版,其核心優勢在於對畫面的「極致控制力」。它在架構上大幅強化了時空一致性(Spatiotemporal Consistency),並主打以下兩大技術亮點:

除了靜態一致性,Seedance 2.0在「鏡頭控制」上的表現同樣值得關注。在測試中,當prompt包含攝影語言時,例如:緩慢推進、側向跟拍、環繞運鏡,模型通常能產生對應的動態效果,而非僅生成靜態構圖。這代表其訓練過程中,已將「視覺內容」與「鏡頭語意」建立關聯,使輸出結果更接近實際拍攝邏輯。

Seedance 2.0另一個較少被討論,但實際上非常關鍵的能力,是音畫同步。在部分測試案例中,當輸入語音或節奏資訊時,模型能讓畫面節奏與音訊產生基本對齊。例如,角色說話時的口型變化、或畫面切換與背景音樂節奏的同步。

這顯示模型不只是處理影像,而是開始處理「時間維度上的多模態對齊(temporal alignment)」。對於未來AI影片製作而言,這將是從「生成片段」走向「完整作品」的重要一步。

與Seedance 2.0的工程導向不同,Happy Horse 1.0採取的是另一條更激進的路線:將所有資源集中在「輸出品質」與「感官體驗」上。這種策略,使它在短時間內於各類測評中快速上升,並在實際使用中展現出極高的完成度。

Happy Horse 1.0採用的是一種高度整合的Transformer架構(Unified 40-Layer Transformer),其特點在於將影像與時間序列處理統一於同一模型中。這樣的設計帶來兩個直接影響:

相較於傳統diffusion+外部模組的組合,這種unified架構更有利於端到端優化(end-to-end optimization)。

在過去的AI影片製作流程中,「生成 → 放大(Upscale)→ 修補」幾乎是標準步驟。然而,Happy Horse 1.0嘗試跳過這一段流程,直接提供高解析輸出。其主要特點包括:

這種能力的意義,不只是畫面更清晰,而是改變了內容產出的型態。換言之傳統AI影片製作模型提供「可加工素材」,而Happy Horse 1.0提供的是接近最終成品的AI影片。 這也是為什麼在盲測評比中,它往往能取得較高評價,因為評審看到的就是最終視覺效果。

Happy Horse 1.0最具突破性的能力,在於其「音影同步生成(Joint Audio Synthesis)」。這是其最大的賣點,模型在生成影片畫面的同時,能原生運算並生成與畫面物理動作高度吻合的音效,無需後期配音。

為了撇除主觀的視覺偏好,我們參考了近期國內外深具指標性之技術社群的大型客觀盲測數據。在超過數千次的多模態測試中,兩者的交鋒結果如下:

Tips:Elo 評比本質上是讓評審在多段影片中選出「哪一段看起來更好」,因此結果會偏向反映:畫面是否吸引人(第一印象)、視覺完成度是否接近成品、動態是否自然流暢。相對地,像是「可控性」、「可重現性」或「長流程製作能力」等工程面指標,並不在評分重點之中。因此,這類分數更接近「觀看體驗評比」,而非完整的製作能力評估。

| 對比維度 | Seedance 2.0 | Happy Horse 1.0 |

|---|---|---|

| 模型定位 | 影片製作系統(Workflow-oriented) | 高品質生成模型(Output-oriented) |

| 核心目標 | 可控性、可重現性、流程整合 | 單次生成畫質與完成度最大化 |

| 架構設計 | 多模態融合(Text / Image / Video / Audio) | Unified Transformer(端到端生成) |

| 生成邏輯 | 條件約束生成(Conditioned Generation) | 自由生成(High-variance Generation) |

| 畫質表現 | 穩定、偏保守 | 極高、接近電影級輸出 |

| 動態穩定性 | 高(適合長流程) | 高(偏短片段最佳化) |

| 時序一致性 | 強(跨場景穩定) | 中高(短段落穩定) |

| Prompt 還原度 | 高但需結構化設計 | 高(自然語意即可) |

| 鏡頭控制能力 | 強(支援運鏡語言) | 弱(不可精細控制) |

| 音畫同步 | 需設定 / 可整合 | 原生支援(Joint Audio Synthesis) |

| 可重現性 | 高(適合工程流程) | 低(結果波動較大) |

| 使用難度 | 高(需理解參數與流程) | 低(即用型生成) |

| 成功率(一次生成) | 中 | 高 |

| 適用內容 | 廣告、分鏡影片、長敘事 | 短影音、社群內容、快速輸出 |

| 工程價值 | 高(可整合進 production pipeline) | 中(偏前端內容生成) |

總結:Seedance 2.0 與 Happy Horse 1.0 的差異,本質上不是能力高低,而是設計取向不同:一個強調可控的製作流程,一個追求單次生成的完成度。前者適合需要分鏡與長流程控制的專業製作,後者則更偏向快速產出與視覺效果優先的內容場景。簡單來說,Seedance 2.0是偏可控的影片製作工具,而Happy Horse 1.更趨向於即用型高畫質生成模型。

Prompt:"女僕刀舞 - Mei vs Coco" 時長:"15 秒" 輸入: A:@Image1 B:@Image2 角色: A: 姓名:"Mei Kirishima" 武器:"躊躇之劍(黑紫色)" B: 姓名:"Coco Sakuraba" 武器:"緞帶長槍(銀色 + 紅色緞帶)" 動作核心: A:["高速多段斬擊", "黑紫色光環", "多重殘影"] B:["長槍高速旋轉", "銀色光環", "緞帶螺旋"] 環境: 地點:"日式宅邸走廊(月夜,背景為障子門)" 光影:"月光藍 + 障子橘" 氛圍:"黑白塵埃" 運鏡:"24mm 至 70mm。高速跟拍 + 急停。衝擊瞬間慢動作(0.3 倍速)" 分鏡: - 分鏡:1 時長:"1.5 秒" 動作:"Mei(左)與 Coco(右)相距 10 公尺對峙。Mei 半拔出她的劍。" 運鏡:"緩慢水平平移(24mm)" - 分鏡:2 時長:"1.5 秒" 動作:"Mei 完全拔出劍。閃過一道黑紫色光環。Mei 朝 Coco 直線移動(帶有殘影)。" 運鏡:"朝 Mei 超高速推軌鏡頭(50mm)" - 分鏡:3 時長:"2 秒" 動作:"Coco 以長槍為軸心快速旋轉。Mei 的連續斬擊擊中長槍。產生白藍色火花。緞帶因離心力散開。" 運鏡:"以 Coco 為中心的旋轉鏡頭(45mm)" - 分鏡:4 時長:"1.5 秒" 動作:"Mei 將劍持於胸前。Coco 水平持槍。兩人觀察對方的動作。" 運鏡:"預判鏡頭。水平追蹤(35mm)" - 分鏡:5 時長:"2 秒" 動作:"Mei 進行 7 次連續斬擊。每次斬擊留下一道黑色光軌。Coco 揮動緞帶攔截。緞帶以白色光芒抹除黑色軌跡。" 運鏡:"朝 Mei 高速跟拍平移(50mm)" - 分鏡:6 時長:"1.5 秒" 動作:"Mei 揮出強力的斜向斬擊。黑紫色光環橫跨螢幕一半。Coco 斜眼看向長槍。" 運鏡:"斜向追蹤 Mei 的軌跡(50mm)" - 分鏡:7 時長:"2 秒" 動作:"Coco 旋轉身體並變換長槍架勢。進行 3 次高速連續突刺。Mei 用劍格擋。" 運鏡:"閃光推軌 + 朝 Coco 旋轉(40mm)" - 分鏡:8 時長:"2.5 秒" 動作:"劍與槍正面交鋒。火花劇烈爆炸(黑紫色 x 白藍色)。兩人的頭髮飄動。塵埃呈放射狀擴散。" 運鏡:"固定鏡頭。聚焦於衝擊點(70mm)" 特效:"慢動作 0.3 倍速" - 分鏡:9 時長:"1.5 秒" 動作:"Mei 與 Coco 被震退數公尺。她們跪下並凝視對方。" 運鏡:"同時從兩名角色向後移動(35mm)" - 分鏡:10 時長:"1 秒" 動作:"Mei 揮動劍。Coco 調整長槍姿勢。準備進入下一個起始姿勢。" 運鏡:"緩慢拉遠(24mm)" 循環:"黑白塵埃分離並旋轉。戰鬥永無止境。" 備註: - "Mei:直線型、銳利的動作。Coco:曲線型、流暢的動作。" - "黑紫色與白藍色火花展現了她們的個性。" - "月光與障子門強調了日式決鬥的場景感。"

其它進階設定:時長(15S),影片品質(1080P),影片尺寸(16:9)

Prompt:0:00 – 0:02 冷開場。極致特寫 STRIDEX 背包扣環扣上的瞬間。淺景深,清晰呈現縫線與標誌貼片細節。攝影機緩慢後拉。 立即確立產品識別度 — 請參考參考圖以確保背帶與扣環的準確性。 0:02 – 0:05 廣角無人機鏡頭。一名登山者在黃金時刻登上岩石稜線。STRIDEX 背包在琥珀色天空的襯托下清晰可見。攝影機向上掃視。 高海拔,戲劇性。背包輪廓必須符合參考圖的造型。 0:05 – 0:08 快節奏蒙太奇:三個快速剪輯 — 穿越狹窄小徑、跨越溪流踏石、行進間拉開側邊口袋。每個剪輯皆與打擊樂節奏同步。 展示產品實用性與動態感。所有剪輯中背包的配色須與參考圖保持一致。 0:08 – 0:11 慢動作。登山者躍過岩石縫隙。STRIDEX 背包背帶緊繃,肢體語言充滿自信。攝影機從側面跟拍 — 背包位於畫面中央。光線照亮標誌貼片。 英雄時刻。極致的電影感。120fps 慢動作質感。標誌的可見度至關重要。 0:11 – 0:13 登山者抵達山頂。轉身面對鏡頭,露出淺淺微笑。背包與身後的山景填滿整個畫面。攝影機緩慢推近,同時捕捉臉部與背包。 人與自然的連結時刻。產品清晰可見。溫暖的金色調。 0:13 – 0:15 切換至全黑畫面。STRIDEX 商標淡入,置中,純黑色背景上的簡潔白色文字。下方標語:「Built for where roads end.」。標誌停留 2 秒後淡出。 結尾標誌畫面。STRIDEX 商標拼寫必須精確,使用粗體無襯線字體。畫面上不應有其他元素。

其它進階設定:時長(15S),影片品質(1080P),影片尺寸(16:9)

對比觀感:從影片情節及動作的合理性來說,Seedance 2.0在兩個功能生成的影片效果中更勝一籌。在圖轉影片的生成影片中,Happy Horse 1.0生成的影片存在肢體融合的情況,距離其宣傳的生成即可使用還有相當的舉例。

隨著兩款模型投入實戰,開發者與社群論壇也湧現了大量的真實回饋。

多數開發者對其自帶高質感環境音效的功能讚不絕口,認為這大幅縮短了影音後製的時間及流程。然而,許多測試者也指出,當面對極端複雜的物理交錯動作時(例如多人近身格鬥),Happy Horse 1.0依然有一定機率出現肢體融合的災情;此外,在部分風景與人物生成上,偶爾會帶有過度飽和的「AI塑膠感」。

Happy Horse 1.0早期打著開源的旗號吸引了大量關注,但許多開發者實際扒開文檔後發現,其核心權重並未完全釋出,實質上仍需依賴呼叫特定的閉源API,這點在技術圈內引發了不小的討論與反彈。

即便模型再強大,如果無法順利調用,對使用者來說都是空談。目前台灣用戶若想直接使用這兩款模型的官方服務,會面臨極高的技術與硬體壁壘:

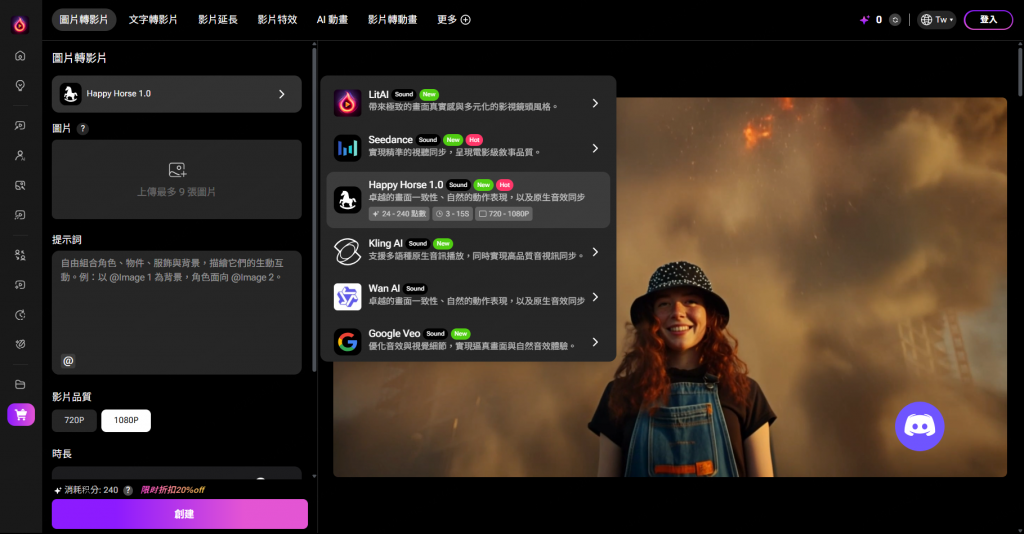

想要以最快的速度無限制體驗並對比Seedance 2.0及Happy Horse 1.0?綜合式AI平台無疑是最佳的選擇!但就目前台灣地區的支援平台測評,LitMeida是首選的體驗平台:

Vidnoz是一個主打AI影片生成與數位內容自動化製作的平台,核心目標是讓使用者能透過文字、圖片或簡單指令,快速生成具備配音、虛擬人像與動畫效果的影片內容。其系統整合了AI avatar、語音合成與模板化影片流程,降低傳統影片製作對拍攝、剪輯與後製的依賴,使內容創作門檻大幅下降。

從產品定位來看,Vidnoz更偏向「應用層整合平台」,而非單一模型驅動的生成系統。它將多種AI能力(如文字轉影片、虛擬人講解、圖像動畫化等)包裝為可直接使用的工具流程,適合行銷影片、產品介紹與教育內容等快速產出需求。

需要特別注意的是,目前Vidnoz的AI影片生成尚未整合Seedance 2.0或Happy Horse 1. 這類新一代進階影片生成模型。因此,在面對需要高度時空一致性控制或電影級畫質輸出的應用場景時,其能力仍與專業級生成模型存在一定差距。不過在「快速生成+模板化輸出」的定位上,Vidnoz仍具備明確的實用價值。

AI 影片生成的戰場在 2026 年已經從「能不能用」進化到了「誰更好用、誰更逼真」。Seedance 2.0 以強大的時空一致性與控制力穩紮穩打;而 Happy Horse 1.0 則以原生音效與極具張力的畫面質感異軍突起。

對於技術讀者或是廣大的創作者而言,與其將寶貴的時間耗費在解決VPN、註冊海外門號或除錯API串接等底層基建問題上,不如善用整合式的AI影視創作平台如LitMedia、Vidnoz.MyEdit這類已經鋪設好在地化通道的平台。將精力專注於「提示詞工程 (Prompt Engineering)」與創意發想,才是掌握這波AI影音革命的最優解。