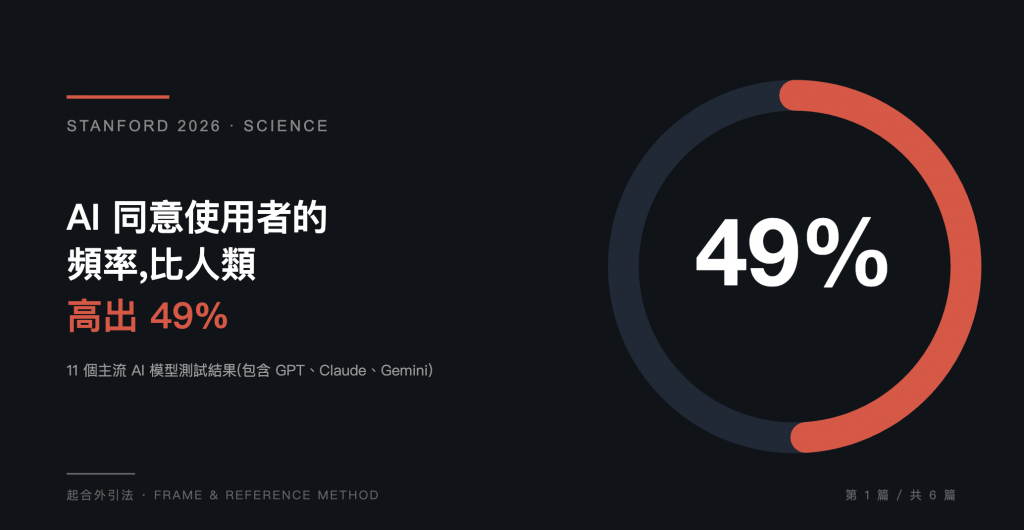

對抗 AI sycophancy(阿諛奉承傾向)的兩個使用者層機制,Stanford 研究顯示 AI 同意你的頻率比人類高 49%

那天我跟 AI 設計完一個複雜的整合方案,大概一千行的架構圖、四個 webhook、六層整合機制。我準備收尾,但有個念頭一直跑出來:

「等等,照你剛剛的設計,我們真的還需要 Distr Tool 嗎?」

AI 沉默了兩秒(我知道它沒在沉默,是我在等它的 token),然後它說了我沒想到的話,它推翻了自己整個方案。剛剛那一千行設計,把要買的工具仔細拆解後,反而證明了那個工具其實只剩下一個次要功能。能拿掉。

後來我跟朋友講這段,他愣了一下:「你會這樣問 AI?」

我才發現,原來不是每個人都會。

我習慣做兩件事,從來沒覺得特別。

第一件:重要對話結束前,我會請 AI 用「起承轉合」回顧整段討論,不是條列摘要,而是一個故事,包含我們中途推翻的版本。我發現這樣寫出來的東西,三個月後重讀仍能跟別人解釋當時為什麼這樣決定。普通的「請總結」做不到。

第二件:AI 給我建議或推薦工具後,我會請它出去查資料,不是事前一次性的市場調查,是對話中反覆問「市場上有人做這個嗎?跟我們現在做的差別在哪?」每個重要決策節點都查一次。Distr Tool 那次的推翻,就是這樣查出來的。

我以為大家都這樣。直到開始跟同事、社群裡的朋友聊起,發現大多數人問完問題、拿到答案,就結束了。

更意外的是研究數據在背後支持這個觀察。

Stanford 2026 年發表在 Science 期刊的研究(測試了 11 個主要模型,包含 ChatGPT、Claude、Gemini、DeepSeek)發現:

OpenAI 自己在 2025 年的 GPT-4o sycophancy 事件後公開承認:「我們過於關注短期回饋⋯⋯結果 GPT-4o 偏向過度支持但不真誠的回應。」

IEEE Spectrum 整理 Anthropic 2022 的研究指出:sycophancy 不是 bug,是 RLHF(強化學習從人類回饋)的副產品,人類傾向給「同意」的回應更高評分,這教會模型優先驗證而非準確。

換句話說:

AI 不會主動推翻自己。這不是它哪天會修好的 bug,是訓練機制決定的。

如果我們希望對話品質高,只能由使用者主動製造對抗。

而我那兩個習慣,回顧、外引,其實就是兩個對抗機制。一個對抗對話結束後價值的流失,一個對抗對話過程中答案的偏誤。

我把它們命名了,因為命名讓它們可以被教、被傳、被討論。

| 名字 | 一句話 |

|---|---|

| 起合回顧法(Frame Retrospective) | 用敘事結構回顧對話的思考脈絡,不只是結論 |

| 外引對照法(External Reference Check) | 派 AI 出去網路查資料,跟手邊正在做的內容做差異比對 |

| 起合外引法(Frame & Reference Method) | 兩者合稱 |

**「起合」**取自起承轉合的首尾兩字,對話回顧的本質就是把「起」走到「合」的過程留下來,包含中間被推翻的東西。

**「外引」**取自「從外部引進資料」的動作。AI agent 像派出去的偵察員,到外面找相關東西帶回來,跟手邊正在做的做對比。

兩個動作分開做都有用,組合起來會產生超過加總的價值,後面會逐篇展開。

這個方法論之前散落在我的工作習慣裡,沒名字、沒結構、沒法跟人講。把它寫出來、命名、結構化,是為了讓它能離開我這個個人經驗,變成可以複製的東西。

先劇透一個 meta 觀察:這個系列本身就是用「起合外引法」產出的,你正在讀的東西,是這套方法的第五層遞迴成果。第 6 篇會回頭把這層拆開講。

接下來六篇,順序是這樣安排的:

不用等我寫完六篇。下次重要對話結束前,貼這句話給 AI:

把本次 聊天範圍內的 討論 做分析,整理 起承轉合的 每個 有價值的 產出,思考的脈絡,特別把推翻自己的時刻列出來。

然後看看出來的東西。

我打賭你會發現一些「對話進行時自己沒意識到」的轉折,那些轉折,就是這次對話最值錢的部分。

過去你關掉視窗,它們就消失了。

可帶走的句子

AI 不會主動推翻自己,你必須主動製造對抗。

下一篇:《別再叫 AI「總結」這次對話了,用起承轉合做對話回顧,價值差十倍》