本文分享於VMware ESXi 5.0實作iSCSI Multi Path Input/Output(MPIO)之設定

[LACP vs MPIO]

實作前可先了解LACP與MPIO兩者用途,可參閱weithenn blog及Johnny blog,皆有詳細說明,以下將簡述:

LACP(Link Aggregation Control Protocol)

主要是啓用Network Switch的IEEE 802.3ad(Link Aggregation Control Protocol,LACP)功能,並配合ESXi NIC Teaming設定達成iSCSI多重路徑的failover需求,但無法達成負載平衡需求

原因為大多數的iSCSI Target只有一個 IP 位址,故只會產生1個 Hash值,因而無法達成負載平衡需求

較適合於Outbound的目標是多個 IP 位址的環境,即可過 IP Hash 雜湊出不同 Hash 值並存取不同路徑進而顯現出它的效益,適合屬於File Level的服務

MPIO(Multi Path Input/Output)

針對IP-SAN及FC-SAN故障切換及負載平衡進行設計,因此iSCSI Initiator會使用多個 Session並透過多個實體網路卡,做到故障切換及負載平衡方式來登入iSCSI Target進行存取,適合屬於Block Level的服務

[Lab Information]

此次實作環境資訊如下:

ESXi Host version: 5.0

ESXi root password: 12345678

ESXi Host SSH service: Enable

ESXi Host vmnic type: 10GB

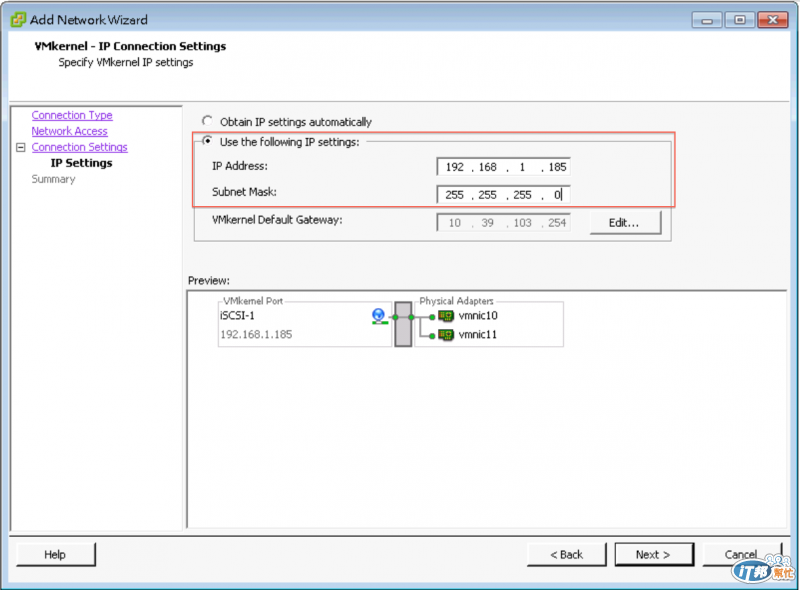

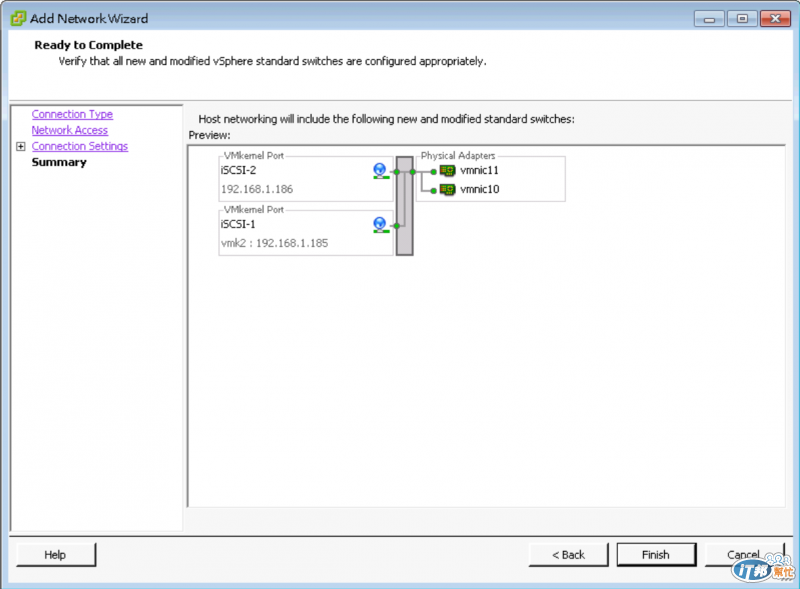

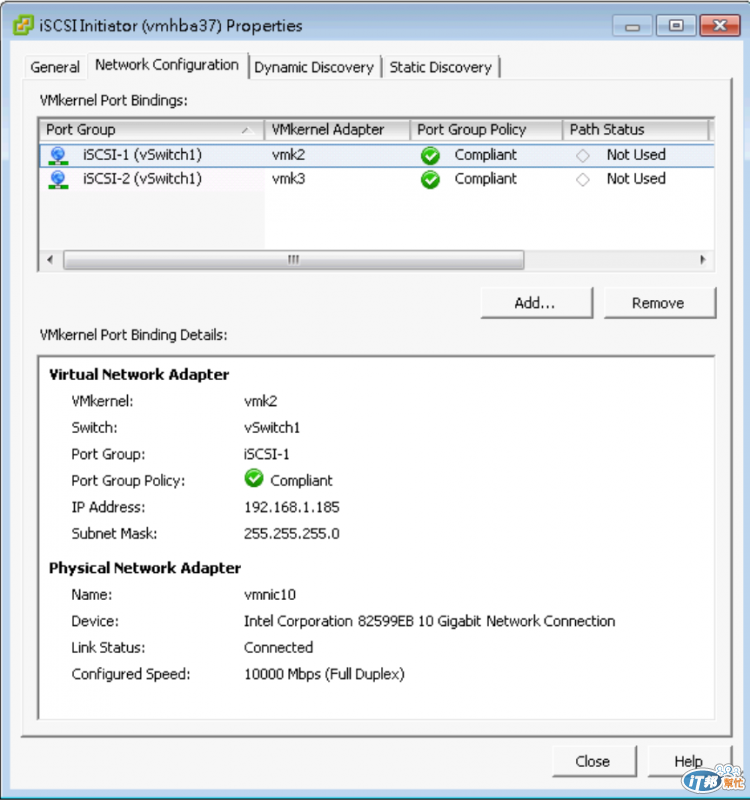

ESXi Host VMkernel Port IP(iSCSI Initiator): 192.168.1.185、192.168.1.186

iSCSI Target IP: 192.168.1.170

LUN Size: 1TB

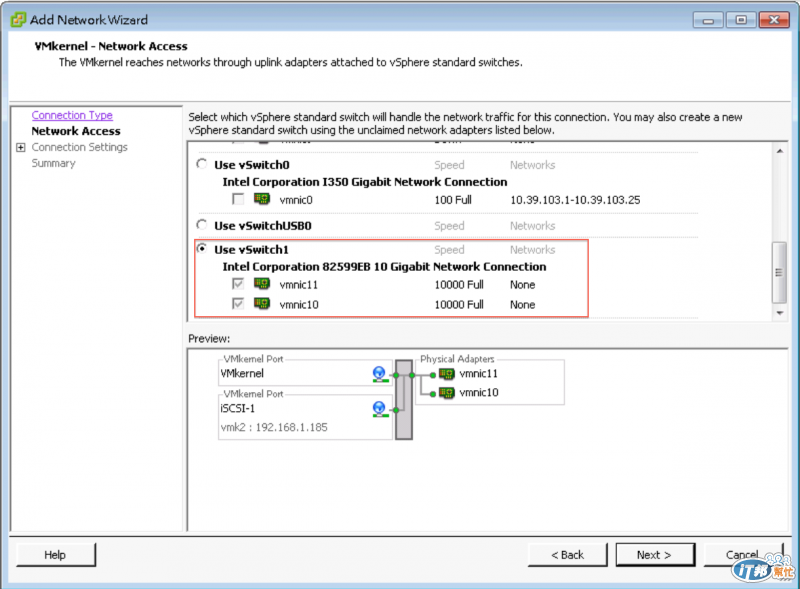

[Create VMkernel Port]

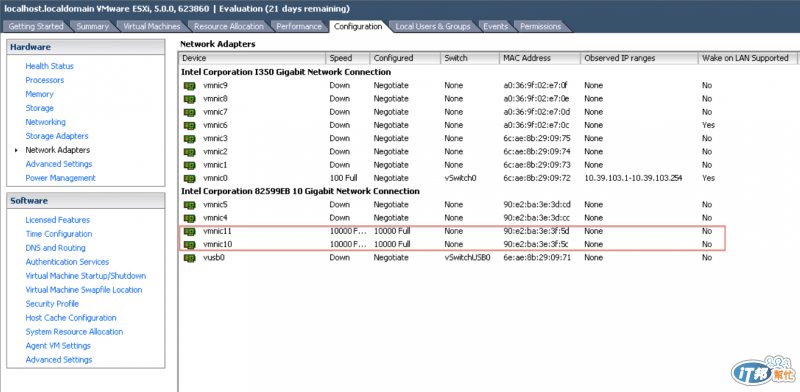

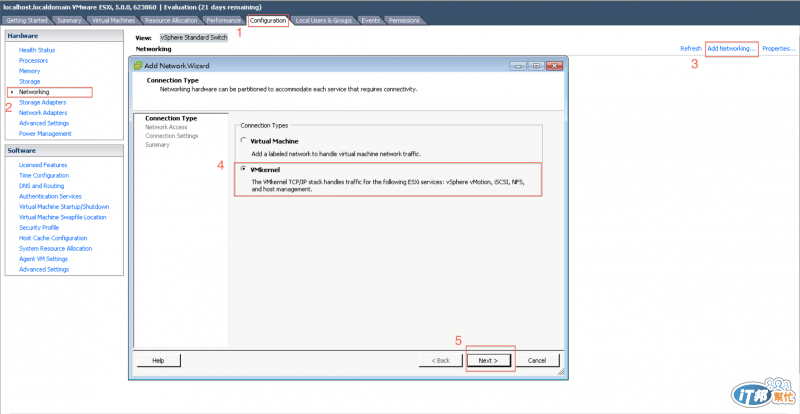

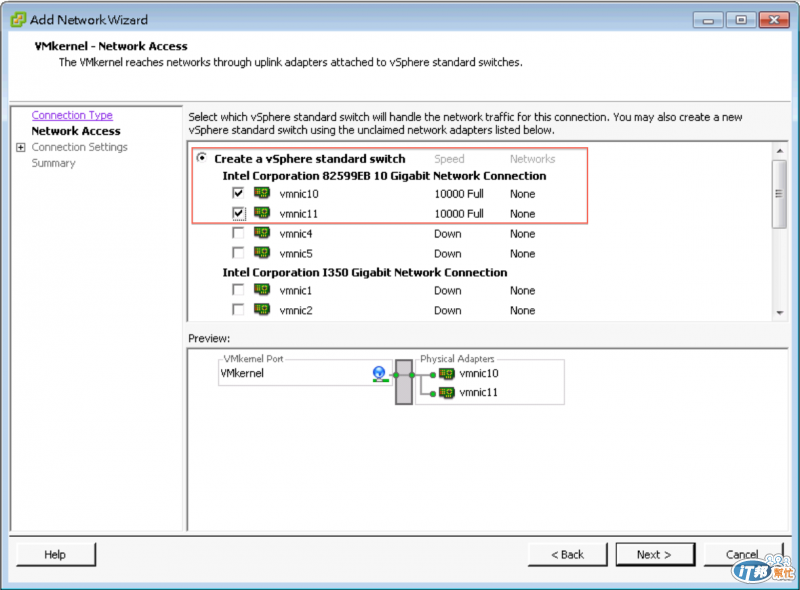

設定iSCSI Initiator前須建立VMkernel Port,步驟如下:

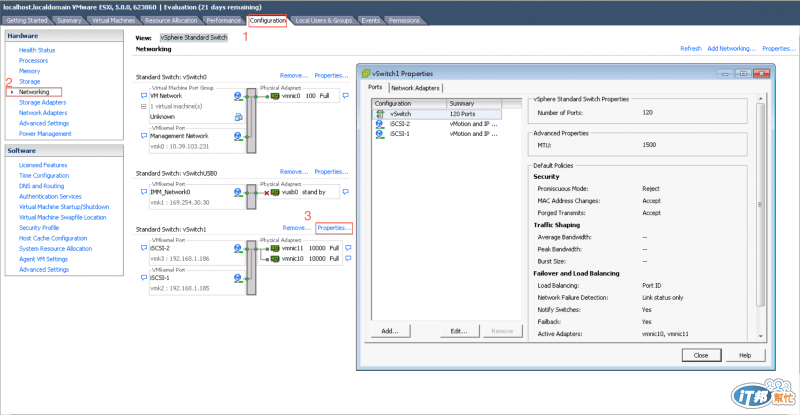

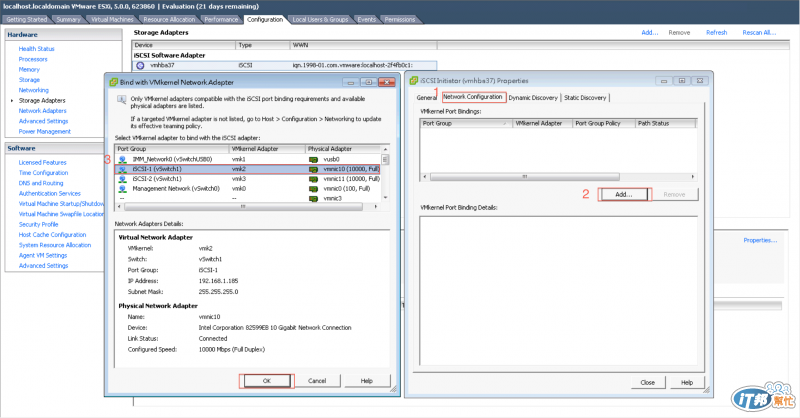

[Configure VMkernel Port]

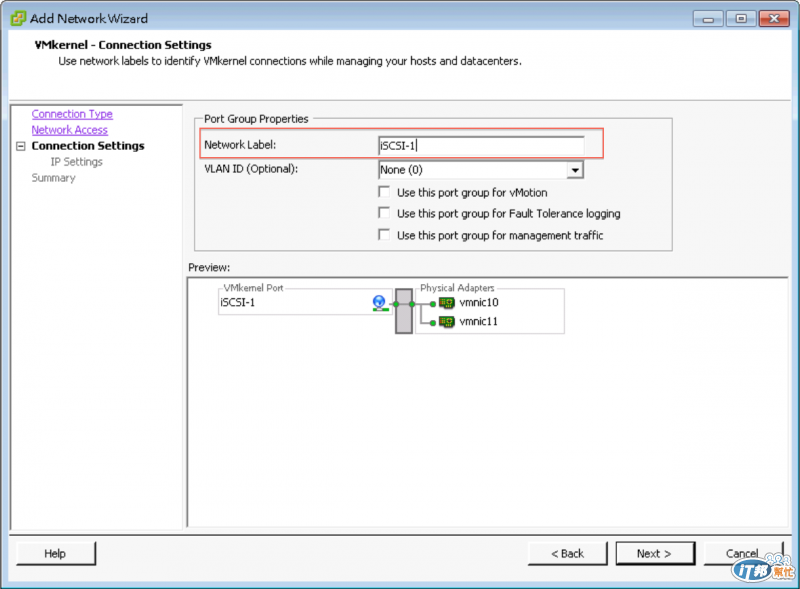

設定VMkernel Port以1對1的方式對應實體網路卡 (vmnic10、vmnic11)步驟如下:

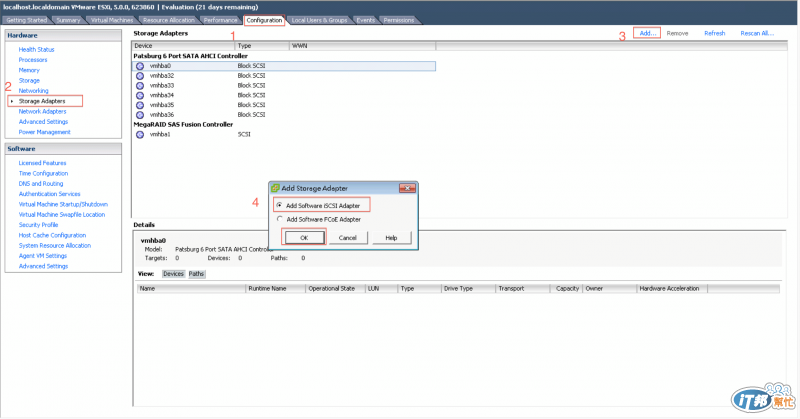

[Create Software iSCSI Adapter]

下列步驟為建立iSCSI Initiator所使用的Software iSCSI Adapter:

點選『Configuration』>『Storage Adapters』>『Add...』,選擇『Add Software iSCSI Adapter』,並按『OK』完成建立,此範例為vmhba37,如下圖紅框處示:

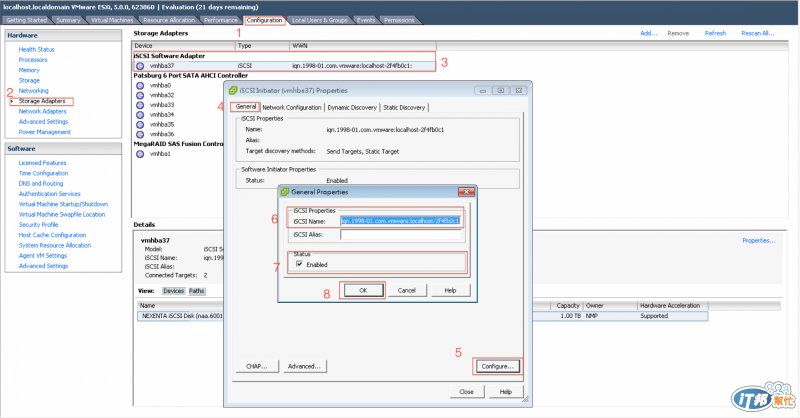

[Configure Software iSCSI Adapter]

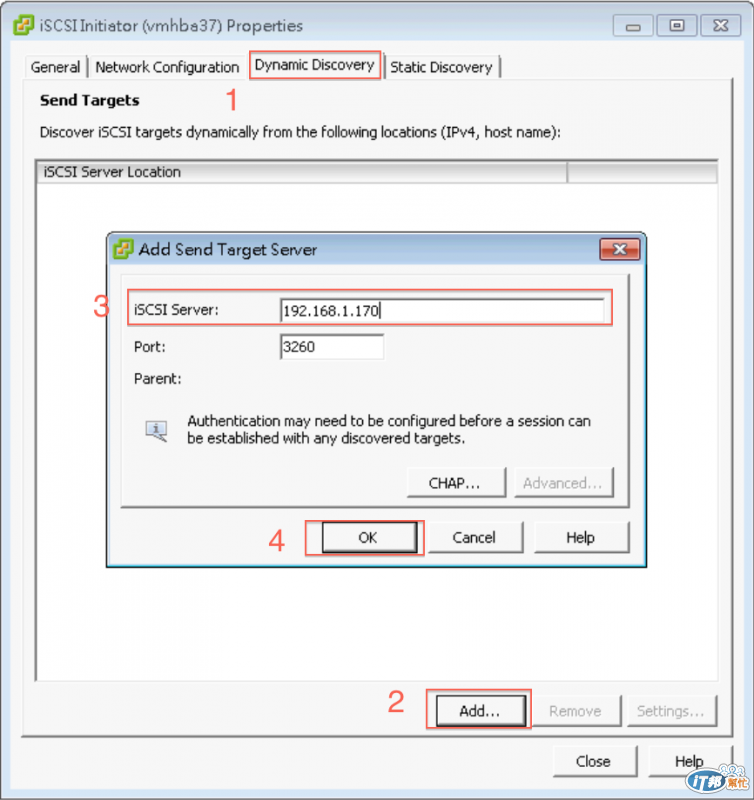

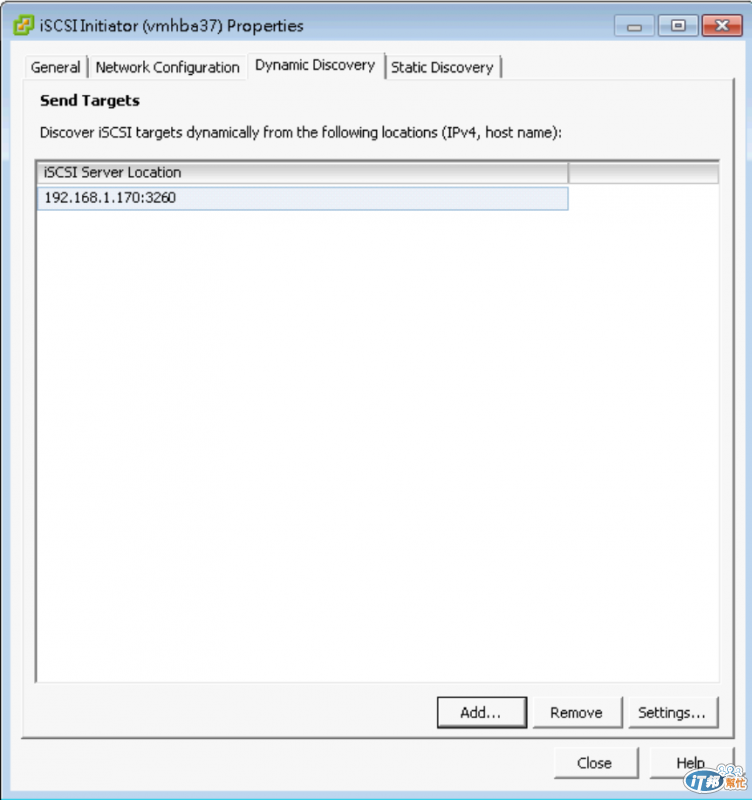

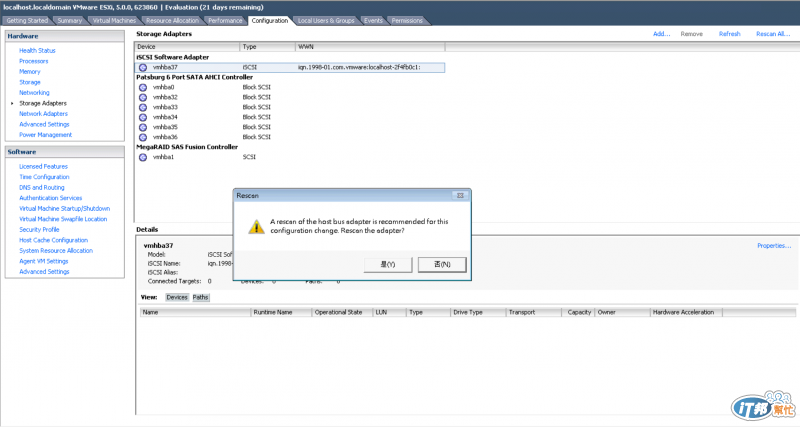

下列步驟開始設定iSCSI Initiator:

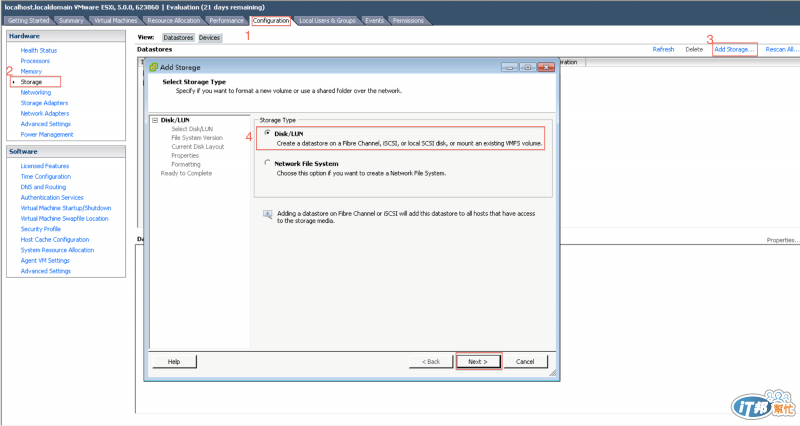

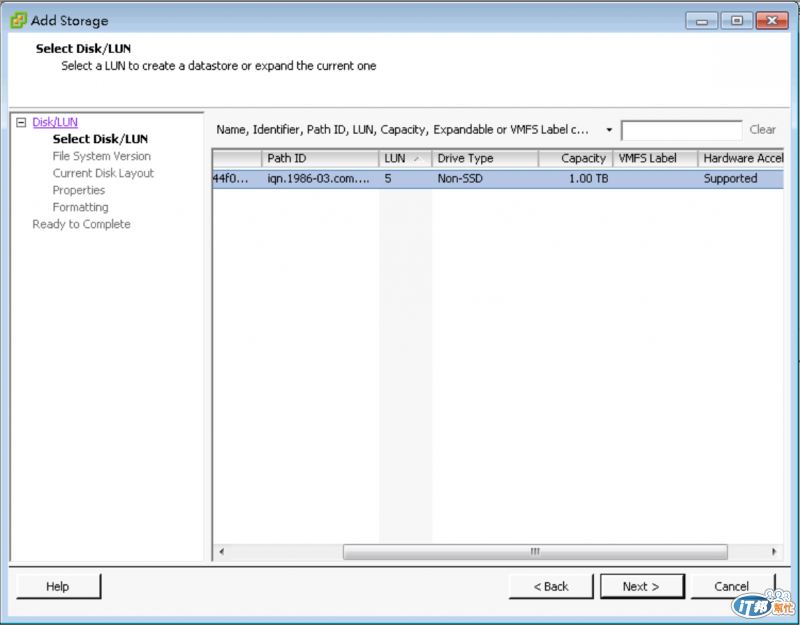

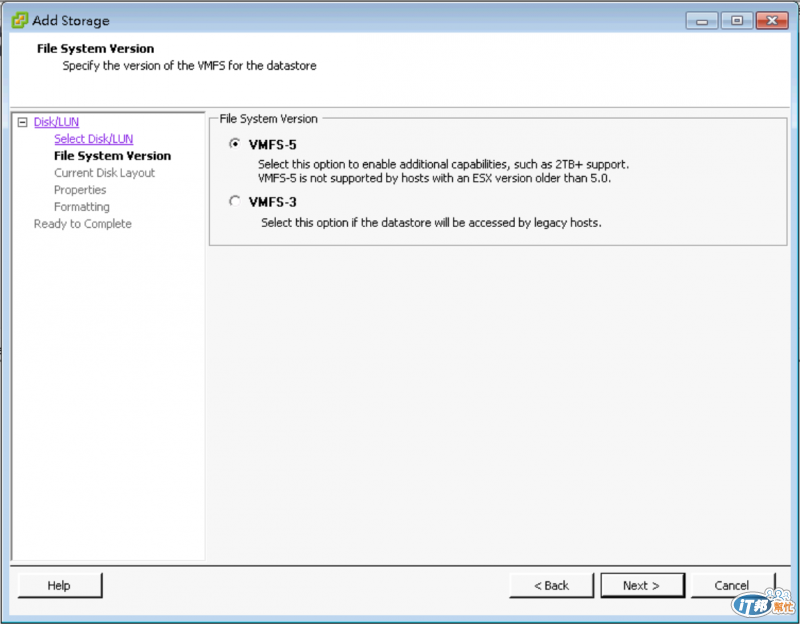

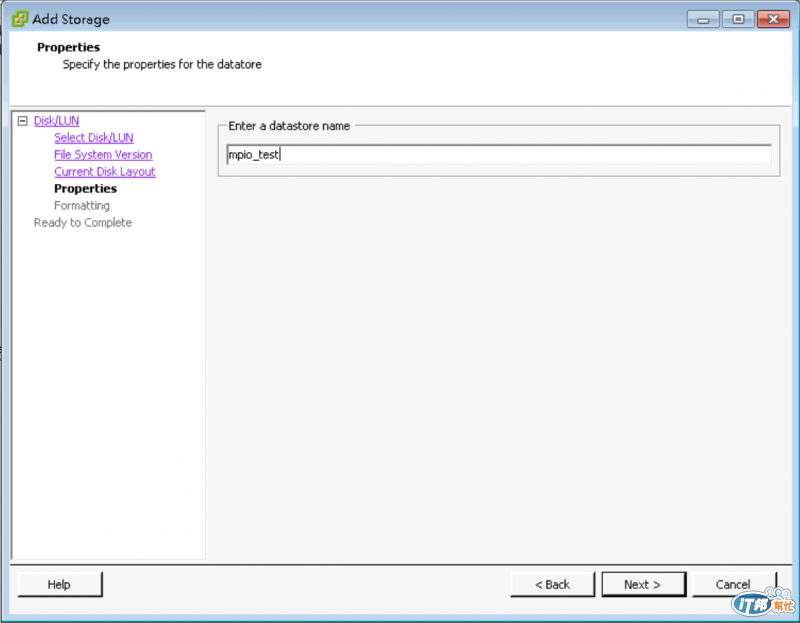

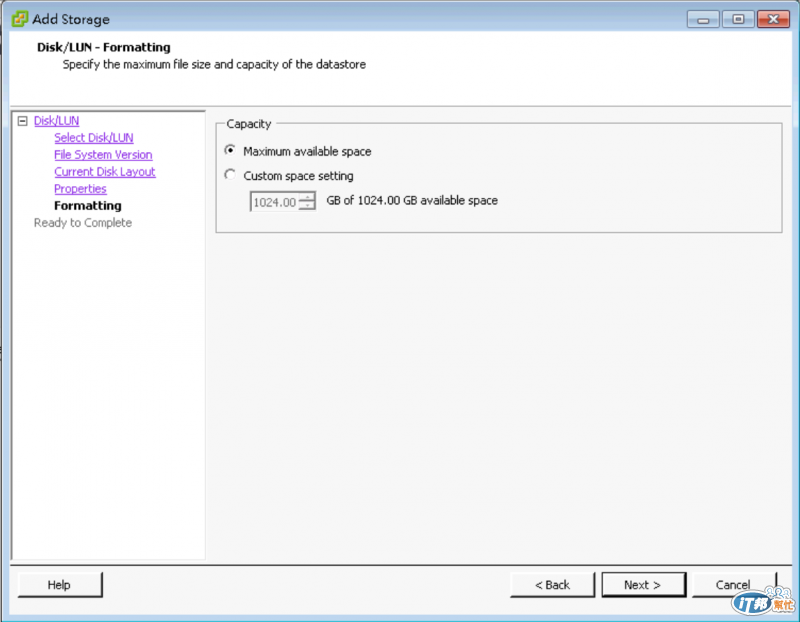

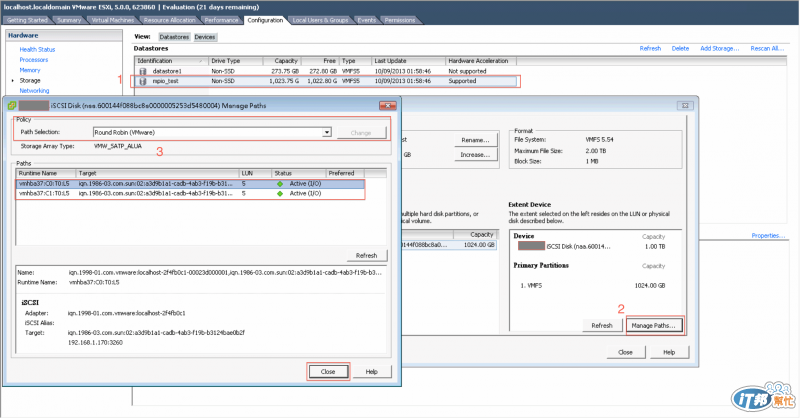

[Create Datastore]

透過iSCSI Target所配發的LUN,建立Datastore,步驟如下:

[Reference]

VMware MPIO

NIC Teaming

實戰ESXi 5設置MPIO 打造IP-SAN負載平衡容錯

vSphere 的 iSCSI Multipathing 配置