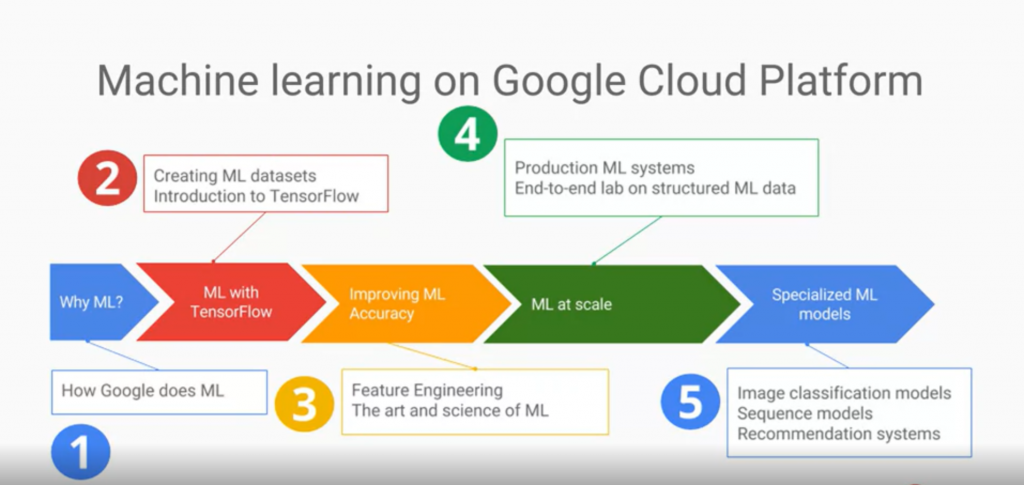

第四個步驟就是介紹Google 自家GCP對於ML的生態系和基礎設施彈性擴張(infrastructure extension)的支援。

(就是透過課程promote自家GCP作為機器學習的雲服務的概念)

Machine Learnging at Scale

一個專案從雛形、建模、測試、調教參數、到真正上線服務一定會遇到相關硬體配置(scale-up)

和軟硬體整合的議題(hw/sw integration)

考量到微型企業或者個人開發者在擴大服務所需要的成本與困難,

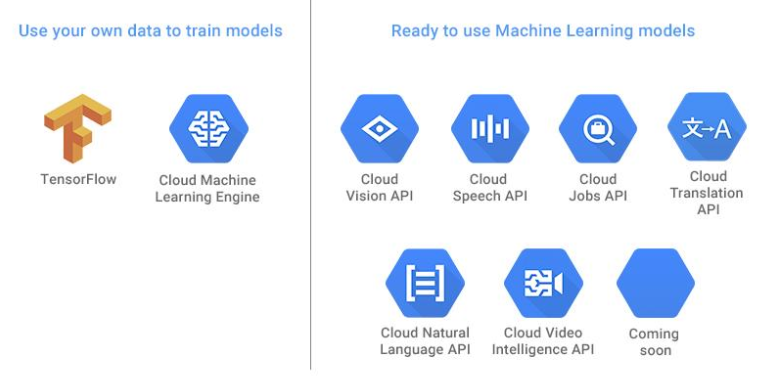

Google看到了這個利基切入點,以現有成熟的Google Cloud Platform,

在上面搭建各種常用的ML Framework(主推Tensorflow)/應用API,

與SQL-like的BigQuery Database 資料庫服務。

像是

影像辨識( Cloud Vision API)、

語音辨識( Cloud Speech API)、

文字翻譯( Cloud Translation API)、

自然語言辨識 ( Cloud Natural Language API)...等等這些應用,

GCP都有提供對應的API提供開發者使用。

希望能讓開發者專注於ML服務的開發development本身,

並且把ML Model抽離出來成為一個可動態配置的物件,

並且支援distribution deployment。

讓網路建構和硬體彈性擴充的工作off-load到GCP,

大幅減輕開發者在硬體建置與管理上的負擔。