哈囉大家好,我是橘白卯咪,歡迎大家來看看我能不能撐過30天

今天我們來談談自己建立資料集

當時的類神經網路課程,老師介紹了許多著名的資料集,如筆跡的mnist,十種動物類別的cifar100

所以對於訓練資料,還有著"資料量越大,效果越好"這樣的迷思

當時跟同學閒聊,說到自己得要自己建資料集

同學都一臉:妳瘋了嗎?怎麼可能?下班太閒逆? 的表情

但看到第11天所介紹的作品,這個作者也是很敬業的自己跳下去(物理 建立資料集

覺得自己跟這些同學最大的差異,就是 臉皮厚 親力親為了,沒在怕,來試試吧!

第一個自己建立的資料集,當初抱著試試看的心態,就訓練只能辨識一個簡單動作的模型吧

剛好那時候看的迷因和搞笑短片,都常出現 dab 這個動作

附上wiki的解釋

加上這個動作簡單好辨認,就決定是它了!

首先看了教學影片,確認動作的細節

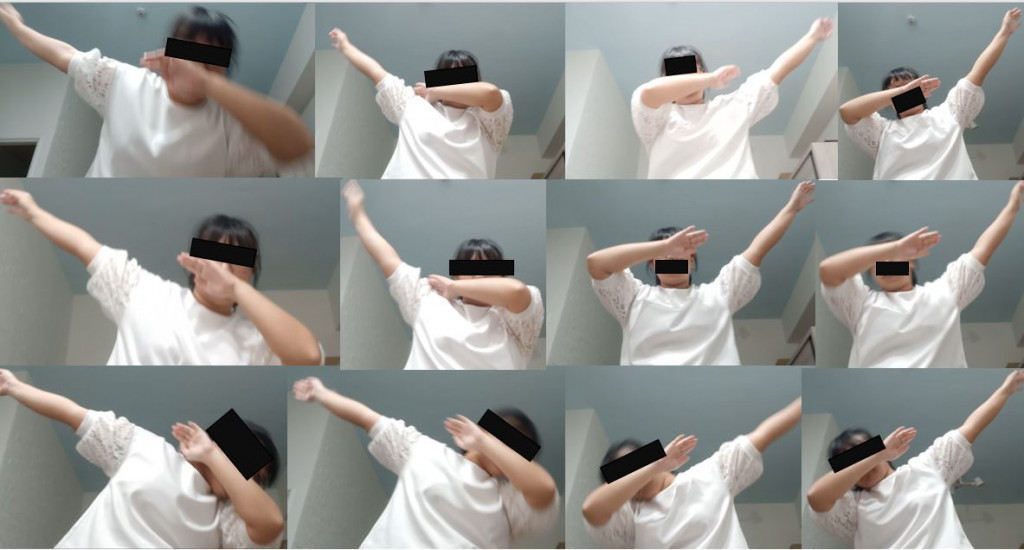

然後,就自己拍了影片當作資料集

(因為太恥了所以只截幾個動作不放原片上來了,外加屏蔽了一下臉

(還是認出我的先假裝不認識拜託了嗚嗚

(恥爆

可以從這張恥到爆的圖看到,dab這個動作可以是左邊跟右邊,有臉部朝下跟臉部不朝下兩種,兩手的角度跟位置也有差異

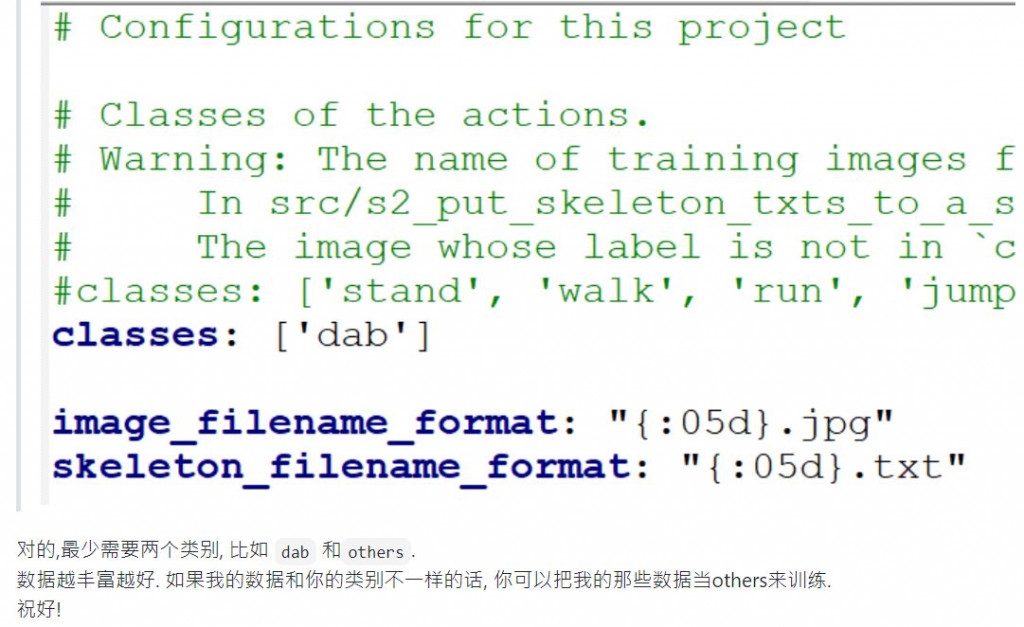

千辛萬苦終於把足夠的資料收集到啦~~歡天喜地的要來訓練模型,卻報出了這行錯誤:

ValueError: non-broadcastable output operand with shape (1,) doesn't match the broadcast shape (2,)

發個issue問作者,才發現: 原來不能只訓練一個動作類別啊啊啊!!

於是就使用自己的影片訓練dab類別,作者的資料集訓練other類別

證實了這個作品真的可以訓練自己訂定主題的辨識模型出來!

不過後來當然不可能用dab來研究吧(笑,之後還拍了幾個不同的角度、畫面來測試

側面全身

還有側面半身、正面全身的圖,不過影像的收集對象是其他人,無法放圖上來,只好放個示意圖

側面半身

正面全身

嘗試了各種角度、各種場景的拍攝。每次收集完資料都是剪片地獄嗚嗚嗚![]()

以第11天介紹的這套工具來說,正面全身無遮蔽的效果會是最好的,於是之後都採用這個角度拍攝

明天,讓我們繼續建立模型!