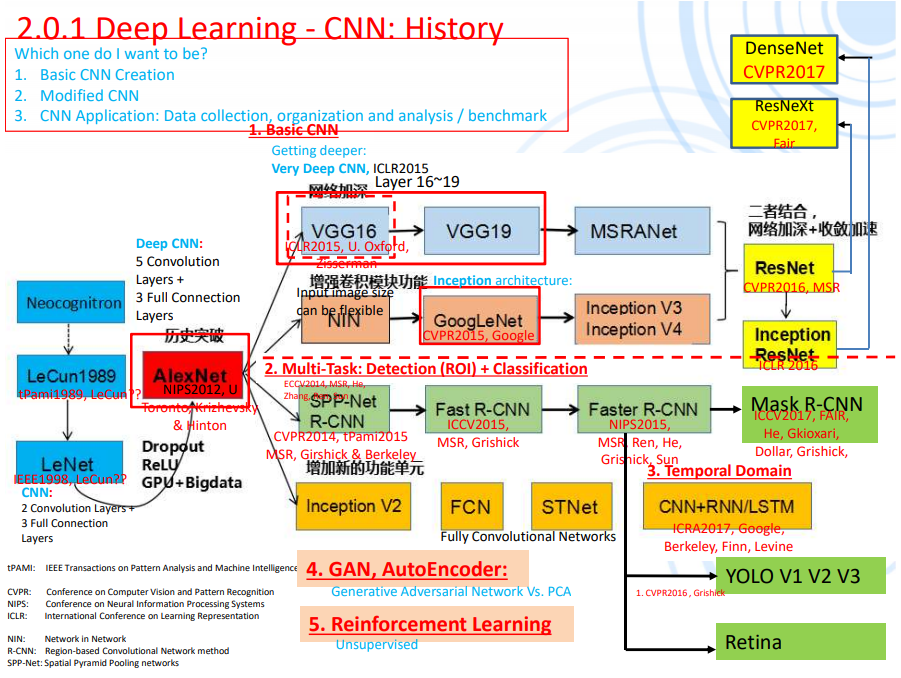

CNN歷史已發生,為何要花時間瞭解它?個人認為瞭解CNN歷史可以讓我們選擇以同方式解決不同問題,如下圖(來源: 成功大學 連震杰 教授)我們可利用較現代方式(VGG19 19層),亦可以較古老方式 (1998 LeNet 5層或 2012 AlexNet 8層),取決於我們擁有多少資源(電腦多強、訓練需多久......)和不同目的而定,我們一定不想殺雞用牛刀吧。

專門解決圖像問題的機器現在大多使用 CNN 來消化處理影像,其相當於眼睛的角色,用以辨識不同物體。我們可把它看作特徵提取層,可以最大利用圖像的局部信息並將局部特徵拼接起來,從而得到整幅圖的特徵。其概念類似於通過拼圖來還原圖像。原文網址

從1980年代便開始快速發展的 CNN,是當今自動駕駛車、石油探勘及核融合研究的先鋒,也使我們能更快速地在醫學影像裡找出疾病和拯救生命。

來源: 成功大學 連震杰 教授

註:

1.下文中的專有詞,之後文章會有說明,此處是快速整理供日後參考

2.MNIST(Modified National Institute of Standards and Technology) : 手寫數字資料庫 0-9. (60,000 training samples, 10,000 testing samples)

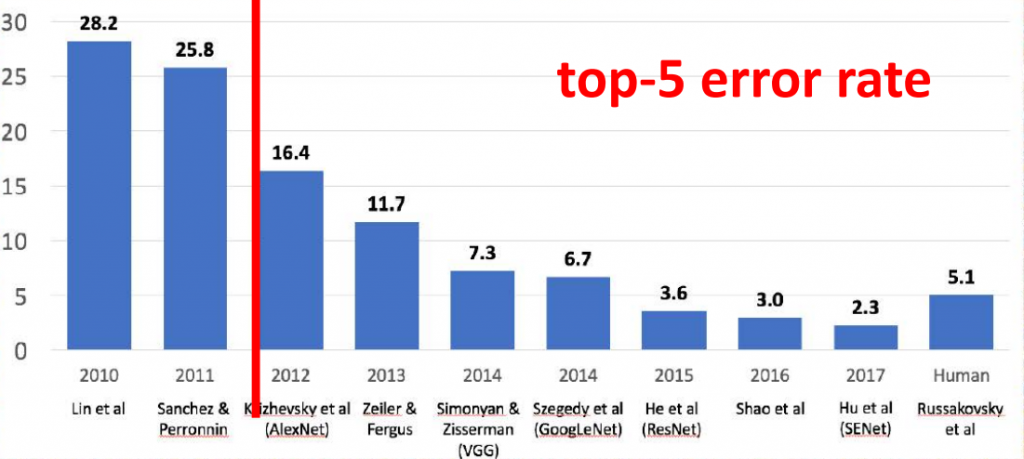

3.ILSVRC(ImageNet Large Scale Visual Recognition Challenge) : 年度圖像識別挑戰賽,挑戰物體檢測和圖像分類的算法。有十種目錄供辨識,目的是使研究人員可以比較各方的檢測速度,另一個目的是測量電腦視覺辨識的發展進度。使用資料 ImageNet (1,200,000 samples)

LeNet (1998, Yann LeCun)

AlexNet (2012 , Alex Krizhevsky)

VGG (2014 , Visual Geometry Group)

GoogLeNet (2014 , Going Deeper with Convolutions)

ResNet (2015 , Deep Residual Learning for Image Recognition)