進入主程式前,我們先看class 大塊

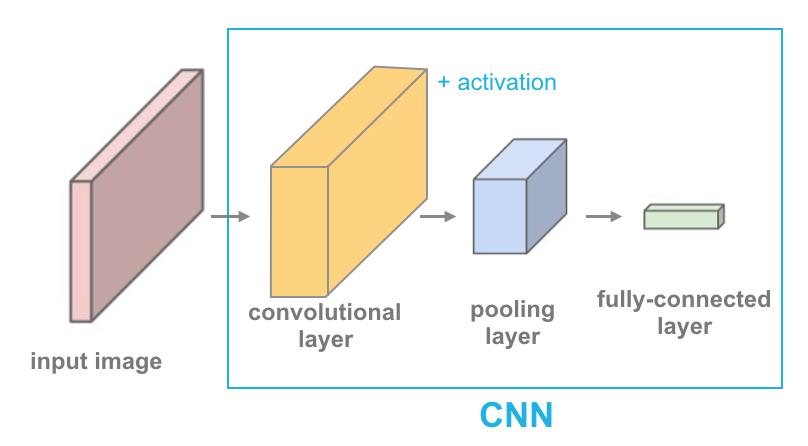

Class Net:神經網路的定義處。

class Net(nn.Module):

def __init__(self, hidden_size):

super(Net, self).__init__()

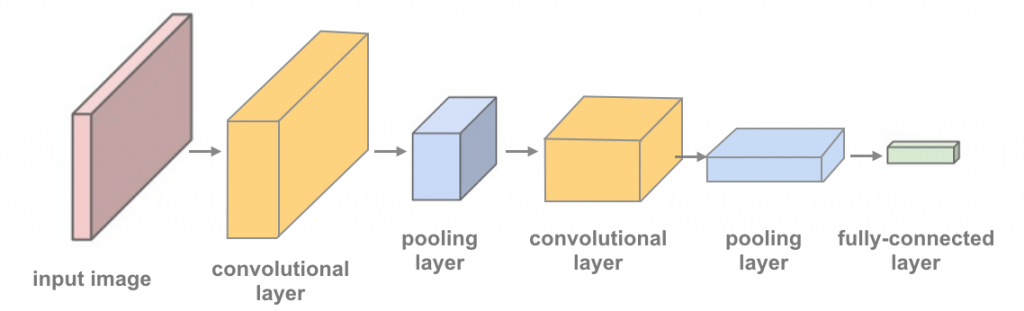

self.conv1 = nn.Conv2d(1, 20, 5, 1)

self.conv2 = nn.Conv2d(20, 50, 5, 1)

self.fc1 = nn.Linear(4*4*50, hidden_size)

self.fc2 = nn.Linear(hidden_size, 10)

def forward(self, x):

x = F.relu(self.conv1(x))

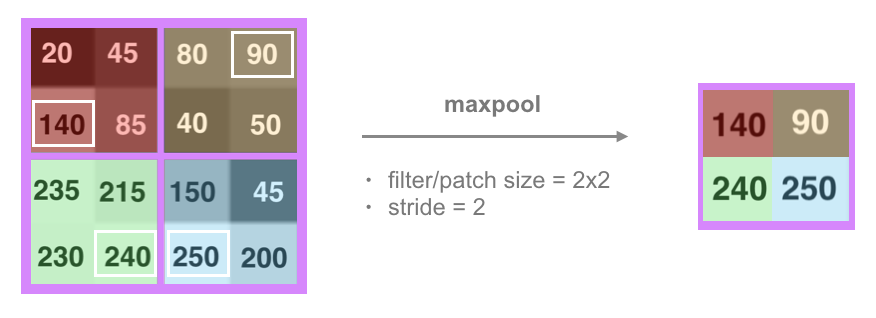

x = F.max_pool2d(x, 2, 2)

x = F.relu(self.conv2(x))

x = F.max_pool2d(x, 2, 2)

x = x.view(-1, 4*4*50)

x = F.relu(self.fc1(x))

x = self.fc2(x)

return F.log_softmax(x, dim=1)

這裡,我們定義了一個class,名字叫Net。

注意: 在模型中必須要定義 forward 函數。而backward 函數(用來計算梯度)會被autograd自動創建。 可以在 forward 函數中使用任何針對 Tensor 的操作。

<<init 部分>>

<<forward 部分>>

圖示如下:

以上為神經網路的定義。

請繼續看下回分解。