昨天的文章中提到了神經網路中很重要的一部分損失函式,相信大部分的人看完我昨天的文章加上下面大神們寫的文章後(大神才是重點),大家都對於在不同的深度學習問題上要利用不同種類的損失函式有一個大概的底了吧,而我寫學習筆記的作風就是在寫完對一個專業名詞相關的介紹後,在能力所及的範圍內寫出一個簡單的實際操作,那麼下面的部分就來進行實作的部分.

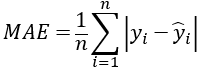

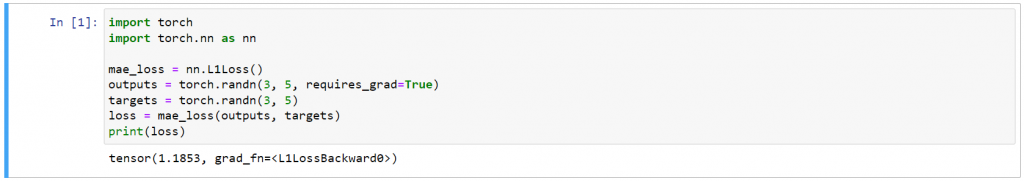

平均絕對誤差(MAE)主要是用於回歸上的損失函式,主要是計算輸出與目標間的絕對值誤差之和,值的範圍會在0至∞之間.

在Jupyter Notebook上實際操作:

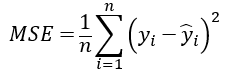

均方誤差(MSE)主要是用於回歸上的損失函式,主要是計算輸出與目標間的誤差平分之和,值的範圍會在0至∞之間.

在Jupyter Notebook上實際操作:

交叉熵損失(CE)主要是用於分類上的損失函式.

在Jupyter Notebook上實際操作:

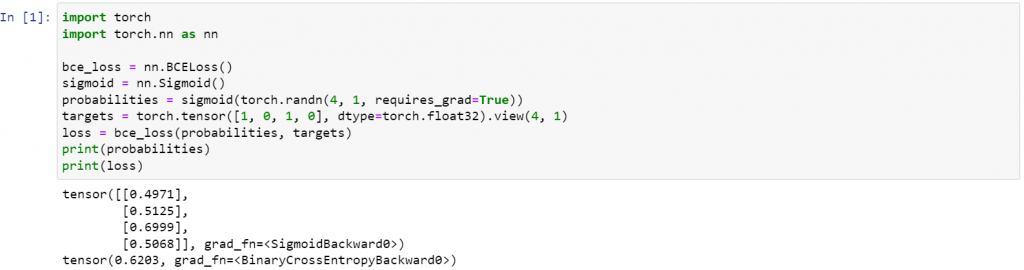

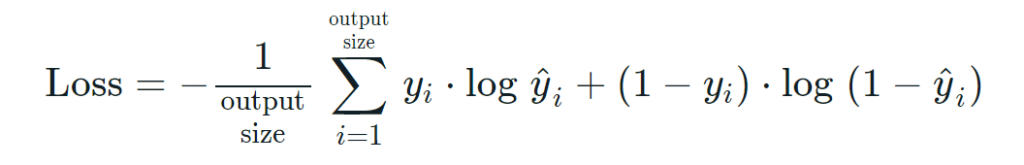

二元交叉熵損失(BCE)主要是用於分類上的損失函式.

在Jupyter Notebook上實際操作: