昨天提及了神經網路,也說到他在人工智慧領域中,類神經網路和深度學習是兩個密切相關且至關重要的概念。今天就會入探討這兩種技術,說明它們的關係,並探討它們在現代AI應用中的重要性。

類神經網路(Neural Networks)是一種模仿人類大腦神經元結構和功能的計算模型。這種模型由多層神經元(也稱為節點或單元)組成,神經元之間通過連結(權重)傳遞訊息。類神經網路可以透過學習數據中的模式和特徵,來完成各種複雜的任務,像是圖片辨識、語音辨識和自然語言處理等。

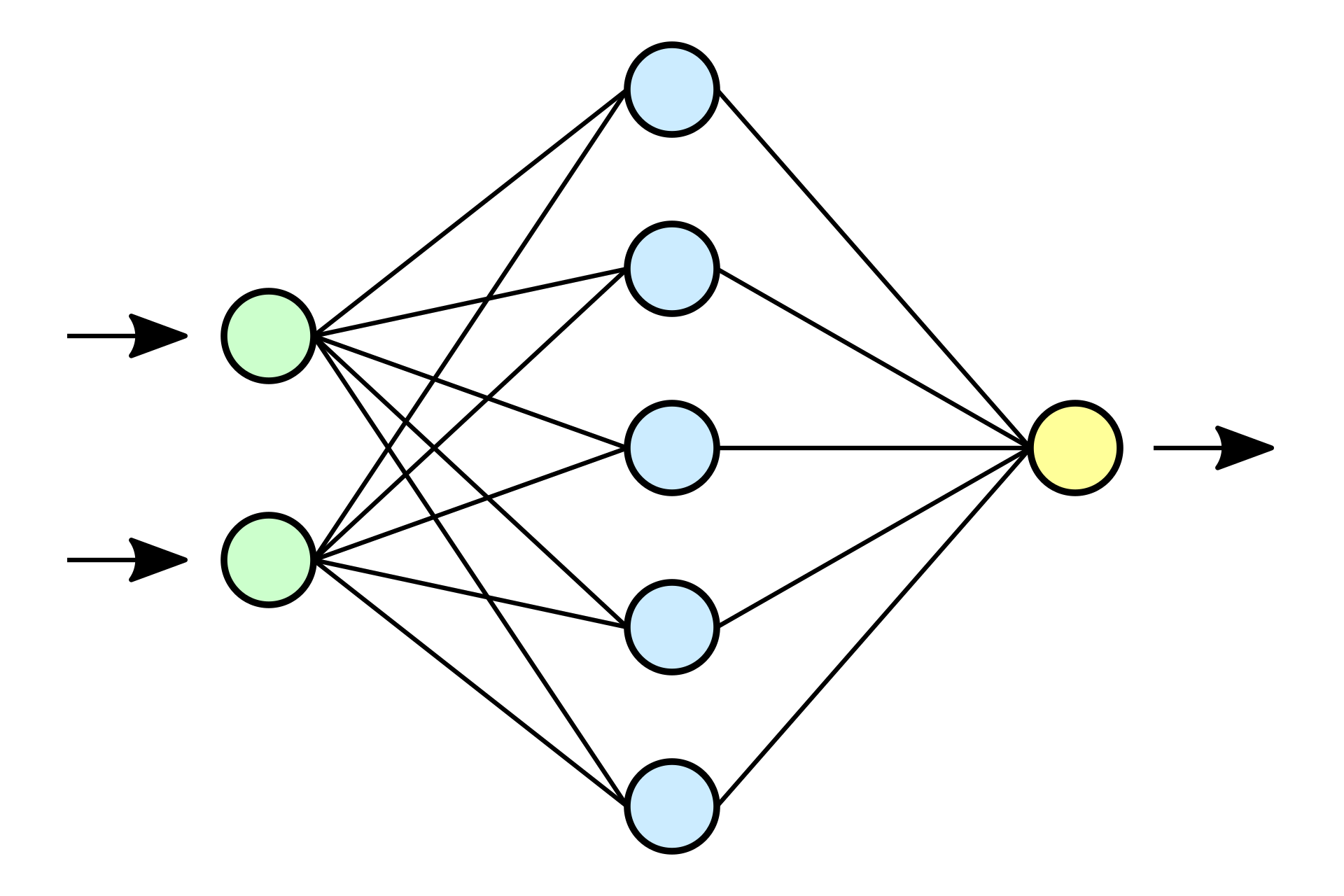

從圖片中,我們可以看到這個神經網路的基本組成部分。這個網路包含三層主要的結構:輸入層、隱藏層與輸出層。

輸入層(Input Layer)

位於最左側的綠色節點代表輸入層,該層負責接收外部數據,並將這些數據傳遞給網路進行處理。每個節點對應到一個輸入變量,這些變量可能是圖片的像素值、文字的特徵或其他可用來訓練模型的數據。輸入層的節點數目通常與數據集的特徵數量一致。

隱藏層(Hidden Layer)

圖片中的藍色節點表示隱藏層,這是一個非常重要的層次。隱藏層負責處理從輸入層接收到的數據,並進行進一步的特徵提取和非線性轉換。隱藏層中的每個節點都會應用一個激活函數(Activation Function),如ReLU或Sigmoid,以確保神經網路能夠學習複雜的模式和關係。

輸出層(Output Layer)

右側的黃色節點代表輸出層,它將隱藏層處理過的數據轉換為最終的結果。輸出層的節點數量取決於具體任務的需求。例如,在分類問題中,輸出層節點數量可能與類別數量相等,而在迴歸問題中,輸出層通常只有一個節點。

類神經網路由三個核心部分組成,這些部分共同決定了網路的功能和學習能力:

結構(Architecture):

形狀:有多少層、每層有多少「神經元」、這些神經元如何相互連接。激活函式(Activation Rule):

學習規則(Learning Rule):

這三個部分緊密配合,使得神經網路能夠學習複雜的模式,如果用簡單的方法去描述這個三部分的話就是:

今天介紹了深度學習中的一個重要概念,類神經網路和深度學習代表了人工智能領域的重要突破。通過模仿人腦的工作方式,這些技術能夠處理複雜的模式識別和決策問題。未來幾天我會繼續深入介紹各個深度學習的方法,希望大家可以繼續閱讀我的文章,一起學習。