本回介紹ControlNet,它是在固定圖片的某個項目去生成新的圖。最常用的是edge to image(邊緣檢測),可以產生人物姿勢與原圖片完全符合的新圖片,這功能的操作如下:

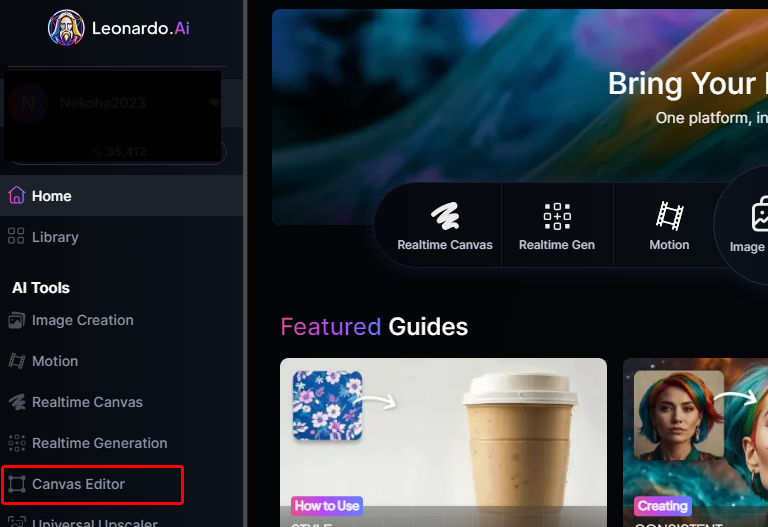

一、主選單選擇ControlNet

二、主介面功能說明

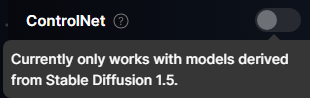

三、要上傳圖片,模型用stable diffusion 1.5才能使用ControlNet

四、選擇img2img

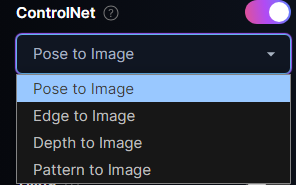

五、確認右邊選單的alchemy功能此時是關閉(切換模型時就會自動調整設定)

六、ControlNet 選單在右下

它有幾個選項:

1、post to image:人物動作近似原圖片(還是有明顯區別)

2、edge to image:人物動作完全符合原圖片,最常用的功能

3、depth to image:模仿原圖的立體深度設定,有時候某些圖片會用得到

4、pattern to image:筆觸模仿原圖片,這個要花時間去跑,本文不介紹這項功能

這張是比較post to image、edge to image與depth to image的不同之處

最常用的功能通常是edge to image,人物姿勢會與原圖完全符合

七、備註

ControlNet weight:ControlNet的權重

Guidance Scale:提示詞的權重

這二個功能都在右下角

結論:本文簡單介紹了ControlNet四個選項的區別,雖然在Leonardo.ai使用有使用模組的限制但卻很有感,特別是真的試出來人物相同動作而畫風不同的圖片的時候,是很有成就感的

也就是說ControlNet搭配提示詞,可以拿照片用AI修圖產生新圖片,甚至可以換成自己風格的圖片,這個功能肯定可以節省不少找人物拍照擺pose的時間,是很常用到的功能。