哈囉大家好,我是橘白卯咪,歡迎大家來看看我能不能撐過30天

我後悔沒存貨的時候參加鐵人賽~

想好好參賽卻事情多又忙到翻~

(請自行配樂without you![]()

忙到翻仍然要發文,努力別斷賽RRR

今天我們繼續尋神之路,來談談行為辨識系統st-gcn的安裝

雖然MMSkeleton是比較新的版本,但我想講他的創始作品

作業系統: windows10

顯示卡: NVIDIA GeForce RTX 2070

CUDA: 最新版,用ToolKit工具安裝

Visual Studio: 2019 professional版

可以看看前面的文~

clone 或下載,請用你熟悉的方式

openpose = '{}/examples/openpose/openpose.bin'.format(self.arg.openpose)openpose = '{}/OpenPoseDemo.exe'.format(self.arg.openpose)parser.add_argument('--openpose'parser.add_argument('--openpose',

default='C:\Users\Documents\GitHub\openpose\build1\x64\Release',

#路徑是OpenPoseDemo存在的位置

help='Path to openpose')

(建議要改,改了命令行就可以不輸入路徑直接默認值)

安裝anaconda我覺得可以視為,因為是windows所以需要的步驟

雖然有些人會覺得它很笨重,但當時一起修類神經的小夥伴,就是有人因為沒裝而發生了奇怪的問題

(啊,雖然裝了還是有問題的也是有...

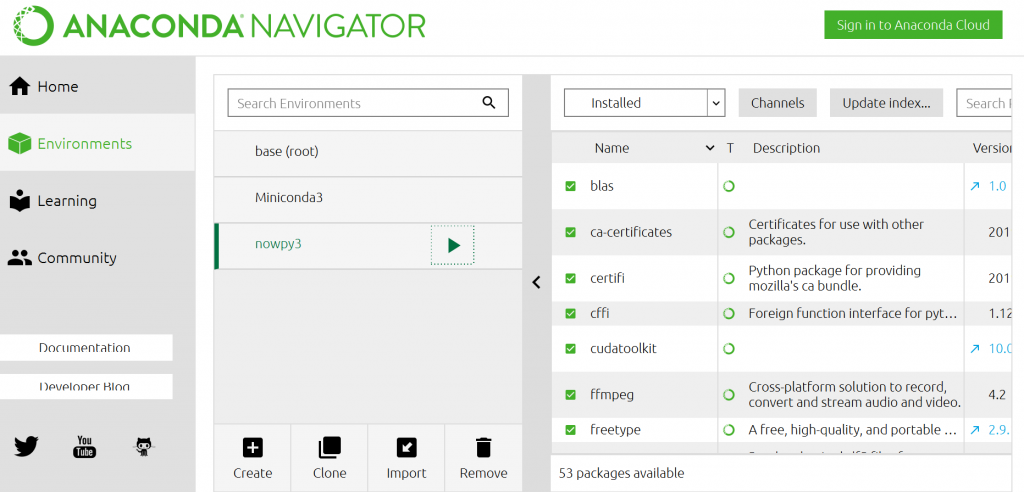

先建個環境叫nowpy3,執行時務必先切到這個環境

執行過程會提示缺少的套件,在anaconda找找裝上就可以了。

比較會有問題的是pytorch和torchvision,可參考windows如何裝這兩個套件的文件。

先切換路徑到專案底下

cd /d C:\Users\Documents\GitHub\st-gcn

執行

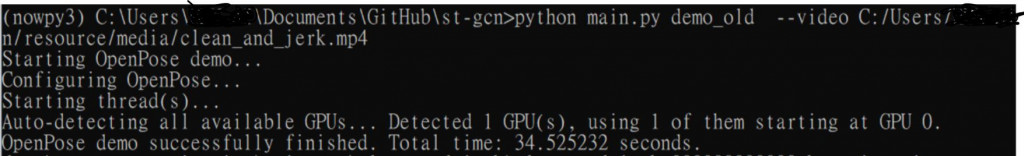

python main.py demo_old --video C:/Users/Documents/GitHub/st-gcn/resource/media/clean_and_jerk.mp4

--video 放要分析影片的路徑,clean_and_jerk.mp4是它原本附的範例檔

整個分析過程請耐心讓他跑...不會太快...

看到這個就代表python的api有跑成功

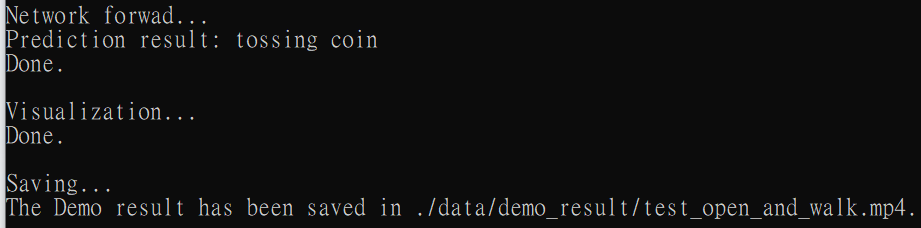

看到這個就代表分析動作的結果生成了

Saving下面有分析結果影片的位置

產出結果影片位置:

C:\Users\Documents\GitHub\st-gcn\data\openpose_estimation\data

各影格人體姿勢json位置:

C:\Users\Documents\GitHub\st-gcn\data\openpose_estimation\snippets

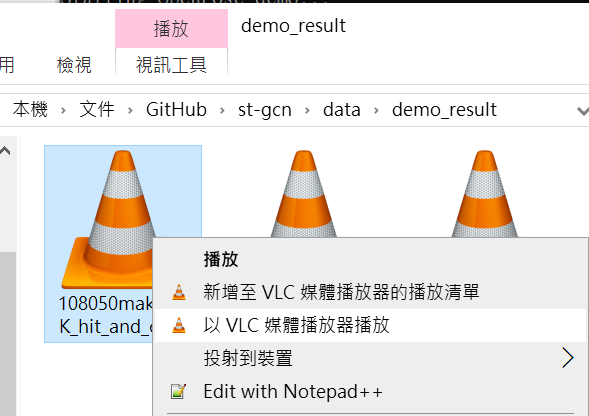

分析結果的影片檔案比較大,使用windows的player打不開,需要右鍵>使用其他媒體播放器

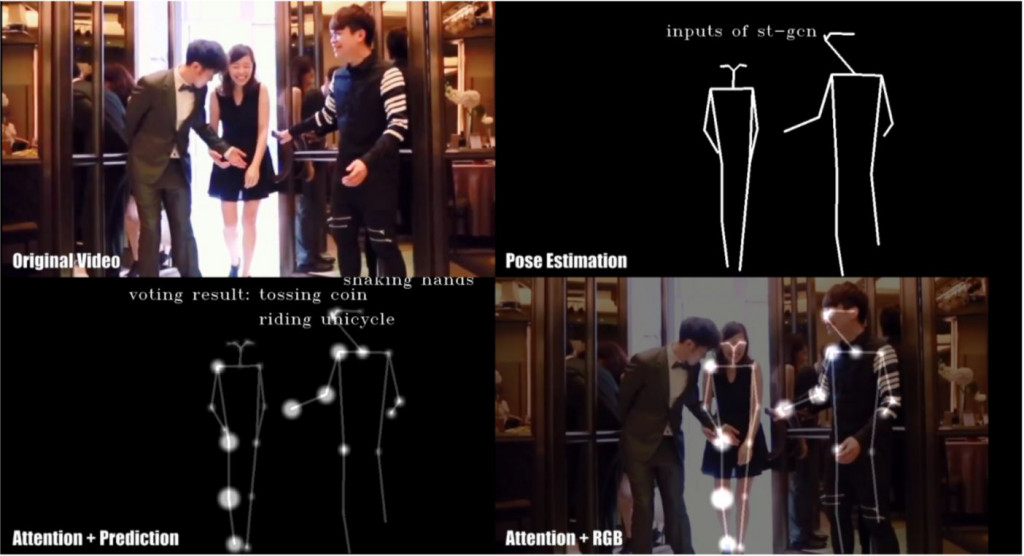

這是一個執行影片的截圖

(youtuber七月半的某支影片

可以從右下方看到,雖然過程有預測人物在做其他動作,但最後只會有一個voting result,也就是人物在做什麼的結論

嗯...雖然結果有點怪...(這部片的人物在走路,但判斷成在擲硬幣

而且也沒有抓到所有人的動作...

不過身為行為辨識系統的開山名作,這樣的結果已經相當不錯

明天讓我們來看看有特定主題的行為辨識系統~~