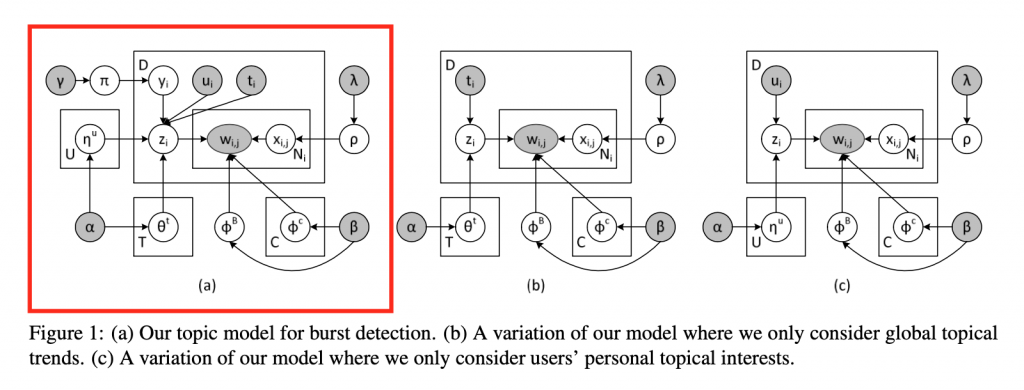

此篇文章提出一個針對時序短網誌改進的 LDA 模型,目的在於偵測網路事件的爆發。相較於經典 LDA,此篇文章的模型引入時間變數,用以模擬在相近時間點出現的文章較有可能是相關文章的性質;也引入作者變數,用以模擬作者發文的偏好:發表個人興趣相關的文章,或者是重大事件的文章。並另外提出兩種簡化版本,作為這兩個設計的效能比較指標。在作者自行收集的 Twitter 資料集上,表現良好。質性分析的結果也顯示,此篇文章提出的模型捕捉的主題內容較為合理,且較為可靠。

ACL 2012

Finding Bursty Topics from Microblogs

https://www.aclweb.org/anthology/P12-1056/

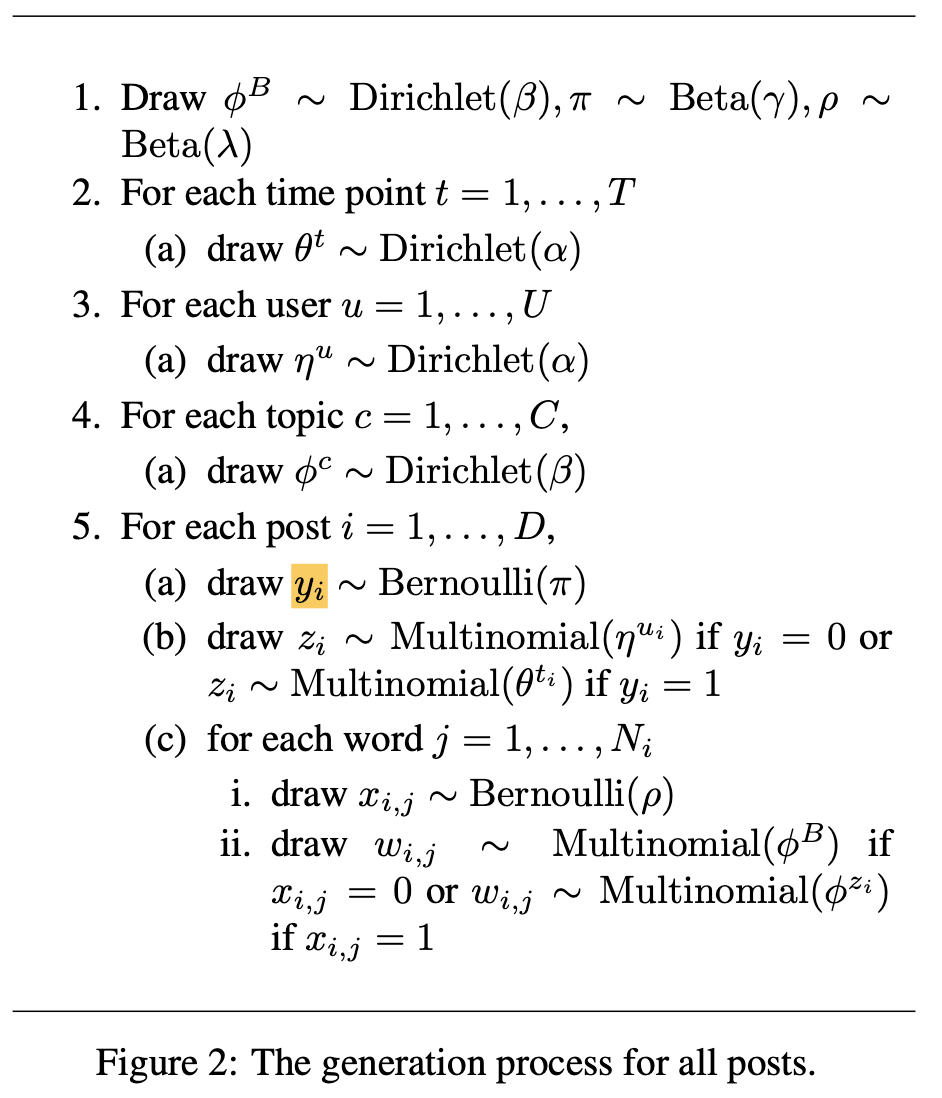

新的模型對於文章的產生與 LDA 稍有不同。

文章構成模型

抽出背景主題的用詞分佈φB、抽出選擇書寫個人生活或重大事件的分佈 π、抽出選擇用背景主題的詞彙或是選擇用事件相關主題的詞彙的分佈 ρ。

對於每個時間點 t ,抽出當時重大事件主題分佈θt。

對於每個使用者 u ,抽出其個人生活主題分佈 ηu。

對於每個主題 c ,抽出其用詞分佈 φc。

對於每篇文章 i

π) 分佈中抽出 yi 選擇以下兩者:

ηui)抽取主題 zi。θti) 抽取主題 zi。j

ρ)決定從哪種主題中抽取詞彙。

φB

φzi

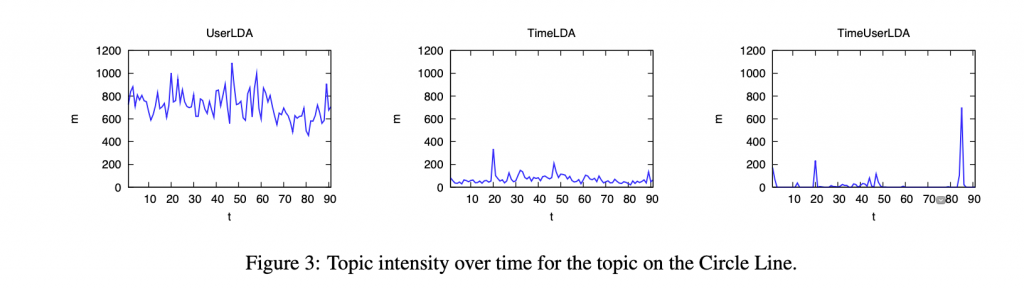

另外提出兩個簡化的版本,分別是只有時間(TimeLDA),另一個是只有作者(UserLDa),則完整版的則是 TimeUserLDA。

事件爆發偵測方法

資料集收集

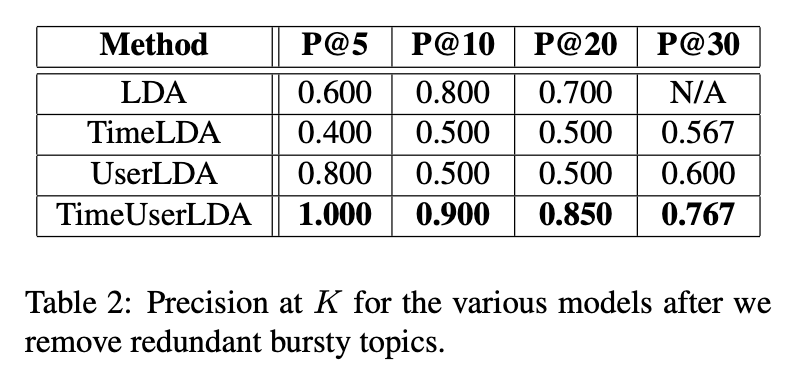

實驗結果:

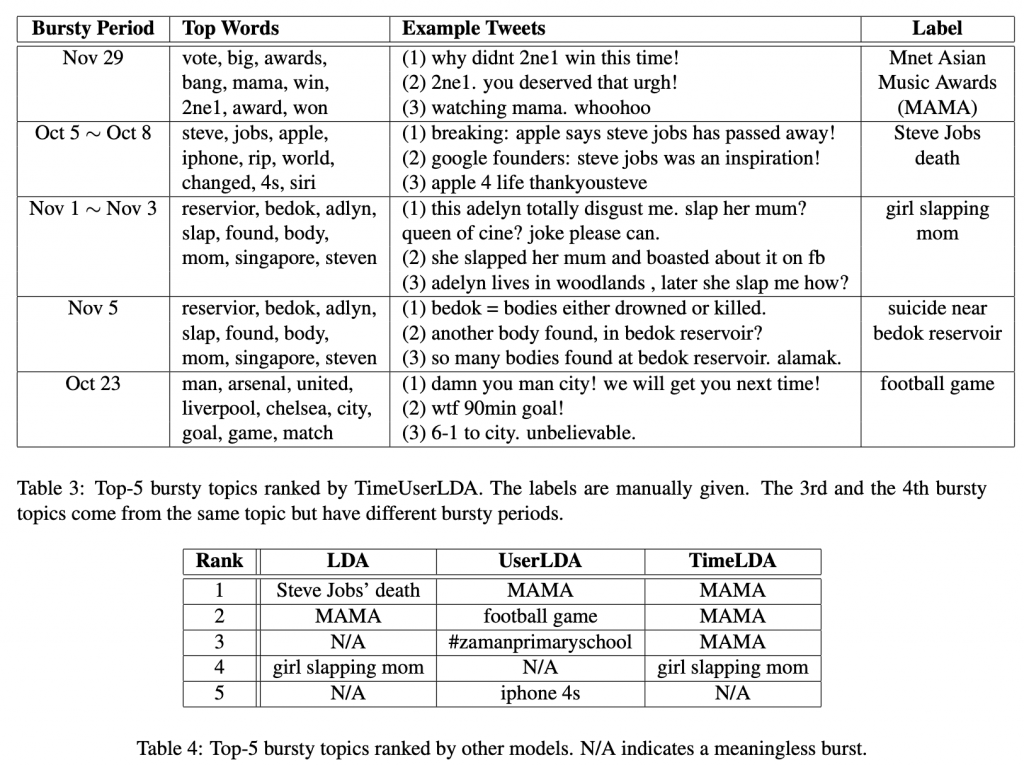

質性分析

未來展望