從前面幾篇的介紹, 我們手動安裝所需要的環境(包含k8s、jupyterhub、MLFlow、Seldon等工具)才能完成training、tracking與serving的任務, 準備這些環境需要整合軟體與硬體,較有經驗的工程師需要至少半天以上才能完成環境設定,較無經驗的工程師單就環境設定可能就需要數個工作天專心設定與測試,整個流程相當繁瑣且耗時.

接下來要說明第四個範例

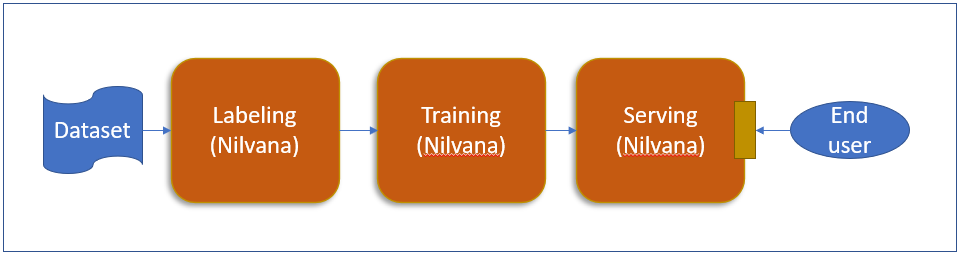

在Day 1的示意圖中提到從training、tracking到serving. 而第四個範例的重點會以電腦視覺中的物件辨識為主題, 因此將會以Labeling、Training到Serving進行說明, 示意圖如下:

我們會使用已整合好且容易上手的Nilvana物件辨識工具, Nilvana的主要功能簡述如下:

因為疫情的關係, 戴口罩已變成現在生活的日常, 現在防疫二級的規定是只要外出就要戴口罩. 因此接下來說明的情境是訓練出一個AI模型來判斷進出者是否有戴口罩, 讓我們可以做好防疫的第一關.

伊甸基金會已釋出口罩臉孔資料庫開放下載, 可以點選這個連結進行下載.

該資料庫是開源資料庫, 資訊如下:

檔案下載下來之後是一個壓縮檔, 解開壓縮檔之後會有兩個目錄

以上說明第四個範例的工具與資料集, 下一篇會說明機器視覺與影像辨識.

Nilvana官網: https://nilvana.tw/

伊甸基金會口罩臉孔資料庫:https://www.facebook.com/chenghsun.tseng/posts/2836741379682495