續上一篇LLM 和機器學習的介紹-Part 3,我們繼續討論一些數據模型(data models)

牛頓冷卻定律 Newton's Law of Cooling

在深入瞭解這個概念之前,我們需要先了解一下熱力學的第一和第二定律。

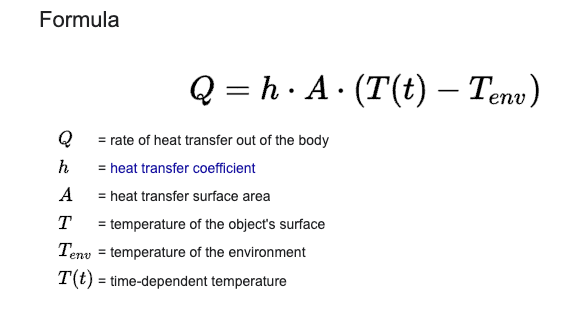

牛頓的冷卻定律指出,物體與其周圍的熱交換速率與物體與周圍溫度之差成正比。數學上表示為:

我覺得這模型看似沒有多大的套用的用處,但如果可以好好的看著些方程式是如何分析以及預測溫度降溫的速度的話,再看其他數據建模時會比較容易理解。

參考資料:https://personal.math.ubc.ca/~CLP/CLP1/clp_1_dc/sec_newtonCooling.html

線性回歸 Linear Regression

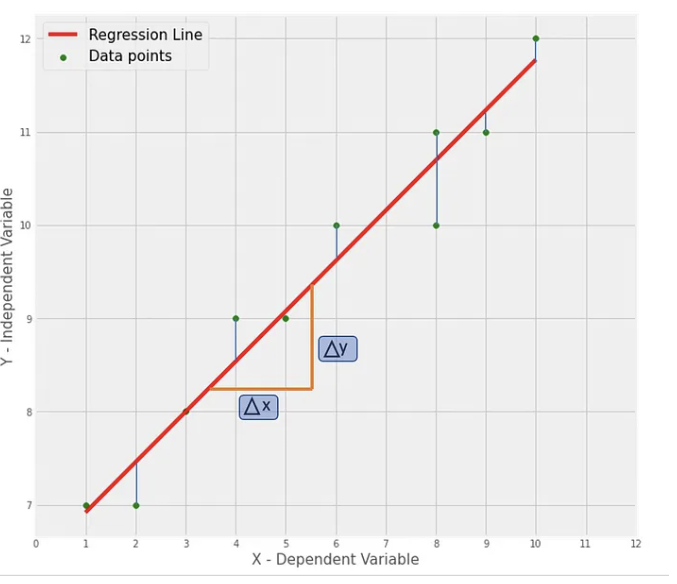

這是最常見的模型,用變數x的值來預測y的值。被預測的y值也被稱為是“依賴變數”。

你用來預測其他數值的x變數則是稱為獨立變數。

線性回歸是找到最適合數據點的線的過程,以便我們可以使用它來預測在我們的數據集中不存在的輸入的輸出值,我們相信這些輸出將落在線上。

你看到的線稱為“最適合的線”。也稱為“普通最小二乘回歸”。這只是意味著我們使用了最小的平方誤差。誤差是預測的y值減去實際y值。差異是平方的,因此有一個絕對的差異,然後求和。

'''error = y_actual - y_predicted'''

這模型適合用於當你猜測有個變數x 可預測y數值。

例如: 客人的心情(y)以及他們在線等待客服的時間(x)。

參考資料:https://towardsdatascience.com/linear-regression-explained-1b36f97b7572

我們在下一篇繼續討論不同的數據模型。

對 dbt 或 data 有興趣?歡迎加入 dbt community 到 #local-taipei 找我們,也有實體 Meetup 請到 dbt Taipei Meetup 報名參加

Ref:

https://levelup.gitconnected.com/20-pandas-functions-for-80-of-your-data-science-tasks-b610c8bfe63c