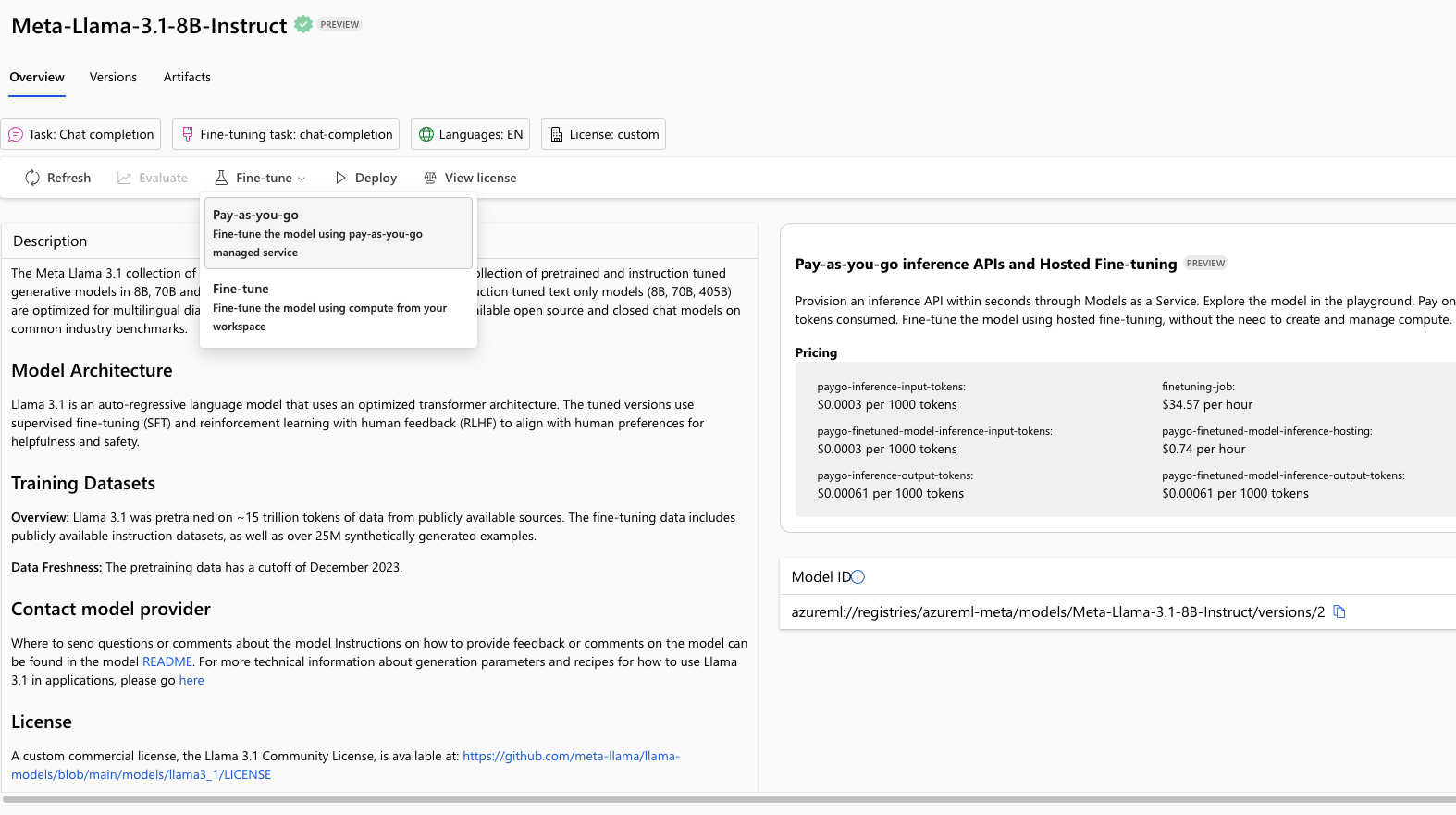

今天就要來 Fine Tune 了。需要注意的是,不是每個 workspace 所在的區域都有 Fine Tune 的。舉例來說,我們這個範例所在的 westus3,可以 Fine Tune Llama,但是不能 Fine Tune Phi3.5。想要 Fine Tune Phi-3.5 的話,就要開到 eastus2 才可以。

我們可以看到價格部份:

每小時 $34.57,用於進行模型的 Fine Tune。

推理成本(輸入和輸出 tokens):

預訓練模型和微調模型的輸入 token 成本一樣,都是 $0.0003 per 1000 tokens。

輸出 token 的成本也相同,為 $0.00061 per 1000 tokens。

值得注意的是,還有一筆微調模型的托管費用:

如果使用微調過的模型進行推理,還需要支付每小時 $0.74 的托管費用,以確保模型可以被隨時使用。

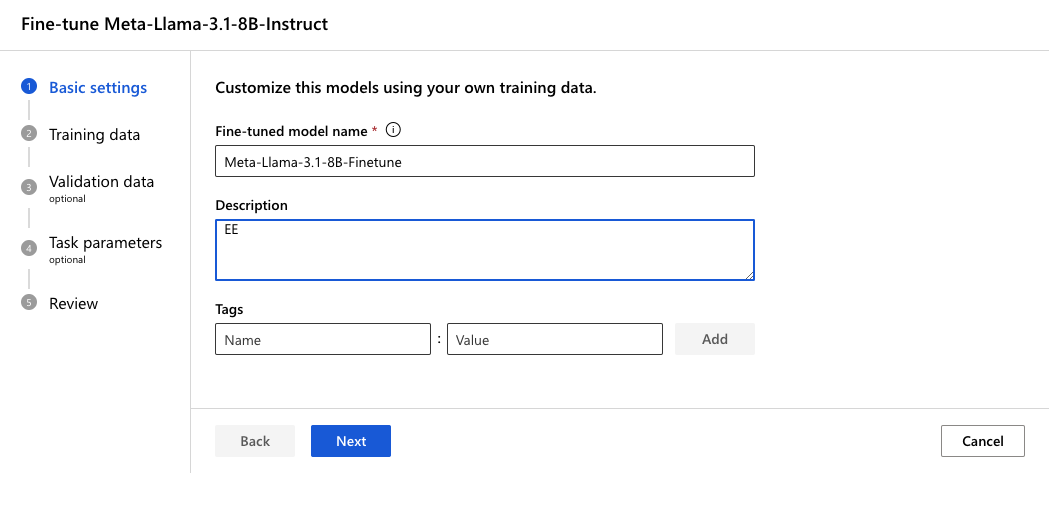

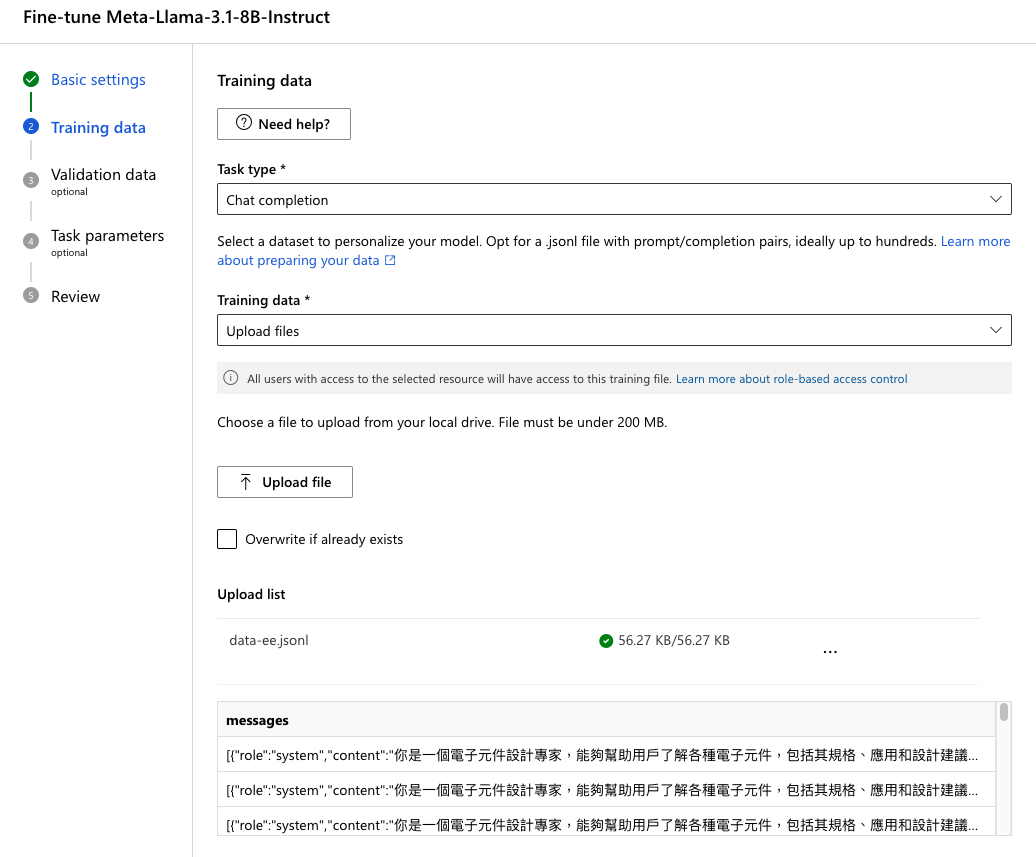

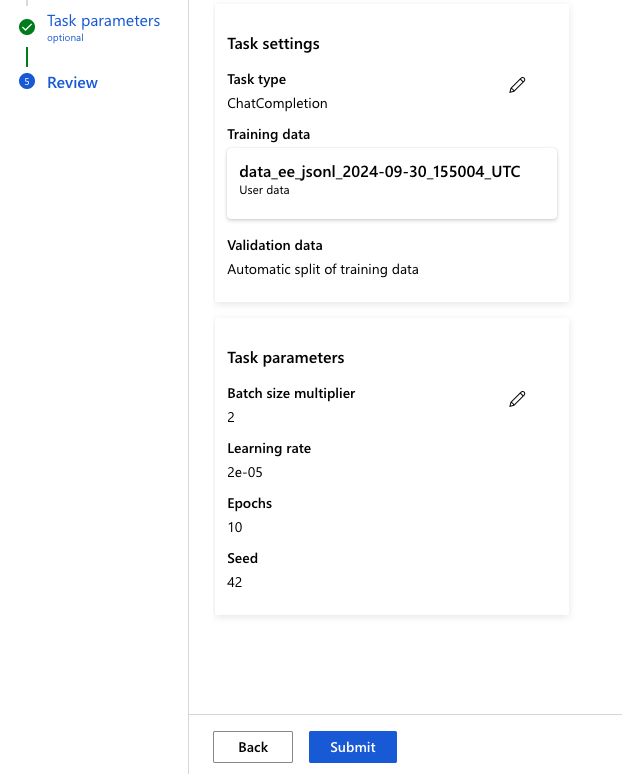

送出 fine tune 後,這裡我們會等上數個小時,明天我們再來玩他吧!