在昨天談完Day13-IBOutlet及IBAction後 , 今天我們來玩一些在App裡會用到的講話SDK,

相關元件在Day10-iOS 12 SDK--Part2有稍微介紹過 , 今天我們會運用相關SDK製作一個

會講話的App(也可以做出康是美--店家外面放的--大聲公App,再串接藍牙喇叭) , 在小編

上班到處跑客戶推廣微軟Azure公用雲時,曾想過為什麼這麼多家公有雲

(AWS / Azure / GCP....),谷阿莫有講過蘋果新產品發表會,居然沒介紹過公有雲

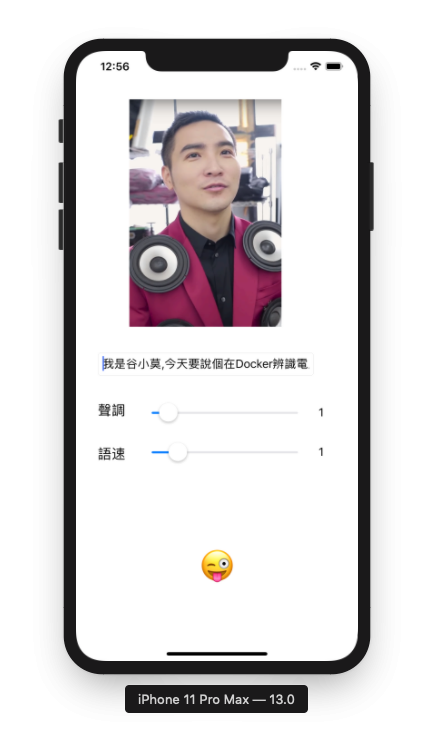

剛好我們在研究AVFoundation,AVSpeechUtterance.. ,就可以用Xcode請谷阿莫

的分身(谷小莫)來幫我們快講一下微軟Azure新技術

(⋯⋯其實我們比較想聽新電影介紹)![]()

實做方法 :

1.建立新專案

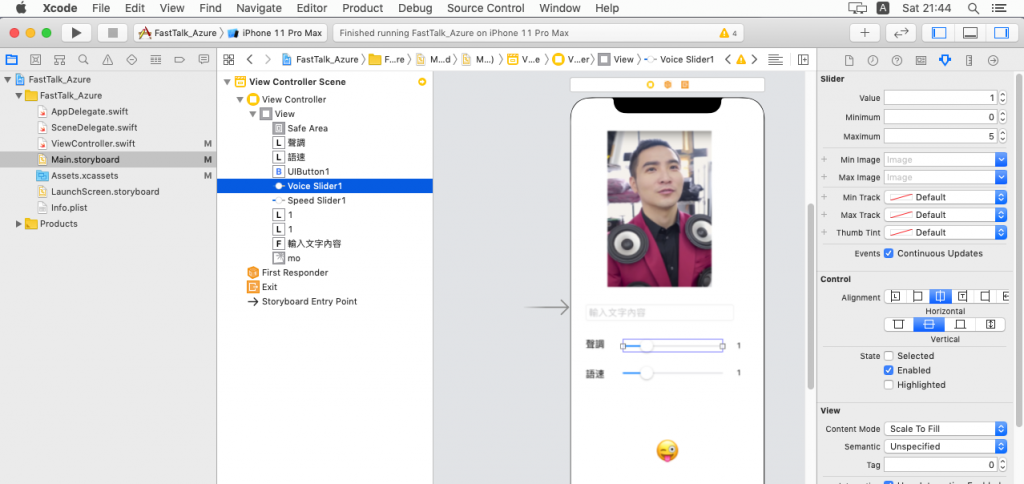

2.按+新增Button,Slider(設定最小及最大值)

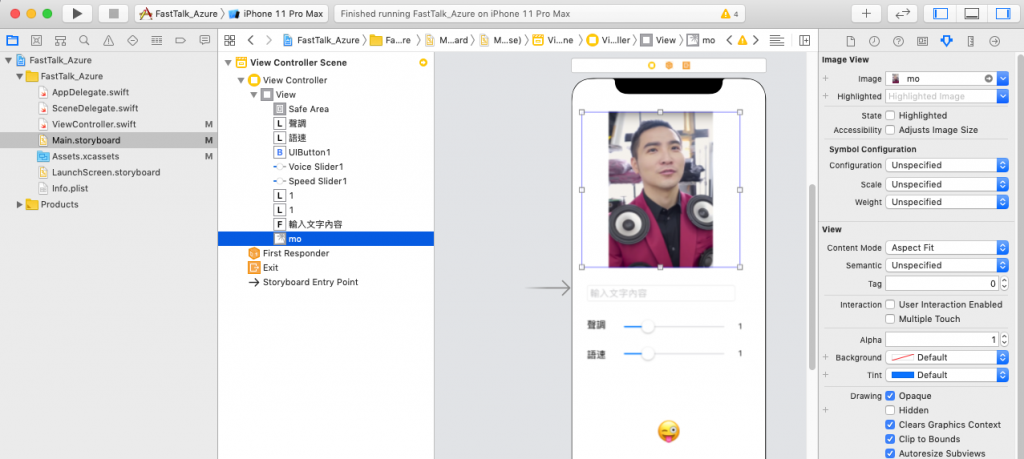

3.按+新增Label,UIImageView,Text Field...

4.拉IBOutlet,IBAction

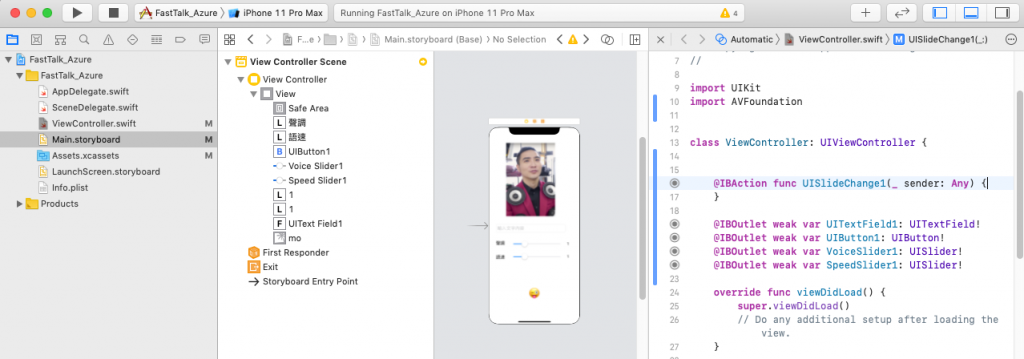

5.Import AVFoundation及相關元件程式碼

import UIKit

import AVFoundation

class ViewController: UIViewController {

@IBAction func UISlideChange1(_ sender: Any) {

}

@IBOutlet weak var UITextField1: UITextField!

@IBOutlet weak var UIButton1: UIButton!

@IBOutlet weak var VoiceSlider1: UISlider!

@IBOutlet weak var SpeedSlider1: UISlider!

override func viewDidLoad() {

super.viewDidLoad()

}

@IBAction func ButtonAction1(_ sender: Any) {

let speechUtterance = AVSpeechUtterance(string: UITextField1.text!)

let synthesizer = AVSpeechSynthesizer()

speechUtterance.voice = AVSpeechSynthesisVoice(language: "zh-TW")

speechUtterance.pitchMultiplier = VoiceSlider1.value

speechUtterance.rate = SpeedSlider1.value

synthesizer.speak(speechUtterance)

}

}

6.執行程式,點選iPhone 11 Pro Max的Slider調整聲調及速度,聽谷小莫講Azure