LSTM 與GRU

兩者都是為了解決梯度消失而誕生的RNN變種。

LSTM (Long Short-Term Memory , 長短期記憶)

一種時間循環神經網路,適合用於處理和預測時間序列中間隔和延遲非常長等問題。也常見用於自主語音辨識。其最主要有三個門。

忘記階段) : 決定這次的輸出是否需要被記憶,或是要記多少。選擇記憶階段) : 將這個階段的輸入有選擇性地進行記憶。

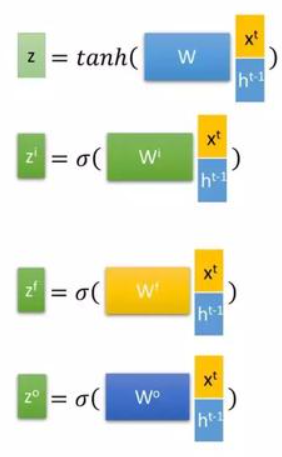

GRU (Gate Recurrent Unit , 門控循環單元)

有兩個門,GRU透過兩個門之間的線性彎曲來產生隱藏狀態,使得GRU的隱藏狀態與歷史資訊之間也變成線性關係,從而避免梯度消失的問題。

重製門 : 決定是否要在遺忘前留下隱藏狀態。

更新門 : 決定這次的隱藏狀態所要留下的比例。