神經網路(Neural Networks)是一種受人類大腦結構啟發的機器學習模型,已經在各個領域展現了驚人的應用價值。本文將深入探討幾種常見的神經網路類型,包括全連接神經網路、捲積神經網路、遞歸神經網路和自我組織映射,並闡述它們的特點與應用場景。

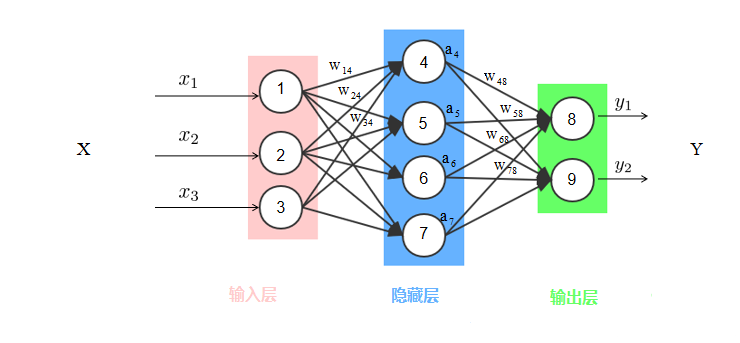

全連接神經網路,亦稱為多層感知器(Multilayer Perceptron, MLP),是最基本的神經網路模型之一。在FCNN中,每個神經元與前一層的所有神經元均有連接,這些連接通過權重進行調整。全連接神經網路通常由多個隱藏層組成,每個隱藏層包含若干神經元,最終通過輸出層生成結果。

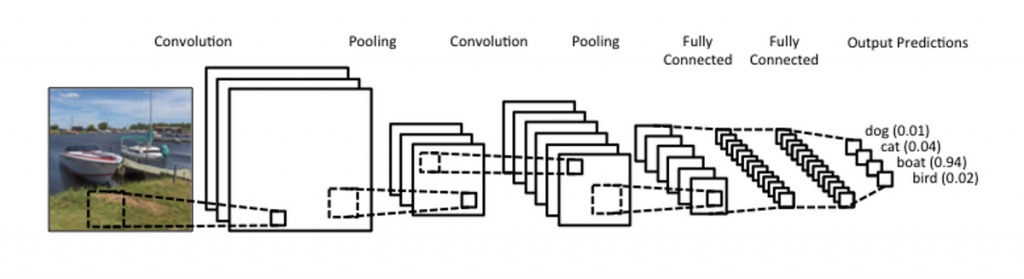

捲積神經網路專門用於處理圖像和視覺數據。它通過對圖像進行卷積操作來提取局部特徵,並通過池化層(Pooling Layer)降低特徵圖的維度。CNN通常由卷積層、池化層和全連接層組成,能夠有效地處理具有空間結構的數據。

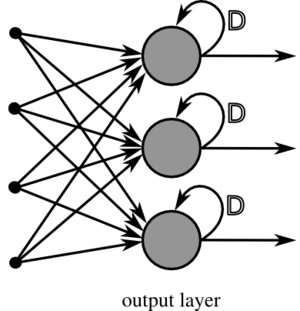

遞歸神經網路專門設計來處理序列數據,例如語言、時間序列等。RNN在序列上循環應用相同的神經網路單元,從而捕捉序列之間的依賴關係。其變體LSTM(長短期記憶)和GRU(門控循環單元)更進一步加強了對長期依賴的捕捉能力。

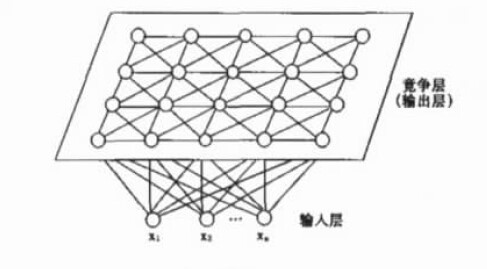

自我組織映射是一種無監督學習模型,用於聚類和可視化高維數據。SOM通過將高維數據映射到低維空間的網格結構中,自組織地使相似數據點彼此靠近,從而揭示數據的內在結構。

不同類型的神經網路在各自的應用場景中發揮著至關重要的作用,各具優勢。隨著深度學習技術的飛速發展,神經網路模型的應用範圍將更加廣泛,並對人類生活與工作的方方面面產生更深遠的影響。