在Jetson Orin Nano 上如何安裝 Ollama 來執行 Gemma3 4b 的模型和效果如何

環境:

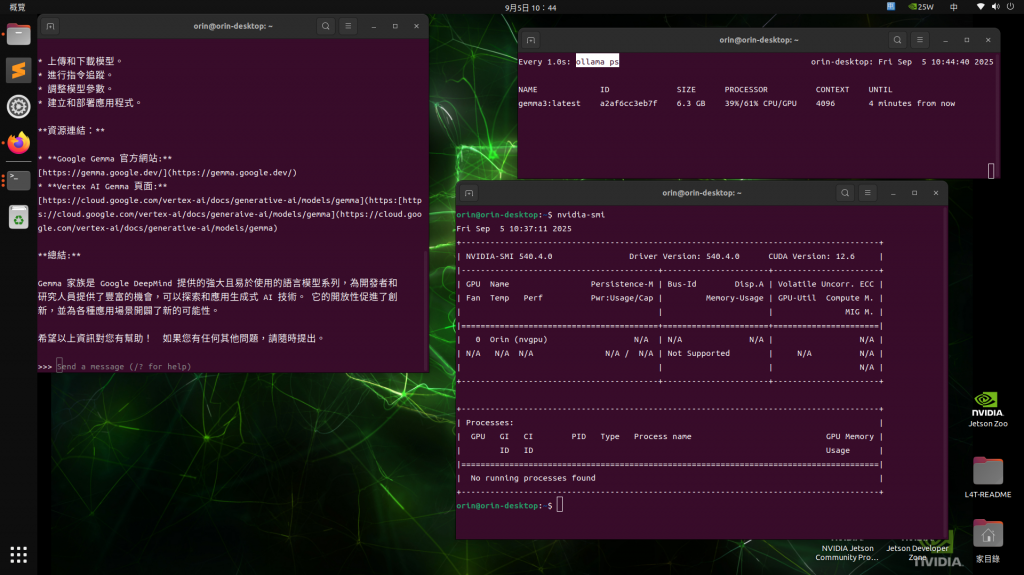

電腦:Jetson Orin Nano 8G

模型:Gemma3 4b

先到 https://ollama.com/ 官網

選Linux

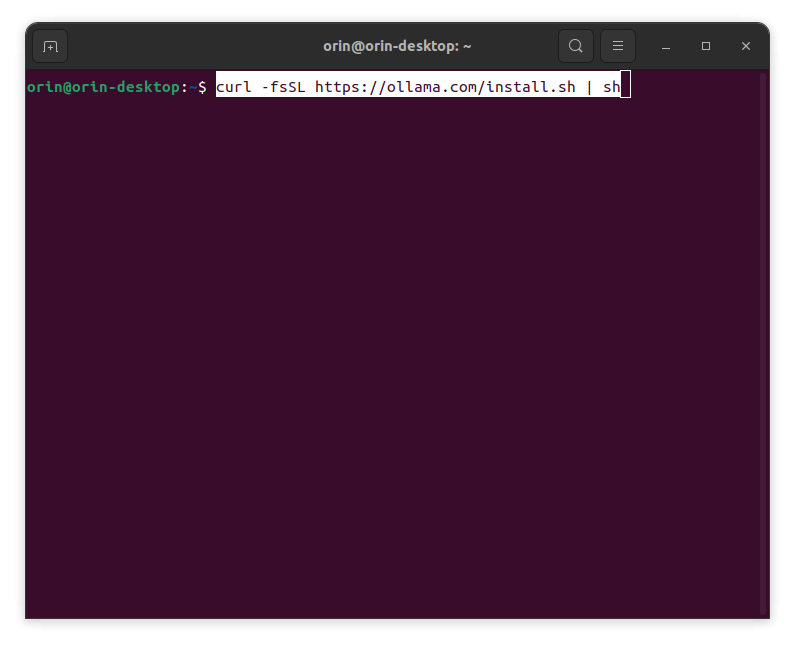

用Command Line 安裝 Ollama

curl -fsSL https://ollama.com/install.sh | sh

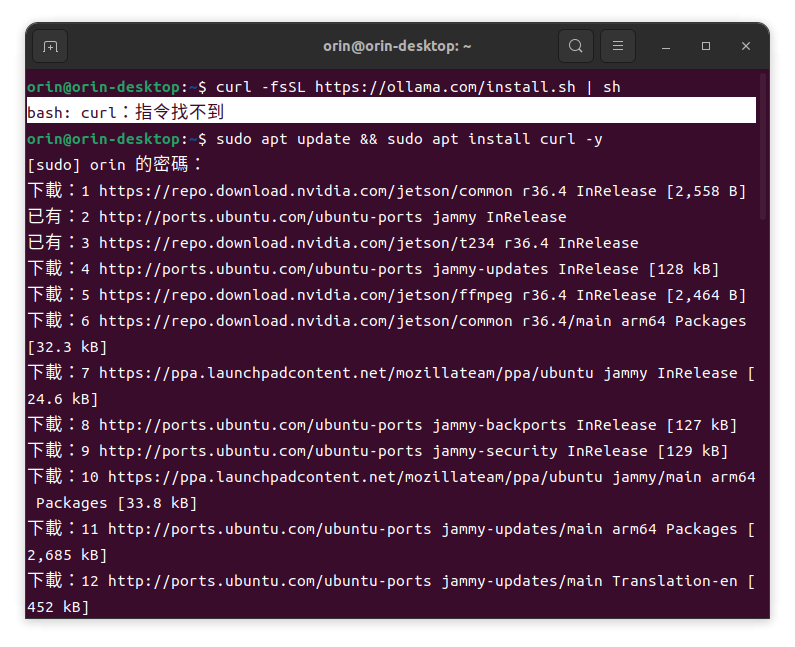

如果沒有curl 請下

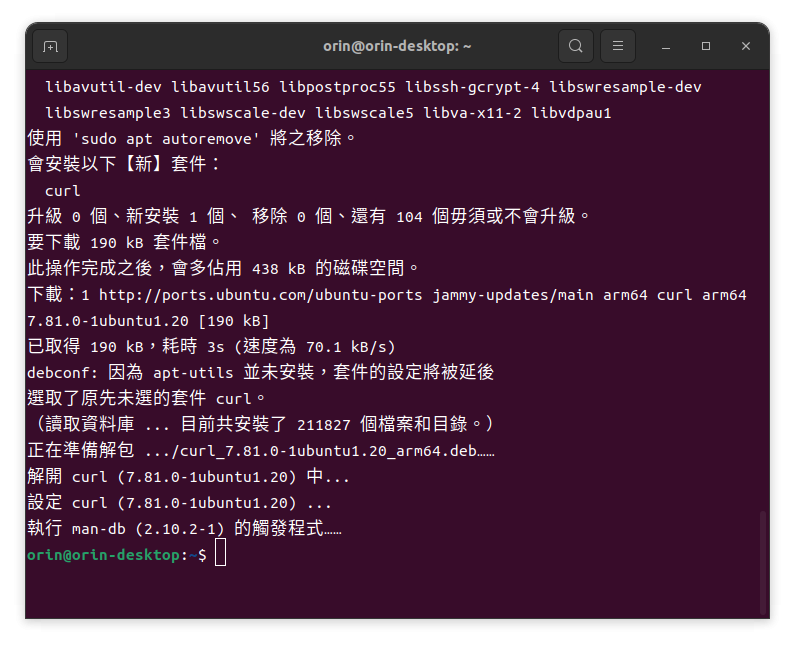

sudo apt update && sudo apt install curl -y

再執行一次

curl -fsSL https://ollama.com/install.sh | sh

就完成安裝Ollama

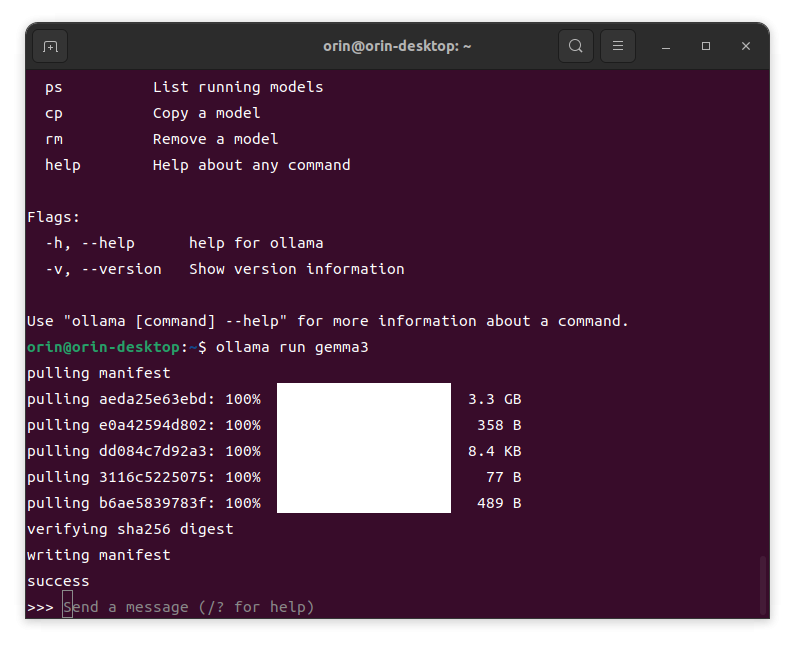

在終端機執行下列指令來執行 Gemma3 4b

ollama run gemma3

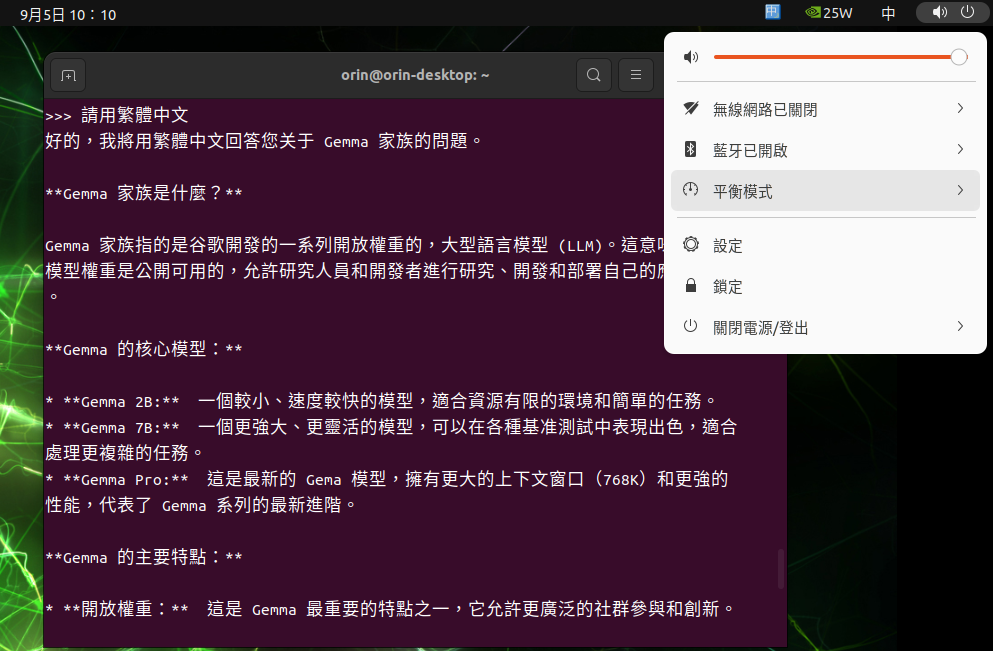

無使用網路,純本機執行

手邊剛好有 Jetson Orin Nano 就來試試嘍

這個應該是尖端邊緣運算的一個實踐。透過 Ollama,在像 Jetson Orin Nano 這樣的輕量級平台上實現強大的離線 AI 能力,已經是很方便的事了。