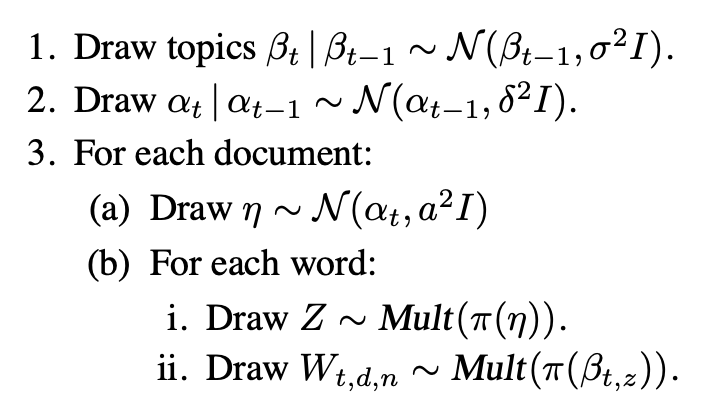

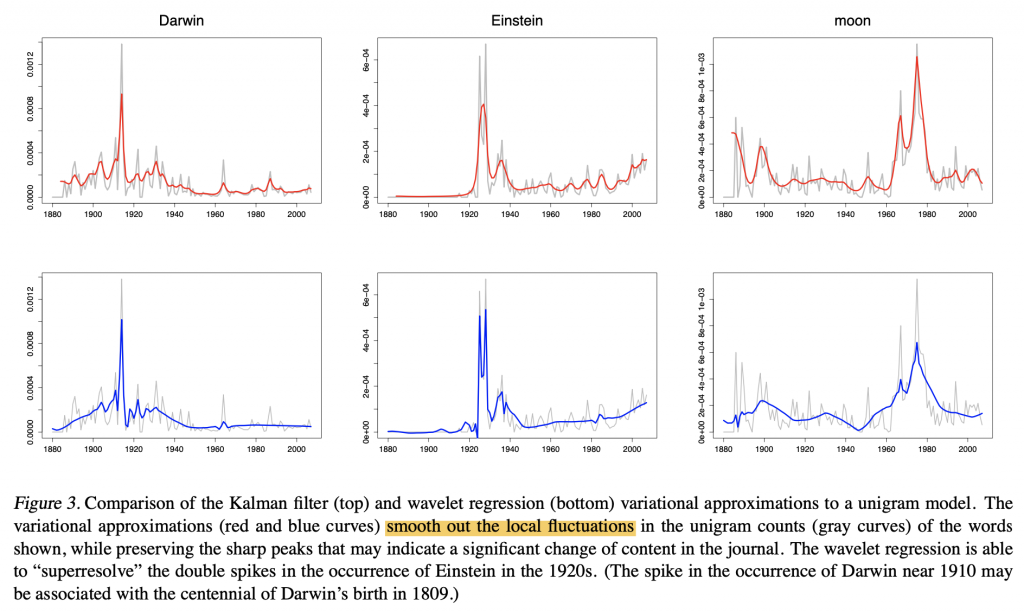

本文引入了時間的概念,讓 LDA 的每個參數會依照前一個時間點的參數做變化。變化的情況,用 Logistic Normal Distribution 模擬。由於 Logistic Normal 與 multinomial 並非共軛,所以只能用近似的算法,作者推導出一個變分形式,並用 Kalman filter 與 wavelet regression 兩種方法近似。其結果顯示在質性上結果相當不錯,呈現出同主題的幾年間的內容變化,並且在預測下一年的文章的任務上表現佳。

[未完待續]