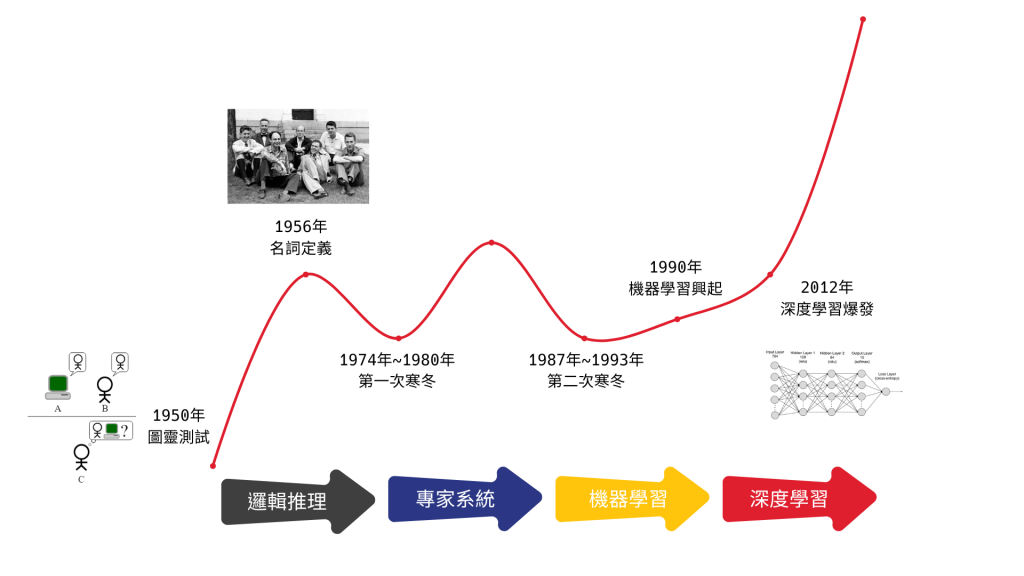

人工智慧這個名詞在近十年很常聽到,其實早在1956年達特矛斯會議就定義了「人工智慧」這名詞,但是人工智慧並不是一路順遂,在1974年~1980年和1987年~1993年經歷了兩次寒冬(簡單來說因為當時AI解決任務的能力不夠好導致資金的投入大量減少)。

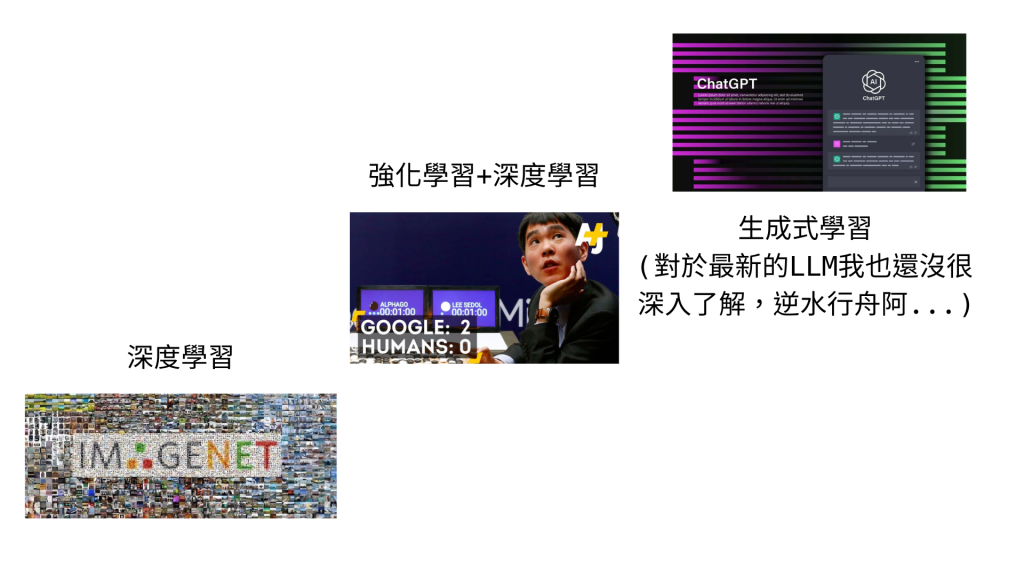

2012年的「ImageNet」年度挑戰開啟了這一輪AI復興浪潮(ImageNet挑戰是每年一度的機器視覺比賽),這歸功於大數據(網路、感測器等數位資訊的收集)、硬體效能的快速提升(NVIDIA 開發 CUDA更方便控制GPU的矩陣運算)。

人工智慧如字面來說就是人類創造具有智慧的機器,實現AI有很多方法(專家系統、知識表示、機器學習等等),機器學習的是讓機器輸入數據(圖片、對話等)獲得知識,從而讓機器自動地去判斷和輸(預測人流、與你對話、判斷是什麼動物等)。

機器學習包含很多種演算法、人工神經網絡、決策樹、支援向量機、高斯回歸過程、聚類、馬爾可夫鏈等。

深度學習就是比較多層的神經網路,因為堆疊很深的層數,因此又命名為深度學習。之前在論壇看到各大學者討論這個用詞,我自己歸納的結果就是要用一個很酷炫的名字來包裝,如同前面提到的,人工智慧可是經歷了好幾次寒冬,如果又用這個名詞可能拿不到經費吧!

其實我對於最近很紅的生成式學習也還沒深入理解,但是可以發現許多舊有的技術融入在內,例如強化學習(機器自己與環境學習而達到目標)、對抗生成網路、自注意力機制等,跟著看完這系列文章,即使未來還是會有很多新的名詞出現,但是根據內化的知是要快速學習新的技術是相對容易很多的。

講了兩天的幹話動機和介紹,明天會開始分享技術,還沒安裝PYTHON和開發環境的可以趁現在安裝哦!

https://peterknockcode.com/python_tutorial_ch0/

有任何問題歡迎底下留言或到IG私訊我,各位的問題都會是我成長的因子XD

https://www.instagram.com/peter_knock_code/![]()