前兩天先把原本的關鍵字評分換成模型,再加強一下,讓模型可以說出他對這個結果有多有信心,以及解釋是怎麼評分的,但因為都是另外跑的,還沒有接回我原本的情緒日記網站。

所以今天的目標就是要把模型放上雲端且接回情緒日記!

一開始我嘗試把情緒模型丟到 Render,結果碰到一個很硬的限制:

免費方案記憶體只有 512MB,每次模型一載入就直接 OOM(Out of Memory),服務根本啟不動![]()

我試了各種方法壓縮、調參,甚至只開單 worker,還是會在載模型的瞬間爆掉。這讓我意識到,Render 免費方案根本撐不住 NLP 模型,而我錢包空空不想付錢

最後我決定直接搬到 Hugging Face Spaces(Docker Runtime),好處是:

搬到 Hugging Face Docker 之後就順了許多;載入不再爆記憶體,前端打 API 也單純,終於能好好睡一覺(部署那天真的被來回修到崩潰 QQ)

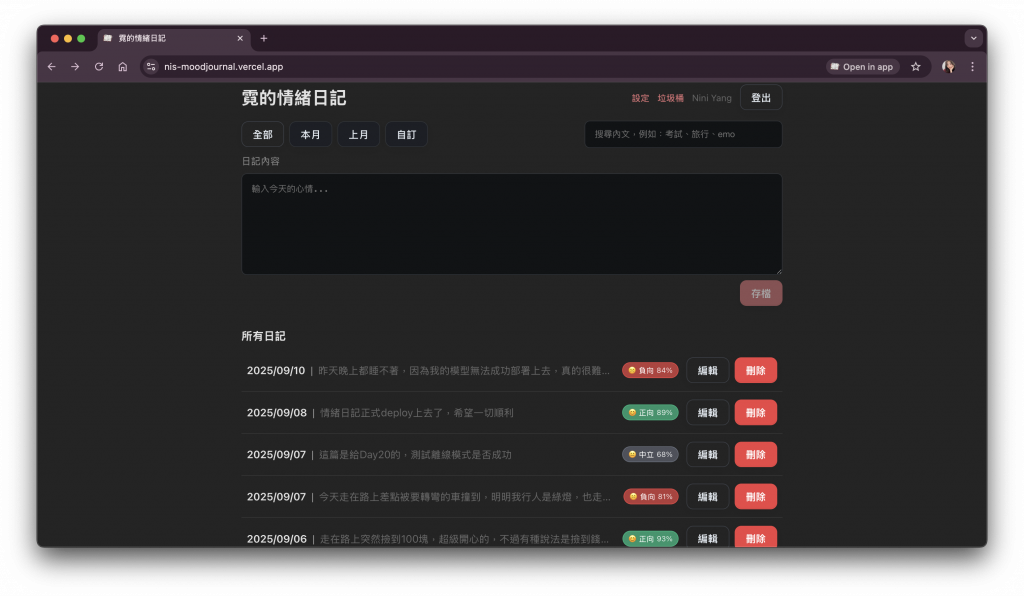

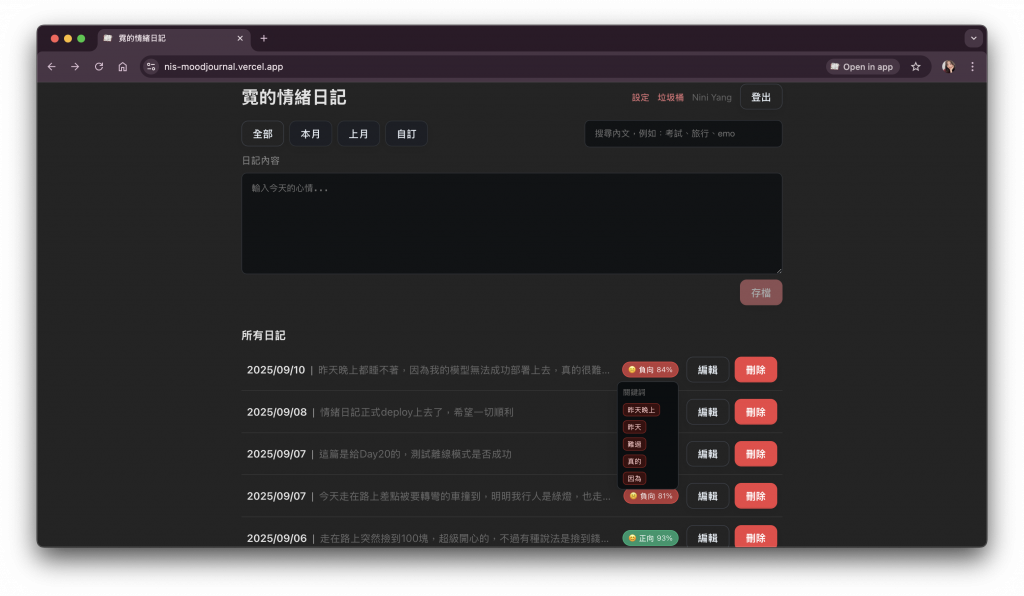

前端日記清單上,原本只有一個單色的情緒標籤。現在我加上:

百分比數字:直接看到信心,例如「負向 84%」

顏色深淺:信心高的標籤更飽和

關鍵詞標籤:小圓角 Tag,hover 可以看到貢獻度

整體感覺比之前「黑箱判斷」更透明。

今天算是一個重要的里程碑:不只是讓情緒模型「能跑」,而是「能解釋」,而且還能 在 Hugging Face 上用 Docker 部署,讓它像一個正式的雲端服務一樣穩定運行。也會顯示關鍵字讓使用者知道模型是根據什麼判定的(但其實我還是覺得很多時候它很不準,真的不知道是模型太笨還是我太笨,我會再慢慢嘗試調整模型![]() )

)

明天要來做語音輸入,不改後端、不碰模型,單純把日記頁加一顆麥克風按鈕。按下去就用瀏覽器的 Web Speech API(先鎖 zh-TW)開始聽,畫面顯示「錄音中」的小動態;放開就把逐字稿直接塞進輸入框(先不自動儲存,避免亂沖內容)。情緒分析的串接等 Day 26 之後再來~