今天要來學習一下分類很常用的一種方法支撐向量機(Support Vector Machines : SVM),不可避免必需來學習一下數學有點像以前學過的線性規劃,這裡有MIT的開放式課程上課內容可以來上一堂課順便練習英文XD,不過相信大家很快就睡著。現在是個速食的世界人類的專注力只有十分鐘,十分鐘就要讓觀眾把重點帶走,這是當一個網紅基本條件!!!因此今天還是稍微解釋一下支撐向量機(SVM)到底在支什麼@@

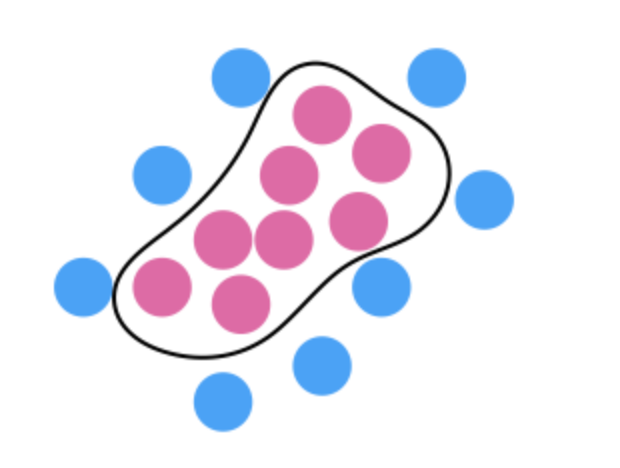

如下圖假設今天有兩顏色的點位需要分類先擺上任一條線都可以區分開

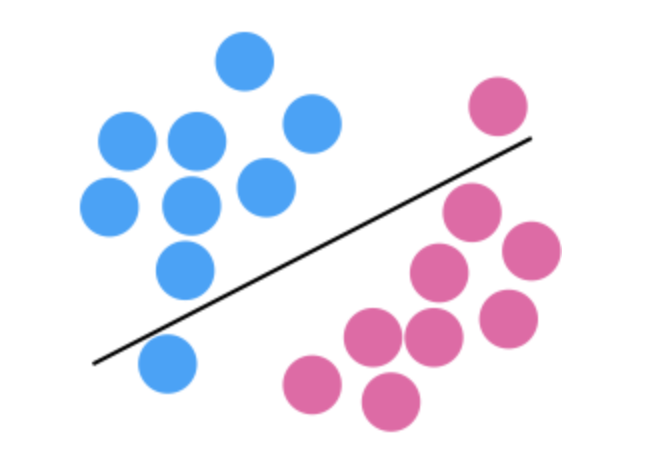

但今天如果加上一些點位就可能會分錯,這條線應該能再擺得更好

因此我們希望這條線能長這樣,以至於未來還有新增的點位能分在對的地方

十年後你還記得Log是什麼嗎..唸理工的當然還記得啊Orz

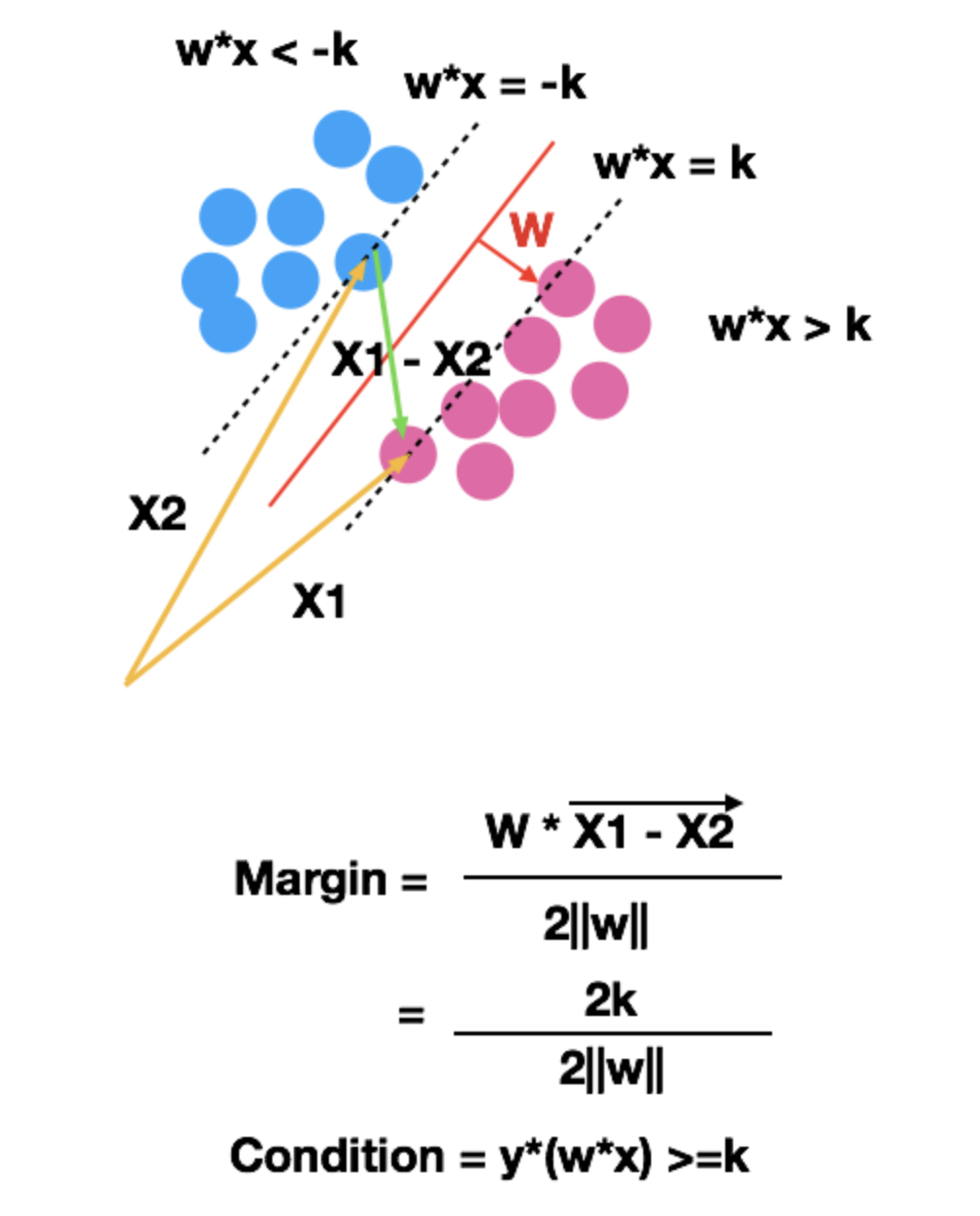

用高中的二維向量投影解釋一下,如下圖 (X1-X2)W/|W| 就是兩虛線之間的寬度,這邊Margin就再除2。第一個條件就是希望這個Margin能有最大值,第二個條件就是希望這一刀切下去後藍色與紅色點位不會被切錯邊,定義藍色點位的yi值為-1紅色點位的yi值為+1因此我們有每個點位的條件都要符合yi(w*xi)>=k。 (註:w*x=k -> ax+by=k)上述兩個條件都要符合的解就要用Lagrange Multiplier Method來求得。這邊就解釋到這...有興趣再詳細看一下分享的連結

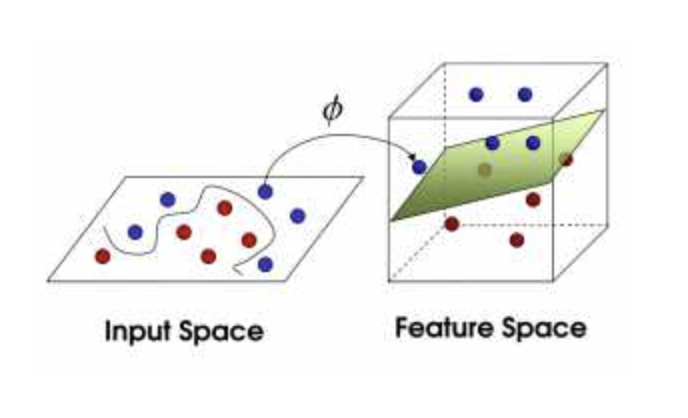

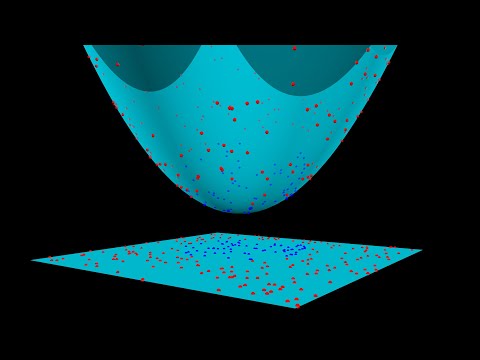

萬一遇到奇形怪狀的分佈圖怎麼辦,可以用複雜一點的多項式來讓它映射到更高維度空間再來區分

這邊展示利用多項式來分割的例子

今天光是理解就耗掉很多養份,明天再來學習用SVM來區分Iris資料集~![]()