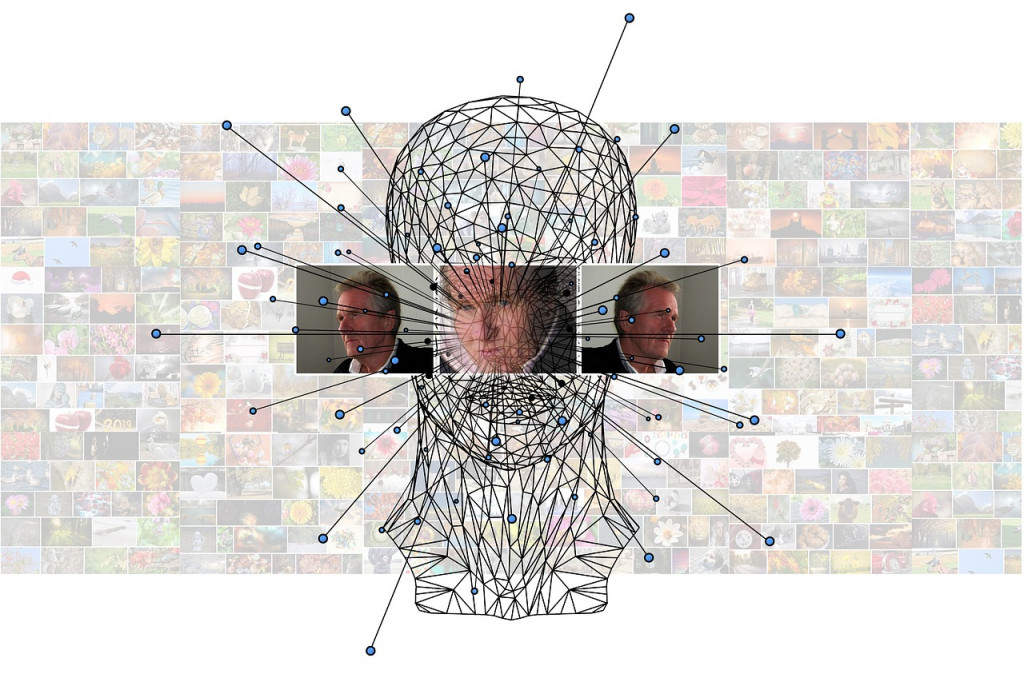

綜合幾個重點:大腦(大數據資料庫)、感知(感測元件)、神經(傳導系統)、軟體(溝通指令),就構成人類從小時候學習的基礎模式,從初章就有提到,稍微把這些歸納,負責把這些統整成人工智慧系統,在AI領域稱之為卷積神經網路(Convolutional Neural Networks),所用的辨識方法就是用多維陣列的演算法,在陣列每一格形成相似或相異的數字,在這我們並不太深入這個神經網絡的說明,只會舉例或轉化來讓人理解,例如蛋糕擺在餐桌上,以小嬰兒視野所見,開始他並不知道這是蛋糕,也無從判斷可不可以吃,更不用說碰觸過、嚐過、聞過,可能小嬰兒看到的是蛋糕的各種顏色和形狀,這時大腦中會產生好奇、模糊的映象,就是我們說小孩最純淨的原始狀態,那麼突然發現大人正在吃蛋糕的「狀況劇」出現,這時候小嬰兒的映象開始轉變和記憶,隨著不同情景和片段的的加強,這些「映像」慢慢會形成「學習」的踏階。

好的,就正常的發展是這樣沒錯,那如果上帝造人沒有造全,或者因為後天因素造成損傷,利用現有的AI技術有沒有辦法再造?這是醫療科技一直在思考和亟須突破的難題,最難的不意外就是內臟器官,多少人工化的機械替代器官,有使用年限的窘境,進展是相當緩慢,多數是要採取活體移植的方式,否則就只能靠藥物或外在醫療維生機械來存續生命,這是目前AI最難介入的一塊。但外在器官的AI進程卻是進步神速,例如在前面篇章提到電子耳時,已經可以改善以往傳統助聽器的不便。

那麼在肢體輔助方面的AI技術呢?在前年開始,手腕、手指、指關節、手臂的機械輔助裝備,開始在義肢有所突破,首先在腦外科手術進行植晶片到大腦,手術完畢後,會開始進行一連串手部動作數據建構,利用大腦所釋放出來的微電波,藉由晶片去驅動手部,微細的手指關節動作,以及機械感測觸感,當測試者被摸醫療人員摸小指時,就能很快讀出是「小指」,其他手指也是一樣,這表示初步已達成,唯獨溫度還無法很具體呈現,這就需要不斷的去修正和改良晶片,或許無法回復原樣,但至少已經藉由AI科技重新建構「溝通」的媒介,讓患者心情會有所轉變,人生就不會太灰暗。