ABC 實業的 IT Support 小林,常常被老闆半路攔下:「最近大家都在說 AI,聽說可以用在客服回覆、產生漂亮的廣告圖片...」這時,你就是老闆第一個想諮詢的「AI 先知者」。不是因為你是學術派專家,而是因為公司內就你比較懂電腦、懂大家的人。你不一定要會養馬,但你要知道可以如何開始去研究,指引公司同事一些方向。所以,筆者整理這些資訊可以協助你:盡快的瞭解 AI。

👉 你不必是 AI 專家,但需要你是公司內第一個懂得問 AI 的人

我們就接續前兩天的探討,來瞭解 影響 AI 表現的第四關鍵吧...

AI 代理程式中,有一個區塊是讓我們可以擴充她的地方,以 ChatGPT 為例,就有這些常用的擴充功能:

💡 會用內建功能,是入門;會加上擴充功能,才是進階。

👉 使用提醒:

- 權限最小化:授權前先看清楚工具要存取什麼資料。

- 機敏資料脫敏:上傳前移除姓名、電話、金額等識別資訊。

- 紀錄可重現:把提示詞與步驟存在 memo,日後能複製流程。

在軟體工程領域,常常會幫 AI 設定一個「人格」與「專長」,像是讓它扮演 PM、需求分析師或 Code Reviewer。這些通常是用 軟體工程的 AI 代理程式裡的 自訂指令、或自訂提示 (自訂斜線指令) 來完成。

這些 自訂指令/自訂提示,通常是寫好的一個完整的提示詞,比如告訴 AI 扮演什麼角色、有哪些能力、做事情的步驟...等等。

💡 你可以給 AI 一個角色

這樣使用這些 自訂指令 時,就可以再加上簡單的提示詞,就可以請 AI 完成很複雜的任務。

MCP (Model Context Protocol) 常被比喻成 AI 界的 USB-C,MCP 讓我們可以把 AI 和你的內部系統接起來。

目前已經有人完成非常多的 MCP,跟某些大公司的 ERP、CRM ... 串接起來;也有一些小工具的 MCP , MCP 現在很活絡,還有人設計 市集 (類似 APP Store) 讓大家共享。

但要小心,這些市集並沒有人負責安全把關,所以還是得小心為要,避免駭客透過這些管道侵入公司內部系統。

💡 MCP 是 AI 的 USB-C,一插就通,但一錯也可能引狼入室、捅了個通天大洞。

自訂指令、自訂提示、MCP,我們就簡單的介紹一下,讓 IT Support 工程師有個概念即可。這些東西水很深,要開始使用肯定還得下非常多的心力去研究。

筆者敘述了影響 AI 表現的四大關鍵,當知道如何駕馭 AI 時也須注意 安全性、可靠性,接下來,我們簡要的瞭解這兩點。

只要把資料丟給 AI,就存在風險。最常見的疑慮:就是擔心 AI 服務商會拿我們的資料去訓練模型,這些模型又可能幫助了我們的競爭對手...

雖然 AI 服務商會宣稱:不會拿顧客的資料去訓練 AI 模型,但仍有人是不放心的。( 另,也有 AI 公司公開說:「免費方案的內容可能用於訓練或改善服務」,而付費方案則不會。)

要如何兼顧使用 AI 、同時可以保護公司資料呢?ABC 實業的作法可供參考:

👉 脫敏,才是上傳 AI 前的防火牆。

擴充功能雖然好用、公開市集雖方便下載,但有兩個高風險點最常被忽略:

建議:慎選信任的 MCP、對於有可能破壞系統的,可能要在沙箱環境中執行,以免破壞系統。

👉 沙箱,是測試新功能的隔離保護區。

AI 的口氣常常比人還肯定,這就是風險來源。所謂「幻覺」,指的是它一本正經地說出不正確或缺乏依據的內容。

💡 AI 最大的錯誤,不是它說錯,而是它說得太像對。

AI 早期的幻覺率被觀察到高達 20–40%,也就是只有六成多的內容是可信的,另外有三成可能是有問題的。

隨著模型進步,在常見題材,幻覺約可降到 5–15%,但冷門知識、地方性規範、剛發布的新技術,錯誤率仍可能達 20–30%。

💡 最危險的不只是不知道錯,還有一個是自信滿滿的錯誤。

此外,模型的輸出具有「變異性」與「不一致性」,同一個題目再問一次,答案可能不同,另:環境不同(版本、工具可用性),表現也不同。 ( 因為這樣,還有一種用法是:當你發現 AI 錯了,只要相同問題再問一次、或加個空白 逗點 之類的 再問一次,她就對了 )

如何讓可靠性變高?以下做法供參考:

💡 不要期待 100% 正確,但可期待 100% 可追溯。

AI 時代來了,不可逃避的,我們會用它來協助我們。AI 就像多了一位知識淵博的助理,但需要你分配任務與設定邊界。

AI 時代來了,這是個「會問問題就能解決問題」的時代。所以,認真的寫好提示詞,像是遵循 PTCF 框架,一次交代清楚,AI 回答的品質自然比較穩定。

AI 時代來了,但也不要過度依賴。把她當副駕駛(Co‑pilot),方向盤仍在你手上,你才是正駕駛。你要有清楚判斷能力、不能過度依賴。

💡 AI 是副駕駛,方向盤在你手上,你才是正駕駛。

AI 時代來了,但 AI 有幻覺。我們要建立驗證流程與交叉檢查,而不是把每個答案都是為正確。資料有依據、步驟可重現,才是我們要的可靠度。

AI 時代來了,AI 很好用,需要懂得善用 AI 工具,不同 AI 有不同的專長能力,每種 AI 工具都得經過一段駕馭的過程,才能成為你上手的好助手。

最後,我們回到初心:專業知識仍是王道。AI 能把你推得更快,但推錯方向只會離目標更遠。下一篇,我們將正式進入「IT 職人養成」的主軸,談 IT 職涯規劃與 CompTIA A+ 認證的實際價值,協助你把基礎打好、跑得長久。

💡 專業知識才是王道,AI 是放大器,不是代替品。

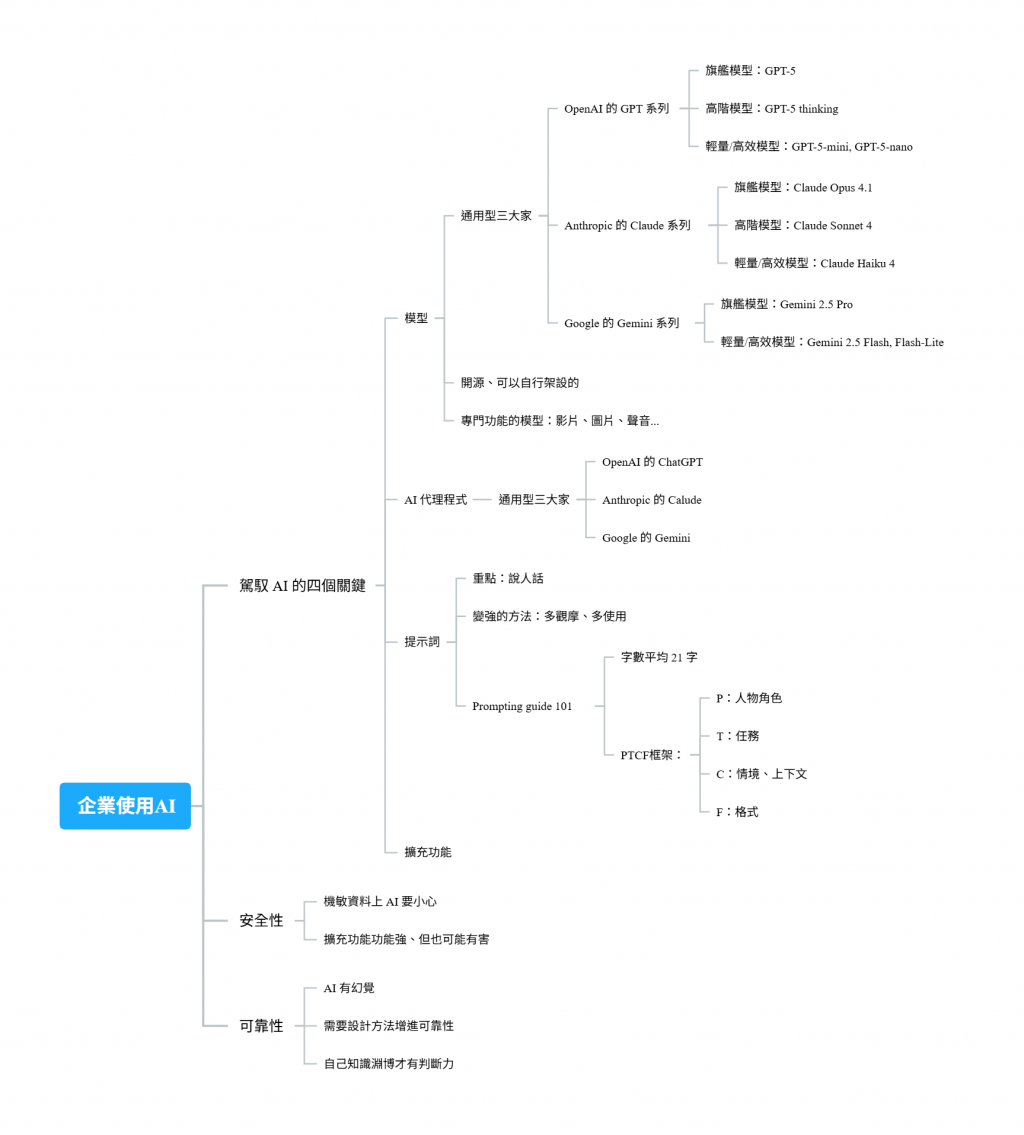

AI 初步探討寫了三篇,幫大家整理一個 心智圖,如下: