昨天我們介紹了 LLM(Large Language Model, 大語言模型) 與 SLM(Small Language Model, 小語言模型) 的優勢、挑戰以及不同的應用場景。幫助我們理解大型模型的能力與資源,以及小型模型在靈活與成本控制上的優勢。

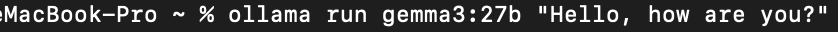

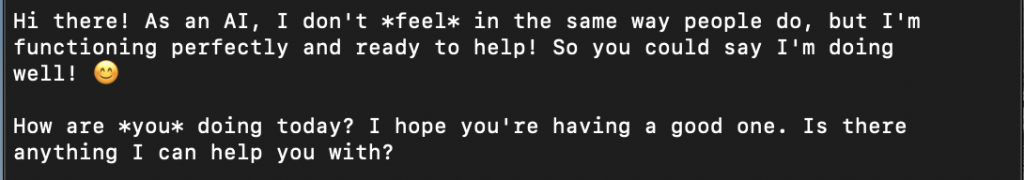

今天我們要介紹一個實用的框架平台 Ollama。它讓開發者與使用者能更輕鬆地在本地環境中體驗並運行各式語言模型,不論是測試、開發都能以更簡單的方式進行。透過 Ollama,我們可以更直觀的探索 LLM 與 SLM 的潛力,並將這些模型應用到不同場景之中。

Ollama 是一個可以簡化本地端運行大語言模型而打造的框架平台,讓使用者能更輕鬆地下載、管理與使用各種 AI 模型,不必經過繁瑣的安裝與設定過程。過去如果想要在電腦上執行像 LLaMA 或 Mistral 這類熱門的模型,往往需要處理相依套件、硬體支援、甚至 CUDA 等環境問題,對於一般使用者來說門檻較高。Ollama 的出現將這些技術細節大幅簡化,只要透過簡單的指令,就能在 Windows、macOS 或 Linux 系統中順利啟動模型。