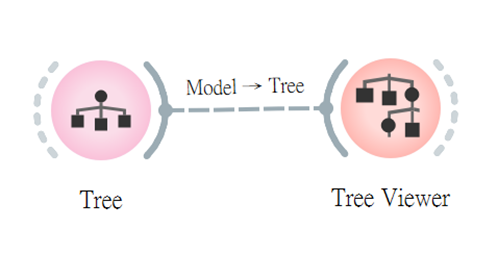

大家好,來到我們第十天嚕~今天我們要來談談Tree,因為在後續的實作都會應用到,所以再來繼續科普一下大家,在我們了解分類和迴歸之前,先來初步了解決策樹吧!![]()

為一種過程單純且執行效率也很高的監督式機器學習模型,它很普遍地被用於資料探勘(Data Mining)的技術,而判斷決策的模式是用樹狀分枝的概念來作。

分類樹(Classification Tree)

決策樹很常被拿來用在預測分類上。如果它被拿來應用於應變數類別型態時,那麼我們就可以說這棵決策樹是「分類樹」。

e.g. 生死、性別、顏色

迴歸樹(Regression Tree)

那如果決策樹分析出來的結果是連續數時,那麼我們就可以說這棵決策樹是「迴歸樹」。

e.g. 體重、身高

分類迴歸樹(Classification and Regression Tree / CART)

再來,還有一種預測結果不只可以顯現出類別的型態,還可以是連續數值型的資料,那麼我們就可以說這棵決策樹是「分類迴歸樹」。

方法 : 在每一次進行分類時,只會產生兩個分枝,分別來歸納與分析資料集,而且並不限制變數的類型 ! 因於分析上,有著較大的彈性,固然是受眾人喜愛使用的分析方法之一。

請大家記住以上幾點,或許我們在後天就會用到囉~![]()

參考資料:

決策樹 Decision trees

分類工具(3)─決策樹(Decision Tree)