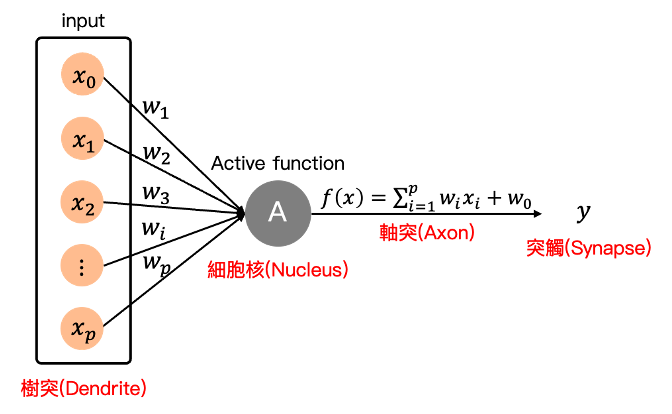

類神經網路(Neural Network, NN),又稱為神經網路、人工神經網路(Artificial Neural Network, ANN),屬於非線性的統計模型,是深度學習(Deep learning)的核心概念,而深度學習也是機器學習的一個分支領域,在影像辨識、語音識別與自然語言處理等方面有許多的應用。起源於模仿人類腦部神經元相互發出信號的運作模式建立模型,例如以下示意圖的概念:

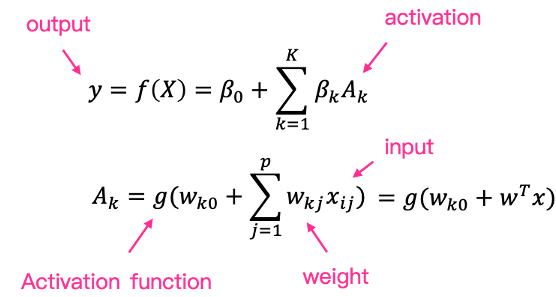

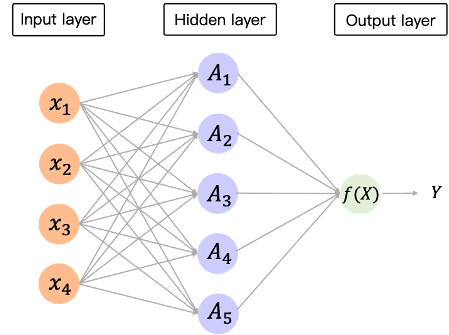

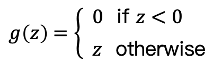

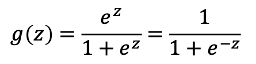

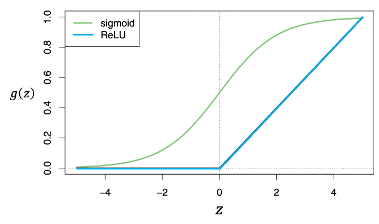

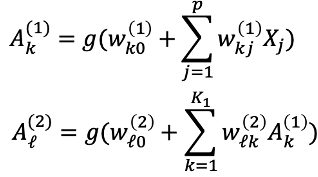

本系列文章的內容中有許多可以處立非線性資料的統計模型,例如多項式迴歸模型、SVM與Boosting等等,而Neural Network與這些模型有很大的差別,也就是利用神經元傳遞信號的特殊模型結構,並且也可以處理迴歸與分類的問題,利用幾個解釋變數(explanatory variable)或特徵(feature),當成輸入層(input layer),中間經過非線性activation function構成的隱藏層(hidden layer)轉換後,預測反應變數(response variable)或outcome Y。

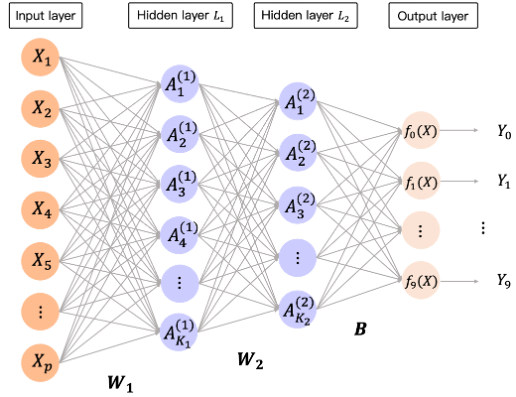

上述是最簡單的Neural Network的架構,而通常使用到的Neural Network會包含許多隱藏層得到更好的結果,因此稱為深度類神經網路(Deep Neural Network),也被當時提出此方法的人重新取名為深度學習(Deep learning),例如以下示意圖利用兩層的hidden layer預測9個類別的反應變數Y。

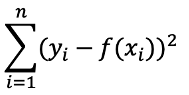

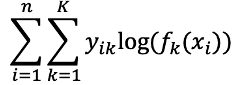

今天的內容主要介紹了Neural network的基本架構與數學形式,明天的內容將會簡單描述Neural Network中的參數該如何估計,以及深度學習中常常面臨到的幾個問題。