終於來到最後一天,謝謝願意點進來看的讀者們><

這30天,我們從LLM和硬體基礎知識開始學習,知道如果想要有一整套的local LLM服務,背後大概會需要多少水電消耗。➡️ 而學者們為了節省成本,又開發出多少技術在後面,同時也學習實作了包含這些技術的推理加速框架。 ➡️ 最後看了一下大型資料中心可能的infra架構,了解整個服務背後從server到APP中間的過程,也提了DevOps的概念,藉以延伸出監控的重要性。

雖然AI是一個需要金錢、人才和資源才能搞的東西,消耗的水電也讓地球暖化岌岌可危……但其中的技術真的令人嘆為觀止,很多想法其實都非常簡單有創意。

在這30天其實還有很多東西可以寫,像是postman、壓力測試、CICD等等,上學的時候學校都沒有教這些,但工作就要會了(´。_。`),至於LLM的未來展望,這邊依舊參考A Survey on Efficient Inference for LargeLanguage Models這篇超讚的論文中提到的幾個LLM應用有前途的未來方向。

原本是希望可以多寫一些現有服務框架,但這些服務很可能快速被淘汰,所以還是挑了最具代表性的之一,並以背後的技術為主,因為這些經典技術只會演化,而不會被淘汰。在硬體和其他推理技術的持續發展,也許未來這系列還會有二部曲或三部曲,標題會取一部曲單純是覺得都是英文標題想+個中文字( •̀ ω •́ )y

BTW,報名送出之後才發現標題的i沒有都大寫,如果因此激怒一些強迫症讀者,真的很抱歉。

(圖源: DALL·E,在生成團隊封面時生出的可愛妹子,但做為團隊頭像不夠嘲諷o( ̄▽ ̄)ブ)

就像是Eric Schmidt說的AI如電力的比喻,個人覺得肯定是不會,但如果省水電技術發展的比運用快,感覺物理上加速暖化毀滅地球是有可能的!筆者不是環保人士,但資料查一查忍不住開始覺得應該要環保一點(?)

(圖源: facebook)

如果說這30天有什麼最大的心得……那就是讓GPT幫文章放滿emoji超好玩的!最一開始是隊友筆說技術文章放emoji比較好閱讀,但現在回顧沒有emoji的前10天真是難以下嚥。(掩面

再來就是在寫 Day 18 前一天的半夜,突然腦袋不知道為啥閃過一個星爆的梗圖 ⚔️💥✨💫,之後就忍不住回去重刷刀劍神域XDD,現在回想裡面的設定真是領先時代20年,尤其是愛麗絲篇的搖光設定真的有夠潮,如果用LLM Agent + RL不知道可不可以做出很多遊戲NPC(?)

這30天寫起來最難的是 Day 1 的章節分配,一開始完全不知道怎麼分,技術也不知道要寫哪些,直到看了幾篇論文之後才突然覺得這個分配方式好像比較合理!

(這時候突然覺得看論文非常有用)

剩下的章節就是寫好寫滿,除了實作篇之外,花的時間都滿多的,尤其是技術篇,至少要兩天以上,因為工作都是先用再說,沒有時間慢慢理解這些技術(所以就因為這樣面試時被洗臉過),加上筆者資質駑鈍,第一次看技術根本看不懂他們在寫什麼,要用一天以上消化和瘋狂跟GPT QA,才可以開始寫大綱。這30天通常都是先寫個章節大綱,如果想不到大綱就請GPT生成一篇很爛很AI的文章,從裡面抽出覺得可以用的概念去查資料,加上infra時代看官方文件的習慣QQ,全部人工手寫一次,最後再用GPT潤稿、加emoji,放梗圖。

雖然跟其他大大們比起來這系列一點也不華麗、非常樸實無華,甚至牽扯到一些麻煩的NLP和infra DevOps背景知識,其實LLM Inference這系列本質上就跟Infra很像,雖然都是重要的基礎卻非常不起眼,但如果沒有這些基礎,那些可以快樂應用的LLM服務就難以存在(;´д`)ゞ。

這邊也放上他們的鐵人賽系列,都是一些非常充實的內容。

- 懶人救星:生成式AI

- 筆是畫圖大師,RAG的各種架構圖都是他自己畫的,個人最喜歡的是 Day4 注意看,這個AI太狠了! ,Azure應該要給他小費才對。

- 征服機器學習的終極秘技

- 籃板在這次鐵人賽一共寫了60篇文章,其中的ML系列很用心,是非常正統且宛如教科書般扎實的內容XD

也謝謝訂閱的讀者們XDD

雖然這一個月包含中秋的假日都在寫文章,但還是玩得非常開心!!

(圖源: 自製)

非常有趣,感謝分享!

偷偷問,系列文中較常描述使用 chatgpt-4o,是因為那些 local 部署的版本在潤稿方面還做不好嗎?

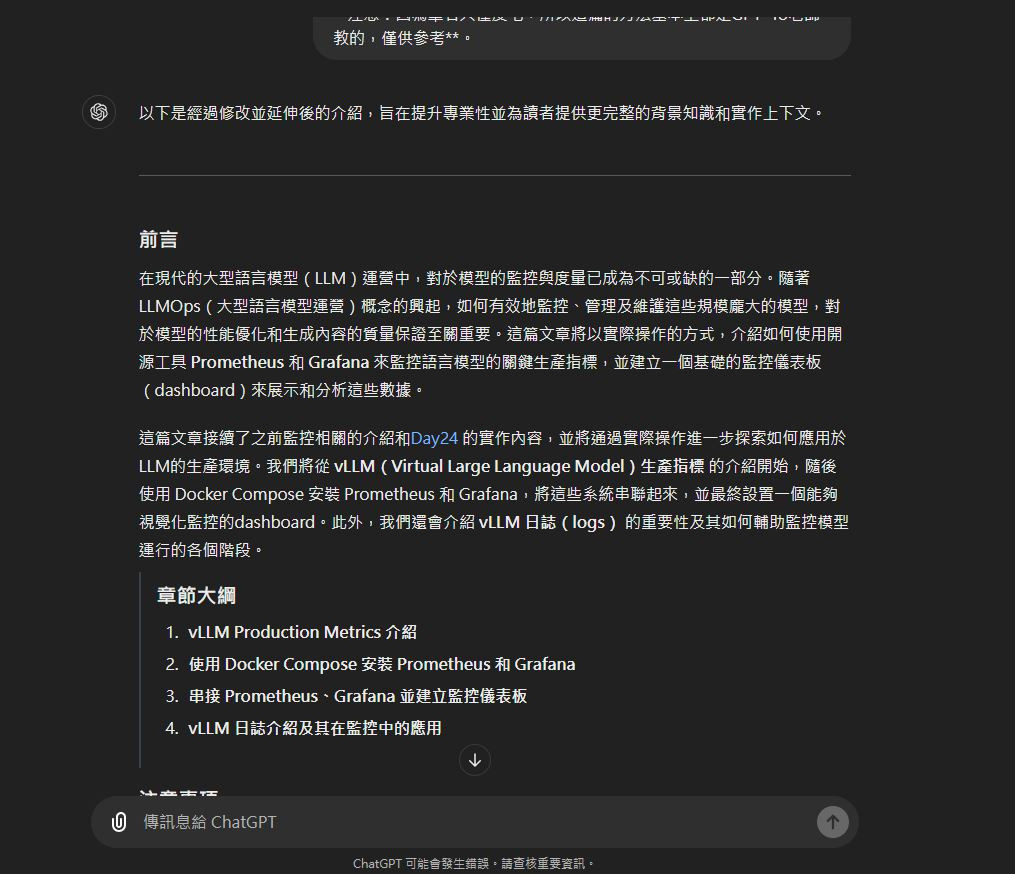

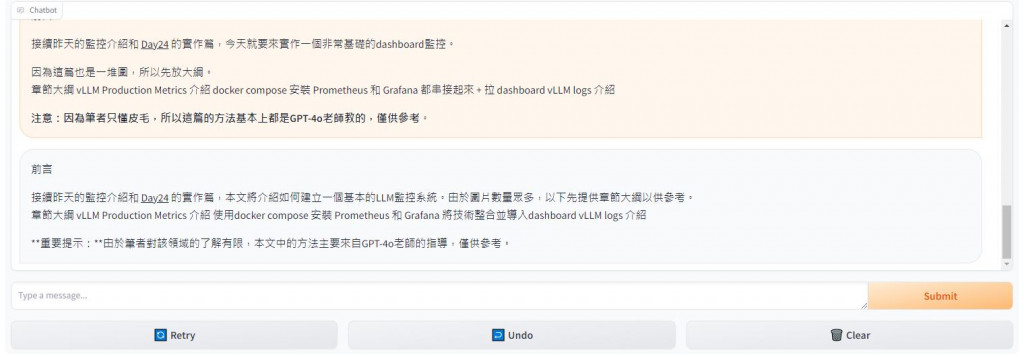

會用4o單純是因為4o用習慣了,每天的免費額度很好用XD,其實我沒試過用local模型潤稿耶,拿昨天的來試一下

GPT-4o

yentinglin/Llama-3-Taiwan-8B-Instruct

潤稿之外主要還會要他延伸一些廢話讓句子不會那麼空虛,不用特別試 隨便下prompt就有很好的效果,還是GPT比較強

結論: local只適合拿來 + emoji XDD

![]()

您好~ 不知道有沒有機會跟您加一個 line 請教一些 LLM infra 的事情

謝謝您!

不好意思這麼晚才回覆,謝謝您的留言!目前不方便分享私人聯絡方式,如果您願意的話可以留言詢問,我會盡量幫忙的~